Teorema de muestreo de Nyquist-Shannon

El teorema de muestreo de Nyquist-Shannon es un teorema en el campo del procesamiento de señales que sirve como puente fundamental entre las señales de tiempo continuo y las señales de tiempo discreto. Establece una condición suficiente para una frecuencia de muestreo que permite una secuencia discreta de muestras para capturar toda la información de una señal de tiempo continuo de ancho de banda finito.

Estrictamente hablando, el teorema solo se aplica a una clase de funciones matemáticas que tienen una transformada de Fourier que es cero fuera de una región finita de frecuencias. Intuitivamente, esperamos que cuando uno reduce una función continua a una secuencia discreta e interpola de nuevo a una función continua, la fidelidad del resultado depende de la densidad (o frecuencia de muestreo) de las muestras originales. El teorema de muestreo introduce el concepto de una tasa de muestreo que es suficiente para una fidelidad perfecta para la clase de funciones que tienen una banda limitada a un ancho de banda determinado, de modo que no se pierde información real en el proceso de muestreo. Expresa la frecuencia de muestreo suficiente en términos de ancho de banda para la clase de funciones. El teorema también conduce a una fórmula para reconstruir perfectamente la función de tiempo continuo original de las muestras.

La reconstrucción perfecta aún puede ser posible cuando no se cumple el criterio de frecuencia de muestreo, siempre que se conozcan otras restricciones en la señal (ver § Muestreo de señales que no son de banda base a continuación y detección comprimida). En algunos casos (cuando no se cumple el criterio de frecuencia de muestreo), el uso de restricciones adicionales permite realizar reconstrucciones aproximadas. La fidelidad de estas reconstrucciones se puede verificar y cuantificar utilizando el teorema de Bochner.

El nombre Teorema de muestreo de Nyquist-Shannon honra a Harry Nyquist y Claude Shannon, pero el teorema también fue descubierto previamente por E. T. Whittaker (publicado en 1915), y Shannon citó el artículo de Whittaker en su trabajo. Por lo tanto, el teorema también se conoce con los nombres Teorema de muestreo de Whittaker-Shannon, Whittaker-Shannon y Whittaker-Nyquist-Shannon, y también puede ser referido como el teorema cardinal de interpolación.

Introducción

El muestreo es un proceso de conversión de una señal (por ejemplo, una función de tiempo o espacio continuo) en una secuencia de valores (una función de tiempo o espacio discreto). La versión de Shannon del teorema establece:

Theorem—Si una función x()t){displaystyle x(t)} no contiene frecuencias superiores a las Bhertz, está completamente determinado dando sus ordenanzas en una serie de puntos espaciados 1/()2B){displaystyle 1/(2B)} segundos separados.

Una cantidad suficiente de muestra es por lo tanto algo más grande que 2B{displaystyle 2B} muestras por segundo. Equivalentemente, para una tasa de muestra dada fs{displaystyle f_{s}, perfecta reconstrucción es posible para un límite de banda <math alttext="{displaystyle BB.fs/2{displaystyle B<img alt="{displaystyle B.

Cuando el límite de banda es demasiado alto (o no hay límite de banda), la reconstrucción exhibe imperfecciones conocidas como alias. Las declaraciones modernas del teorema a veces son cuidadosas para afirmar explícitamente que x()t){displaystyle x(t)} no debe contener ningún componente sinusoidal a la frecuencia exacta B,{displaystyle B,} o aquello B{displaystyle B} debe ser estrictamente inferior a 1⁄2 la tasa de muestra. El umbral 2B{displaystyle 2B} se llama la tasa de Nyquist y es un atributo de la entrada de tiempo continuo x()t){displaystyle x(t)} para ser muestreado. La tasa de muestra debe superar la tasa de Nyquist para que las muestras sean suficientes para representar x()t).{displaystyle x(t).}El umbral fs/2{displaystyle F_{s}/2} se llama la frecuencia de Nyquist y es un atributo del equipo de muestreo. Todos los componentes de frecuencia significativos del muestreo adecuado x()t){displaystyle x(t)} existen debajo de la frecuencia Nyquist. La condición descrita por estas desigualdades se llama Criterio de Nyquist, o a veces el Raabe condition. El teorema también es aplicable a funciones de otros dominios, como el espacio, en el caso de una imagen digitalizada. El único cambio, en el caso de otros dominios, es las unidades de medida atribuidas a t,{displaystyle t,} fs,{displaystyle f_{s} y B.{displaystyle B.}

El símbolo T≜ ≜ 1/fs{displaystyle Ttriangleq 1/f_{s} se utiliza habitualmente para representar el intervalo entre muestras y se llama el período de muestreo o intervalo de muestreo. Las muestras de la función x()t){displaystyle x(t)} son comúnmente denotados por x[n]≜ ≜ x()nT){displaystyle x[n]triangleq x(nT)} (alternativamente) xn{displaystyle x_{n} en literatura de procesamiento de señales viejas), para todos los valores enteros de n.{displaystyle n.}Otra definición conveniente es x[n]≜ ≜ T⋅ ⋅ x()nT),{displaystyle x[n]triangleq Tcdot x(nT),} que conserva la energía de la señal como T{displaystyle T} varía.

Una forma matemáticamente ideal para interponer la secuencia implica el uso de funciones sinc. Cada muestra en la secuencia es reemplazada por una función sinc, centrada en el eje de tiempo en la ubicación original de la muestra nT,{displaystyle nT,} con la amplitud de la función sinc escalada al valor de la muestra, x[n].{displaystyle x[n].} Posteriormente, las funciones sincicales se resumen en una función continua. Un método matemáticamente equivalente utiliza el peine Dirac y procede convolviendo una función sinc con una serie de pulsos Dirac delta, ponderados por los valores de la muestra. Ningún método es numéricamente práctico. En cambio, se utiliza algún tipo de aproximación de las funciones sincicales, finita en longitud. Las imperfecciones atribuibles a la aproximación son conocidas como error de interpolación.

Los prácticos convertidores de digital a analógico no producen funciones de sincronización retardada y escalada, ni pulsos de Dirac ideales. En su lugar, producen una secuencia constante por tramos de pulsos rectangulares escalados y retrasados (la retención de orden cero), generalmente seguida de un filtro de paso bajo (llamado "filtro anti-imagen") para eliminar réplicas falsas de alta frecuencia. (imágenes) de la señal de banda base original.

Alias

Cuando x()t){displaystyle x(t)} es una función con una transformación Fourier X()f){displaystyle X(f)}:

- X()f)≜ ≜ ∫ ∫ − − JUEGO JUEGO JUEGO JUEGO x()t)e− − i2π π ftdt,{displaystyle X(f)\triangleqint _{-infty }{infty }x(t) e^{-i2pi ft} {rm {}t,}

la fórmula de summación Poisson indica que las muestras, x()nT){displaystyle x(nT)}, de x()t){displaystyle x(t)} son suficientes para crear un resumen periódico X()f){displaystyle X(f)}. El resultado es:

- Xs()f)≜ ≜ .. k=− − JUEGO JUEGO JUEGO JUEGO X()f− − kfs)=.. n=− − JUEGO JUEGO JUEGO JUEGO T⋅ ⋅ x()nT)e− − i2π π nTf{displaystyle X_{s}(f)triangleq sum _{k=-infty }^{infty }Xleft(f-kf_{s}right)=sum _{n=-infty }{infty }Tcdot x(nT) e^{-i2pi No. ()Eq.1)

que es una función periódica y su representación equivalente como una serie Fourier, cuyos coeficientes son T⋅ ⋅ x()nT).{displaystyle Tcdot x(nT). } Esta función también se conoce como la transformación Fourier discreta (DTFT) de la secuencia de la muestra.

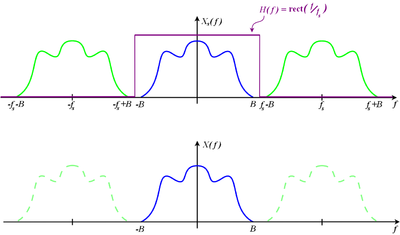

Como se muestra, copias de X()f){displaystyle X(f)} son cambiados por múltiples de la tasa de muestreo fs{displaystyle f_{s} y combinados por adición. Para una función limitada por banda()X()f)=0,para todosSilenciofSilencio≥ ≥ B){displaystyle (X(f)=0,{text{ for all }y suficientemente grandes fs,{displaystyle f_{s} es posible que las copias permanezcan separadas entre sí. Pero si el criterio de Nyquist no está satisfecho, las copias adyacentes se superponen, y no es posible en general discernir una inequívoca X()f).{displaystyle X(f).} Cualquier componente de frecuencia superior fs/2{displaystyle F_{s}/2} es indistinguible de un componente de menor frecuencia, llamado alias, asociado con una de las copias. En esos casos, las técnicas habituales de interpolación producen el alias, en lugar del componente original. Cuando la tasa de muestra está predeterminada por otras consideraciones (como un estándar de la industria), x()t){displaystyle x(t)} se filtra generalmente para reducir sus altas frecuencias a niveles aceptables antes de que se muestre. El tipo de filtro requerido es un filtro de bajapasa, y en esta aplicación se llama filtro antialiasing.

Derivación como caso especial de suma de Poisson

Cuando no hay solapamiento de las copias (también conocidas como "imágenes") de X()f){displaystyle X(f)}, el k=0{displaystyle k=0} mandato Eq.1 puede ser recuperado por el producto:

- X()f)=H()f)⋅ ⋅ Xs()f),{displaystyle X(f)=H(f)cdot X_{s}(f),}Donde:

- <math alttext="{displaystyle H(f) triangleq {begin{cases}1&|f|f_{s}-B.end{cases}}}" xmlns="http://www.w3.org/1998/Math/MathML">H()f)≜ ≜ {}1SilenciofSilencio.B0SilenciofSilencio■fs− − B.{displaystyle H(f)\triangleq {begin{cases}1 tendrían una relación perfectaB\0 limitante perpetuaf confidencialf_{s}-B.end{cases}}<img alt="{displaystyle H(f) triangleq {begin{cases}1&|f|f_{s}-B.end{cases}}}" aria-hidden="true" class="mwe-math-fallback-image-inline" src="https://wikimedia.org/api/rest_v1/media/math/render/svg/a7351784c5798d31277f418923189e664c69d274" style="vertical-align: -2.505ex; width:28.455ex; height:6.176ex;"/>

El teorema de muestreo está probado desde entonces X()f){displaystyle X(f)} determinaciones únicas x()t).{displaystyle x(t).}

Todo lo que queda es derivar la fórmula para la reconstrucción. H()f){displaystyle H(f)} no se debe definir con precisión en la región [B,fs− − B]{displaystyle [B, f_{s}-B] porque Xs()f){displaystyle X_{s}(f)} es cero en esa región. Sin embargo, el peor caso es cuando B=fs/2,{displaystyle B=f_{s}/2,} la frecuencia Nyquist. Una función suficiente para ello y todos los casos menos graves es:

- <math alttext="{displaystyle H(f)=mathrm {rect} left({frac {f}{f_{s}}}right)={begin{cases}1&|f|{frac {f_{s}}{2}},end{cases}}}" xmlns="http://www.w3.org/1998/Math/MathML">H()f)=rect()ffs)={}1SilenciofSilencio.fs20SilenciofSilencio■fs2,{displaystyle H(f)=mathrm {rect} left({frac {f}{f_{s}}}right)={begin{cases}1 ventaja sobre la vida {f} {}}} {f}{2}}}end{cases}}<img alt="H(f)=mathrm {rect} left({frac {f}{f_{s}}}right)={begin{cases}1&|f|{frac {f_{s}}{2}},end{cases}}" aria-hidden="true" class="mwe-math-fallback-image-inline" src="https://wikimedia.org/api/rest_v1/media/math/render/svg/32271e5944aaaa93e273359c4a3a8015f3b0d7ce" style="vertical-align: -3.505ex; width:36.876ex; height:8.176ex;"/>

donde rect(•) es la función rectangular. Por lo tanto:

- X()f)=rect()ffs)⋅ ⋅ Xs()f){displaystyle X(f)=mathrm {rect} left({frac {f}{f_{s}}}right)cdot X_{s}(f)}

- =rect()Tf)⋅ ⋅ .. n=− − JUEGO JUEGO JUEGO JUEGO T⋅ ⋅ x()nT)e− − i2π π nTf{displaystyle =mathrm {rect} (Tf)cdot sum _{n=-infty }{infty }Tcdot x(nT) e^{-i2pi No.(deEq.1, arriba).

- =.. n=− − JUEGO JUEGO JUEGO JUEGO x()nT)⋅ ⋅ T⋅ ⋅ rect()Tf)⋅ ⋅ e− − i2π π nTf⏟ ⏟ F{}sinc()t− − nTT)}.{displaystyle =sum _{n=-infty }{infty }x(nT)cdot underbrace {Tcdot mathrm {rect} (Tf)cdot e^{-i2pi nTf} _{mathcal {F}left{mathrm {Sinc} left({frac Bien.

La transformada inversa de ambos lados produce la fórmula de interpolación de Whittaker-Shannon:

- x()t)=.. n=− − JUEGO JUEGO JUEGO JUEGO x()nT)⋅ ⋅ sinc()t− − nTT),{displaystyle x(t)=sum _{n=-infty }{infty }x(nT)cdot mathrm {sinc}left({frac {t-nT}right),}}

que muestra cómo las muestras, x()nT),{displaystyle x(nT),} se puede combinar para reconstruir x()t).{displaystyle x(t).}

- Valores más grandes de lo necesario fs (valores más pequeños de T), llamado oversampling, no tienen efecto en el resultado de la reconstrucción y tienen el beneficio de dejar espacio para un banda de transición en que H()f) es libre para tomar valores intermedios. El reconocimiento, que causa el aliado, no es en general una operación reversible.

- Teóricamente, la fórmula de interpolación puede ser implementada como un filtro de paso bajo, cuya respuesta de impulso es sinc(t/T) y cuya entrada es .. n=− − JUEGO JUEGO JUEGO JUEGO x()nT)⋅ ⋅ δ δ ()t− − nT),{displaystyle textstyle sum _{n=-infty }{infty }x(nT)cdot delta (t-nT),} que es una función de comb Dirac modulada por las muestras de señal. Los convertidores prácticos digitales a analógicos (DAC) implementan una aproximación como la retención de cero orden. En ese caso, el oversampling puede reducir el error de aproximación.

Prueba original de Shannon

Poisson muestra que la serie Fourier Eq.1 produce la suma periódica de X()f){displaystyle X(f)}, independientemente de fs{displaystyle f_{s} y B{displaystyle B}. Shannon, sin embargo, sólo deriva los coeficientes de la serie para el caso fs=2B{displaystyle f_{s}=2B}. Casi citando el papel original de Shannon:

- Vamos X()⋅ ⋅ ){displaystyle X(omega)} ser el espectro de x()t).{displaystyle x(t).}Entonces...

- x()t)=12π π ∫ ∫ − − JUEGO JUEGO JUEGO JUEGO X()⋅ ⋅ )ei⋅ ⋅ td⋅ ⋅ =12π π ∫ ∫ − − 2π π B2π π BX()⋅ ⋅ )ei⋅ ⋅ td⋅ ⋅ ,{displaystyle x(t)={1 over 2pi }int _{-infty }X(omega)e^{iomega ################################################################################################################################################################################################################################################################ ={1 over 2pi }int _{-2pi B}{2pi B}X(omega)e^{iomega ##;{rm {d}omega}

- porque X()⋅ ⋅ ){displaystyle X(omega)} se supone que es cero fuera de la banda <math alttext="{displaystyle left|{tfrac {omega }{2pi }}right|Silencio⋅ ⋅ 2π π Silencio.B.{displaystyle lefttención{tfrac {omega }{2pi Está bien.<img alt="{displaystyle left|{tfrac {omega }{2pi }}right|Si lo dejamos t=n2B,{displaystyle t={tfrac {n}{2B},} Donde n{displaystyle n} es cualquier entero positivo o negativo, obtenemos:

- x()n2B)=12π π ∫ ∫ − − 2π π B2π π BX()⋅ ⋅ )ei⋅ ⋅ n2Bd⋅ ⋅ .{displaystyle xleft({tfrac {n}{2B}right)={1over 2pi }int _{-2pi B}^{2pi B}X(omega)e^{iomega {nover {2B}};{rm {d}omega.}}

()Eq.2)

- A la izquierda hay valores de x()t){displaystyle x(t)} en los puntos de muestreo. La integralidad de la derecha será reconocida como esencialmente la nT coeficiente en una expansión de Fourier-series de la función X()⋅ ⋅ ),{displaystyle X(omega),} tomando el intervalo − − B{displaystyle -B. a B{displaystyle B} como un período fundamental. Esto significa que los valores de las muestras x()n/2B){displaystyle x(n/2B)} determinar los coeficientes Fourier en la expansión de la serie de X()⋅ ⋅ ).{displaystyle X(omega).}Así determinan X()⋅ ⋅ ),{displaystyle X(omega),} desde entonces X()⋅ ⋅ ){displaystyle X(omega)} es cero para frecuencias mayores que B, y para frecuencias inferiores X()⋅ ⋅ ){displaystyle X(omega)} se determina si Se determinan coeficientes de Fourier. Pero... X()⋅ ⋅ ){displaystyle X(omega)} determina la función original x()t){displaystyle x(t)} completamente, ya que una función se determina si su espectro es conocido. Por lo tanto, las muestras originales determinan la función x()t){displaystyle x(t)} completamente.

La demostración del teorema de Shannon está completa en ese punto, pero continúa analizando la reconstrucción a través de funciones sinc, lo que ahora llamamos la fórmula de interpolación de Whittaker-Shannon como se mencionó anteriormente. No deriva ni prueba las propiedades de la función sinc, pero estos habrían sido familiares para los ingenieros que leyeron sus trabajos en ese momento, ya que la relación de pares de Fourier entre rect (la función rectangular) y sinc era bien conocida.

- Vamos xn{displaystyle x_{n} ser el nT muestra. Luego la función x()t){displaystyle x(t)} está representado por:

- x()t)=.. n=− − JUEGO JUEGO JUEGO JUEGO xnpecado ()π π ()2Bt− − n))π π ()2Bt− − n).{displaystyle x(t)=sum _{n=-infty }{infty }x_{n}{sin(pi (2Bt-n) over pi (2Bt-n)}.}

Al igual que en la otra prueba, se supone la existencia de la transformada de Fourier de la señal original, por lo que la prueba no dice si el teorema de muestreo se extiende a procesos aleatorios estacionarios de banda limitada.

Notas

- ^ Multiplicación de ambos lados Eq.2 por T=1/2B{displaystyle T=1/2B} produce, a la izquierda, los valores de muestra escalada ()T⋅ ⋅ x()nT)){displaystyle (Tcdot x(nT)} en la fórmula de PoissonEq.1), y, a la derecha, la fórmula real para los coeficientes de expansión Fourier.

Aplicación a señales e imágenes multivariables

El teorema de muestreo generalmente se formula para funciones de una sola variable. En consecuencia, el teorema es directamente aplicable a señales dependientes del tiempo y normalmente se formula en ese contexto. Sin embargo, el teorema de muestreo se puede extender de manera directa a funciones de muchas variables arbitrarias. Las imágenes en escala de grises, por ejemplo, a menudo se representan como conjuntos (o matrices) bidimensionales de números reales que representan las intensidades relativas de los píxeles (elementos de imagen) ubicados en las intersecciones de las ubicaciones de muestra de fila y columna. Como resultado, las imágenes requieren dos variables independientes, o índices, para especificar cada píxel de manera única: una para la fila y otra para la columna.

Las imágenes en color generalmente consisten en una combinación de tres imágenes separadas en escala de grises, una para representar cada uno de los tres colores primarios: rojo, verde y azul, o RGB para abreviar. Otros espacios de color que utilizan 3 vectores para colores incluyen HSV, CIELAB, XYZ, etc. Algunos espacios de color como cian, magenta, amarillo y negro (CMYK) pueden representar el color en cuatro dimensiones. Todos estos se tratan como funciones con valores vectoriales sobre un dominio muestreado bidimensional.

Al igual que las señales unidimensionales de tiempo discreto, las imágenes también pueden sufrir alias si la resolución de muestreo o la densidad de píxeles no son adecuadas. Por ejemplo, una fotografía digital de una camisa a rayas con altas frecuencias (en otras palabras, la distancia entre las rayas es pequeña), puede provocar el alias de la camisa cuando el sensor de imagen de la cámara toma una muestra. El alias aparece como un patrón muaré. La "solución" para un mayor muestreo en el dominio espacial para este caso sería acercarse a la camiseta, usar un sensor de mayor resolución o desenfocar ópticamente la imagen antes de adquirirla con el sensor usando un filtro óptico de paso bajo.

Otro ejemplo se muestra a la derecha en los patrones de ladrillos. La imagen superior muestra los efectos cuando no se cumple la condición del teorema de muestreo. Cuando el software cambia la escala de una imagen (el mismo proceso que crea la miniatura que se muestra en la imagen inferior), en efecto, primero pasa la imagen a través de un filtro de paso bajo y luego reduce la resolución de la imagen para dar como resultado una imagen más pequeña que no muestra el patrón muaré. La imagen superior es lo que sucede cuando se reduce la resolución de la imagen sin filtrado de paso bajo: resultados de aliasing.

El teorema de muestreo se aplica a los sistemas de cámara, donde la escena y la lente constituyen una fuente de señal espacial analógica y el sensor de imagen es un dispositivo de muestreo espacial. Cada uno de estos componentes se caracteriza por una función de transferencia de modulación (MTF), que representa la resolución precisa (ancho de banda espacial) disponible en ese componente. Los efectos de aliasing o desenfoque pueden ocurrir cuando el MTF de la lente y el MTF del sensor no coinciden. Cuando la imagen óptica que es muestreada por el dispositivo sensor contiene frecuencias espaciales más altas que el sensor, el submuestreo actúa como un filtro de paso bajo para reducir o eliminar el solapamiento. Cuando el área del punto de muestreo (el tamaño del sensor de píxeles) no es lo suficientemente grande como para proporcionar un suavizado espacial suficiente, se puede incluir un filtro de suavizado separado (filtro óptico de paso bajo) en un sistema de cámara para reducir el MTF de la imagen óptica. En lugar de requerir un filtro óptico, la unidad de procesamiento de gráficos de las cámaras de los teléfonos inteligentes realiza un procesamiento de señal digital para eliminar el alias con un filtro digital. Los filtros digitales también aplican nitidez para amplificar el contraste de la lente a altas frecuencias espaciales, que de otro modo cae rápidamente en los límites de difracción.

El teorema de muestreo también se aplica al posprocesamiento de imágenes digitales, como el muestreo ascendente o descendente. Los efectos de alias, desenfoque y nitidez se pueden ajustar con el filtrado digital implementado en el software, que necesariamente sigue los principios teóricos.

Frecuencia crítica

Para ilustrar la necesidad 2B}" xmlns="http://www.w3.org/1998/Math/MathML">fs■2B{displaystyle f_{s} {cH00}]2B}" aria-hidden="true" class="mwe-math-fallback-image-inline" src="https://wikimedia.org/api/rest_v1/media/math/render/svg/d24f0da66615708f8a8dc48bdcfad2eb38044033" style="vertical-align: -0.671ex; width:8.167ex; height:2.509ex;"/>, considerar la familia de los sinusoides generados por diferentes valores de Silencio Silencio {displaystyle theta } en esta fórmula:

- <math alttext="{displaystyle x(t)={frac {cos(2pi Bt+theta)}{cos(theta)}} = cos(2pi Bt)-sin(2pi Bt)tan(theta),quad -pi /2<theta x()t)=# ()2π π Bt+Silencio Silencio )# ()Silencio Silencio )=# ()2π π Bt)− − pecado ()2π π Bt)# ()Silencio Silencio ),− − π π /2.Silencio Silencio .π π /2.{displaystyle x(t)={frac {cos(2pi) Bt+theta)} {cos(theta)} =\cos(2pi Bt)-sin(2pi Bt)tan(theta),quad -pi /2 madetheta Identificadapi /2.}<img alt="x(t)={frac {cos(2pi Bt+theta)}{cos(theta)}} = cos(2pi Bt)-sin(2pi Bt)tan(theta),quad -pi /2<theta

Con fs=2B{displaystyle f_{s}=2B} o equivalente T=1/2B{displaystyle T=1/2B}, las muestras son dadas por:

- x()nT)=# ()π π n)− − pecado ()π π n)⏟ ⏟ 0# ()Silencio Silencio )=()− − 1)n{displaystyle x(nT)=cos(pi n)-underbrace {sin(pi n)} _{0}tan(theta)=(-1)^{n}

independientemente del valor de Silencio Silencio {displaystyle theta }. Esa clase de ambigüedad es la razón de la estricto desigualdad de la condición del teorema de muestreo.

Muestreo de señales que no son de banda base

Como comenta Shannon:

Un resultado similar es cierto si la banda no comienza con cero frecuencia pero con algún valor superior, y puede ser probado por una traducción lineal (correspondiendo físicamente a la modulación de banda única) del caso de cero frecuencia. En este caso el pulso elemental se obtiene del pecado(x)/x por modulación de banda única.

Es decir, existe una condición sin pérdida suficiente para muestrear señales que no tienen componentes de banda base que implica el ancho del intervalo de frecuencia distinto de cero en oposición a su componente de frecuencia más alta. Consulte Muestreo (procesamiento de señales) para obtener más detalles y ejemplos.

Por ejemplo, para muestrear las señales de radio FM en el rango de frecuencia de 100 a 102 MHz, no es necesario muestrear a 204 MHz (el doble de la frecuencia superior), sino que basta con muestrear a 4 MHz. (dos veces el ancho del intervalo de frecuencia).

Una condición de paso de banda es que X(f) = 0, para todas las f no negativas fuera de la banda abierta de frecuencias:

La función de interpolación correspondiente es la respuesta de impulso de un filtro de paso de banda de pared de ladrillo ideal (a diferencia del filtro de paso bajo de pared de ladrillo ideal que se usó anteriormente) con cortes en los bordes superior e inferior de la banda especificada, que es la diferencia entre un par de respuestas de impulso de paso bajo:

También son posibles otras generalizaciones, por ejemplo, para señales que ocupan múltiples bandas no contiguas. Incluso la forma más generalizada del teorema de muestreo no tiene un recíproco demostrablemente verdadero. Es decir, no se puede concluir que la información se pierde necesariamente solo porque no se cumplen las condiciones del teorema de muestreo; sin embargo, desde una perspectiva de ingeniería, generalmente es seguro asumir que si no se cumple el teorema de muestreo, lo más probable es que se pierda información.

Muestreo no uniforme

La teoría de muestreo de Shannon se puede generalizar para el caso de muestreo no uniforme, es decir, muestras que no se toman con el mismo intervalo de tiempo. La teoría de muestreo de Shannon para el muestreo no uniforme establece que una señal de banda limitada se puede reconstruir perfectamente a partir de sus muestras si la tasa de muestreo promedio satisface la condición de Nyquist. Por lo tanto, aunque las muestras uniformemente espaciadas pueden resultar en algoritmos de reconstrucción más fáciles, no es una condición necesaria para una reconstrucción perfecta.

La teoría general para muestras no uniformes y de banda base no fue desarrollada en 1967 por Henry Landau. Demostró que la tasa de muestreo promedio (uniforme o no) debe ser el doble del ancho de banda ocupado de la señal, asumiendo que a priori se sabe qué porción del espectro estaba ocupada. A fines de la década de 1990, este trabajo se amplió parcialmente para cubrir señales cuya cantidad de ancho de banda ocupado se conocía, pero se desconocía la porción ocupada real del espectro. En la década de 2000, se desarrolló una teoría completa (consulte la sección Muestreo debajo de la tasa de Nyquist bajo restricciones adicionales a continuación) usando detección comprimida. En particular, la teoría, utilizando lenguaje de procesamiento de señales, se describe en este artículo de 2009. Muestran, entre otras cosas, que si se desconocen las ubicaciones de frecuencia, entonces es necesario muestrear al menos el doble de los criterios de Nyquist; en otras palabras, debe pagar al menos un factor de 2 por no saber la ubicación del espectro. Tenga en cuenta que los requisitos mínimos de muestreo no garantizan necesariamente la estabilidad.

Muestreo por debajo de la tasa de Nyquist bajo restricciones adicionales

El teorema de muestreo de Nyquist-Shannon proporciona una condición suficiente para el muestreo y la reconstrucción de una señal de banda limitada. Cuando la reconstrucción se realiza a través de la fórmula de interpolación de Whittaker-Shannon, el criterio de Nyquist también es una condición necesaria para evitar el aliasing, en el sentido de que si las muestras se toman a una velocidad inferior al doble del límite de banda, entonces hay algunas señales que no ser reconstruido correctamente. Sin embargo, si se imponen más restricciones a la señal, es posible que el criterio de Nyquist ya no sea una condición necesaria.

Un ejemplo no trivial de la explotación de suposiciones adicionales sobre la señal es el campo reciente de la detección comprimida, que permite una reconstrucción completa con una frecuencia de muestreo inferior a la de Nyquist. Específicamente, esto se aplica a las señales que son escasas (o comprimibles) en algún dominio. Por ejemplo, la detección comprimida trata con señales que pueden tener un ancho de banda general bajo (por ejemplo, el ancho de banda efectivo EB), pero las ubicaciones de frecuencia son desconocidas, en lugar de todos juntos en una sola banda, por lo que no se aplica la técnica de banda de paso. En otras palabras, el espectro de frecuencia es escaso. Tradicionalmente, la frecuencia de muestreo necesaria es, por lo tanto, 2B. Utilizando técnicas de detección comprimidas, la señal podría reconstruirse perfectamente si se muestrea a una velocidad ligeramente inferior a 2EB. Con este enfoque, la reconstrucción ya no viene dada por una fórmula, sino por la solución de un programa de optimización lineal.

Otro ejemplo en el que el muestreo sub-Nyquist es óptimo surge bajo la restricción adicional de que las muestras se cuantifican de manera óptima, como en un sistema combinado de muestreo y compresión con pérdida óptima. Esta configuración es relevante en los casos en los que se va a considerar el efecto conjunto del muestreo y la cuantificación, y puede proporcionar un límite inferior para el error mínimo de reconstrucción que se puede lograr al muestrear y cuantificar una señal aleatoria. Para señales aleatorias gaussianas estacionarias, este límite inferior generalmente se alcanza a una tasa de muestreo inferior a Nyquist, lo que indica que el muestreo inferior a Nyquist es óptimo para este modelo de señal con una cuantificación óptima.

Antecedentes históricos

El teorema de muestreo fue implícito en el trabajo de Harry Nyquist en 1928, en el que demostró que hasta 2B muestras de pulso independientes podían enviarse a través de un sistema de ancho de banda B; pero no consideró explícitamente el problema del muestreo y reconstrucción de señales continuas. Aproximadamente al mismo tiempo, Karl Küpfmüller mostró un resultado similar y discutió la respuesta de impulso de función sinc de un filtro limitador de banda, a través de su integral, la integral de seno de respuesta escalonada; este filtro de reconstrucción y limitación de banda que es tan central en el teorema de muestreo a veces se denomina filtro de Küpfmüller (pero rara vez en inglés).

El teorema de muestreo, esencialmente un dual del resultado de Nyquist, fue demostrado por Claude E. Shannon. El matemático E. T. Whittaker publicó resultados similares en 1915, J. M. Whittaker en 1935 y Gabor en 1946 ("Teoría de la comunicación").

En 1948 y 1949, Claude E. Shannon publicó dos artículos revolucionarios en los que fundaba la teoría de la información. En Shannon 1948, el teorema de muestreo se formula como "Teorema 13": Sea f(t) sin frecuencias sobre W. Entonces

- f()t)=.. n=− − JUEGO JUEGO JUEGO JUEGO Xnpecado π π ()2Wt− − n)π π ()2Wt− − n),{displaystyle f(t)=sum _{n=-infty }{infty }X_{n}{frac {sin pi (2Wt-n)}{pi (2Wt-n)}}}}} Donde Xn=f()n2W){displaystyle ¿Qué?.

No fue hasta que se publicaron estos artículos que el teorema conocido como "teorema de muestreo de Shannon" se convirtió en propiedad común entre los ingenieros de comunicación, aunque el propio Shannon escribe que este es un hecho de conocimiento común en el arte de la comunicación. Unas líneas más adelante, sin embargo, agrega: 'pero a pesar de su evidente importancia, no parece haber aparecido explícitamente en la literatura de la teoría de la comunicación'.

Otros descubridores

Otros que han descubierto de forma independiente o han jugado un papel en el desarrollo del teorema de muestreo han sido discutidos en varios artículos históricos, por ejemplo, por Jerri y por Lüke. Por ejemplo, Lüke señala que H. Raabe, asistente de Küpfmüller, demostró el teorema en su Ph.D. de 1939. disertación; el término condición de Raabe se asoció con el criterio de representación inequívoca (tasa de muestreo superior al doble del ancho de banda). Meijering menciona varios otros descubridores y nombres en un párrafo y un par de notas al pie:

Como señaló Higgins [135], el teorema de muestreo debe ser realmente considerado en dos partes, como se hizo anteriormente: el primero indicando el hecho de que una función de banda limitada está completamente determinada por sus muestras, el segundo describiendo cómo reconstruir la función utilizando sus muestras. Ambas partes del teorema de muestreo fueron dadas en una forma algo diferente por J. M. Whittaker [350, 351, 353] y ante él también por Ogura [241, 242]. Probablemente no eran conscientes del hecho de que la primera parte del teorema había sido declarada tan pronto como 1897 por Borel [25].27 Como hemos visto, Borel también usó alrededor de ese tiempo lo que se convirtió en la serie cardenal. Sin embargo, parece que no ha hecho el enlace [135]. En años posteriores se dio a conocer que el teorema de muestreo había sido presentado ante Shannon a la comunidad de comunicación rusa por Kotel'nikov [173]. En forma más implícita, verbal, también había sido descrito en la literatura alemana por Raabe [257]. Varios autores [33, 205] han mencionado que Someya [296] introdujo el teorema en la literatura japonesa paralela a Shannon. En la literatura inglesa, Weston [347] la introdujo independientemente de Shannon alrededor del mismo tiempo.28

27 Varios autores, después de Black [16], han afirmado que esta primera parte del teorema de muestreo fue declarado incluso antes por Cauchy, en un documento [41] publicado en 1841. Sin embargo, el documento de Cauchy no contiene tal declaración, como ha señalado Higgins [135].

28 Como consecuencia del descubrimiento de las varias introducciones independientes del teorema de muestreo, la gente comenzó a referirse al teorema incluyendo los nombres de los autores mencionados, lo que dio lugar a tales frases de captura como “el Whittaker–Kotel’nikov–Shannon (WKS) muestreando teorema” [155] o incluso "el Whittaker–Kotel'nikov–Raabe–Shanling33 Para evitar la confusión, tal vez lo mejor que hay que hacer es referirse a ella como el teorema de muestreo, "en lugar de tratar de encontrar un título que hace justicia a todos los reclamantes" [136].

¿Por qué Nyquist?

Exactamente cómo, cuándo o por qué Harry Nyquist asignó su nombre al teorema de muestreo sigue sin estar claro. El término Teorema de muestreo de Nyquist (en mayúsculas) apareció ya en 1959 en un libro de su antiguo empleador, Bell Labs, y volvió a aparecer en 1963, y sin mayúsculas en 1965. Había sido llamado el Teorema de muestreo de Shannon ya en 1954, pero también el teorema de muestreo de varios otros libros a principios de la década de 1950.

En 1958, Blackman y Tukey citaron el artículo de Nyquist de 1928 como referencia para el teorema de muestreo de la teoría de la información, aunque ese artículo no trata el muestreo y la reconstrucción de señales continuas como otros. hizo. Su glosario de términos incluye estas entradas:

- Teorema de muestreo (de teoría de la información)

- El resultado de Nyquist de que los datos equiespados, con dos o más puntos por ciclo de mayor frecuencia, permite la reconstrucción de funciones limitadas por banda. (Véase Cardenal teorema.)

- Cardenal teorema (de la teoría de la interpolación)

- Una declaración precisa de las condiciones bajo las cuales los valores dados en un conjunto doblemente infinito de puntos igualmente espaciados pueden ser interpolados para producir una función límite de banda continuo con la ayuda de la función pecado ()x− − xi)x− − xi.{displaystyle {frac {sin(x-x_{i}}{x-x_{i}}}}

Exactamente lo que "el resultado de Nyquist" se refieren a restos misteriosos.

Cuando Shannon declaró y probó el teorema de muestreo en su artículo de 1949, según Meijering, "se refirió al intervalo de muestreo crítico T=12W{displaystyle T={frac}{2W}} como Intervalo de Nyquist correspondiente a la banda W, en reconocimiento del descubrimiento de Nyquist de la importancia fundamental de este intervalo en relación con la telegrafía". Esto explica el nombre de Nyquist en el intervalo crítico, pero no en el teorema.

Del mismo modo, el nombre de Nyquist se adjuntó a la tasa de Nyquist en 1953 por Harold S. Black:

"Si el rango de frecuencia esencial se limita a B ciclos por segundo, 2B fue dado por Nyquist como el número máximo de elementos de código por segundo que podrían ser resueltos inequívocamente, asumiendo que la interferencia máxima es menos medio paso cuántico. Esta tasa se conoce generalmente como señalización a la tasa de Nyquist y 12B{displaystyle {frac}{2B}} has been termed a Intervalo de Nyquist." (bold añadido para el énfasis; itálicos como en el original)

Según el OED, este puede ser el origen del término tasa de Nyquist. En el uso de Black, no es una frecuencia de muestreo, sino una frecuencia de señalización.

Notas

- ^ La función sinc sigue de las filas 202 y 102 de las tablas de transformación

- ^ Shannon 1949, pág. 448.

Contenido relacionado

Intervalo (matemáticas)

Zirconia cúbica

Carabina

![{displaystyle x[n]triangleq x(nT)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8e12e67988c6d79f0bd6aee5446a72e7d9931164)

![{displaystyle x[n]triangleq Tcdot x(nT),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2c2e6da77d863281dc13db3bfc74fddf54cc3dbb)

![{displaystyle x[n].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cabd8cfc8b8a4029b91a93a4f13c740c14469084)

![{displaystyle [B, f_{s}-B]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/02b743a70365b24e59b3d3fc11cffabc30107bd0)