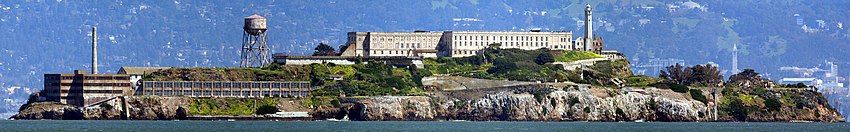

Unión de imágenes

Unir imágenes o unir fotografías es el proceso de combinar múltiples imágenes fotográficas con campos de visión superpuestos para producir un panorama segmentado o una imagen de alta resolución. Comúnmente realizado mediante el uso de software de computadora, la mayoría de los enfoques para unir imágenes requieren superposiciones casi exactas entre imágenes y exposiciones idénticas para producir resultados perfectos, aunque algunos algoritmos de unión en realidad se benefician de imágenes expuestas de manera diferente al generar imágenes de alto rango dinámico en regiones de superposición. . Algunas cámaras digitales pueden unir sus fotografías internamente.

Aplicaciones

La unión de imágenes se utiliza ampliamente en aplicaciones modernas, como las siguientes:

- Papel mosaico

- Función de estabilización de imagen en videocámaras que utilizan alineación de imagen de tipo marco

- mosaicos de imagen de alta resolución en mapas digitales e imágenes satelitales

- Imágenes médicas

- Imágenes de super-resolución de imagen múltiple

- Bodas de vídeo

- Inserción en objetos

Proceso

El proceso de unión de imágenes se puede dividir en tres componentes principales: registro de imágenes, calibración y fusión.

Algoritmos de unión de imágenes

Para estimar la alineación de la imagen, se necesitan algoritmos para determinar el modelo matemático apropiado que relaciona las coordenadas de píxeles de una imagen con las coordenadas de píxeles de otra. Se pueden utilizar algoritmos que combinan comparaciones directas de píxel a píxel con descenso de gradiente (y otras técnicas de optimización) para estimar estos parámetros.

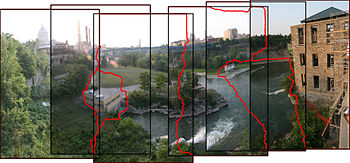

Se pueden encontrar características distintivas en cada imagen y luego combinarlas de manera eficiente para establecer rápidamente correspondencias entre pares de imágenes. Cuando existen múltiples imágenes en un panorama, se han desarrollado técnicas para calcular un conjunto globalmente consistente de alineaciones y descubrir de manera eficiente qué imágenes se superponen entre sí.

Se necesita una superficie de composición final sobre la cual deformar o transformar proyectivamente y colocar todas las imágenes alineadas, al igual que algoritmos para combinar perfectamente las imágenes superpuestas, incluso en presencia de paralaje, distorsión de la lente, movimiento de la escena y diferencias de exposición. .

Problemas de unión de imágenes

Dado que no se puede garantizar que la iluminación en dos vistas sea idéntica, unir dos imágenes podría crear una costura visible. Otras razones de las costuras podrían ser el cambio de fondo entre dos imágenes para el mismo primer plano continuo. Otros problemas importantes a tratar son la presencia de paralaje, distorsión de la lente, movimiento de la escena y diferencias de exposición. En un caso no ideal de la vida real, la intensidad varía en toda la escena, al igual que el contraste y la intensidad entre fotogramas. Además, es necesario tener en cuenta la relación de aspecto de una imagen panorámica para crear una composición visualmente agradable.

Para la unión panorámica, el conjunto ideal de imágenes tendrá una cantidad razonable de superposición (al menos entre un 15 y un 30 %) para superar la distorsión de la lente y tener suficientes características detectables. El conjunto de imágenes tendrá una exposición constante entre fotogramas para minimizar la probabilidad de que se produzcan costuras.

Detección de puntos clave

La detección de características es necesaria para encontrar automáticamente correspondencias entre imágenes. Se requieren correspondencias sólidas para estimar la transformación necesaria para alinear una imagen con la imagen sobre la que se está componiendo. Las esquinas, las manchas, las esquinas de Harris y las diferencias de las esquinas gaussianas de Harris son buenas características ya que son repetibles y distintas.

Uno de los primeros operadores para la detección de puntos de interés fue desarrollado por Hans P. Moravec en 1977 por su investigación sobre la navegación automática de un robot a través de un entorno agrupado. Moravec también definió el concepto de "puntos de interés" en una imagen y concluyó que estos puntos de interés podrían usarse para encontrar regiones coincidentes en diferentes imágenes. El operador Moravec se considera un detector de esquinas porque define puntos de interés como puntos donde hay grandes variaciones de intensidad en todas las direcciones. Este suele ser el caso en las esquinas. Sin embargo, Moravec no estaba específicamente interesado en encontrar esquinas, sólo regiones distintas en una imagen que pudieran usarse para registrar cuadros de imagen consecutivos.

Harris y Stephens mejoraron el detector de esquinas de Moravec al considerar directamente el diferencial de la puntuación de esquina con respecto a la dirección. Lo necesitaban como paso de procesamiento para construir interpretaciones del entorno de un robot basadas en secuencias de imágenes. Al igual que Moravec, necesitaban un método para hacer coincidir puntos correspondientes en cuadros de imágenes consecutivos, pero estaban interesados en rastrear tanto las esquinas como los bordes entre cuadros.

SIFT y SURF son algoritmos recientes de detección de puntos clave o de interés, pero un punto a tener en cuenta es que SURF está patentado y su uso comercial está restringido. Una vez que se ha detectado una característica, se puede aplicar un método de descriptor como el descriptor SIFT para compararla posteriormente.

Registro

El registro de imágenes implica hacer coincidir características en un conjunto de imágenes o utilizar métodos de alineación directa para buscar alineaciones de imágenes que minimicen la suma de diferencias absolutas entre píxeles superpuestos. Cuando se utilizan métodos de alineación directa, primero se pueden calibrar las imágenes para obtener mejores resultados. Además, los usuarios pueden ingresar un modelo aproximado del panorama para ayudar en la etapa de coincidencia de características, de modo que, por ejemplo. sólo se buscan imágenes vecinas para encontrar características coincidentes. Dado que hay un grupo más pequeño de funciones para comparar, el resultado de la búsqueda es más preciso y la ejecución de la comparación es más rápida.

Para estimar un modelo robusto a partir de los datos, se utiliza un método común conocido como RANSAC. El nombre RANSAC es una abreviatura de "RANdom SAmple Consensus". Es un método iterativo para una estimación robusta de parámetros para ajustar modelos matemáticos a partir de conjuntos de puntos de datos observados que pueden contener valores atípicos. El algoritmo no es determinista en el sentido de que produce un resultado razonable sólo con una cierta probabilidad, probabilidad que aumenta a medida que se realizan más iteraciones. Al ser un método probabilístico significa que se obtendrán resultados diferentes cada vez que se ejecute el algoritmo.

El algoritmo RANSAC ha encontrado muchas aplicaciones en visión por computadora, incluida la resolución simultánea del problema de correspondencia y la estimación de la matriz fundamental relacionada con un par de cámaras estéreo. El supuesto básico del método es que los datos constan de “valores internos”, es decir, datos cuya distribución puede explicarse mediante algún modelo matemático, y “valores atípicos” de datos. los cuales son datos que no se ajustan al modelo. Se consideran valores atípicos puntos que provienen de ruido, mediciones erróneas o simplemente datos incorrectos.

Para el problema de estimación de homografía, RANSAC trabaja intentando ajustar varios modelos utilizando algunos de los pares de puntos y luego comprobando si los modelos fueron capaces de relacionar la mayoría de los puntos. Luego se elige el mejor modelo (la homografía, que produce el mayor número de coincidencias correctas) como respuesta al problema; por lo tanto, si la proporción entre el número de valores atípicos y los puntos de datos es muy baja, RANSAC genera un modelo decente que se ajusta a los datos.

Calibración

LaCalibración de imagen tiene como objetivo minimizar las diferencias entre los modelos de lentes ideales y la combinación cámara-lente que se utilizó, defectos ópticos como distorsiones, diferencias de exposición entre imágenes, viñeteado, respuesta de la cámara y aberraciones cromáticas. Si se usaron métodos de detección de características para registrar imágenes y se registraron y guardaron posiciones absolutas de las características, el software de unión puede usar los datos para la optimización geométrica de las imágenes además de colocar las imágenes en la panosfera. Panotools y sus diversos programas derivados utilizan este método.

Alineación

Es posible que sea necesario alinear una imagen para que coincida con el punto de vista de la imagen con la que se está componiendo. La alineación, en términos simples, es un cambio en el sistema de coordenadas para que adopte un nuevo sistema de coordenadas que genere una imagen que coincida con el punto de vista requerido. Los tipos de transformaciones por las que puede pasar una imagen son traslación pura, rotación pura, una transformación de similitud que incluye traslación, rotación y escalado de la imagen que necesita ser transformada, transformación afín o proyectiva.

La transformación proyectiva es lo máximo que una imagen puede transformar (en el conjunto de transformaciones planas bidimensionales), donde solo las características visibles que se conservan en la imagen transformada son líneas rectas, mientras que el paralelismo se mantiene en una transformación afín.

La transformación proyectiva se puede describir matemáticamente como

- x’ = H ⋅ ⋅ {displaystyle cdot } x,

donde x son puntos en el antiguo sistema de coordenadas, x' son los puntos correspondientes en la imagen transformada y H es la matriz de homografía.

Expresar los puntos x y x' usando los intrínsecos de la cámara (K y K') y su rotación y traslación [R t] a las coordenadas del mundo real X y X ', obtenemos

- x = K ⋅ ⋅ {displaystyle cdot } [R t] ⋅ ⋅ {displaystyle cdot } X y x’ = K’ ⋅ ⋅ {displaystyle cdot } [R' t'] ⋅ ⋅ {displaystyle cdot } X’.

Usando las dos ecuaciones anteriores y la relación de homografía entre x’ y x, podemos derivar

- H = K’ ⋅ ⋅ {displaystyle cdot } R’ ⋅ ⋅ {displaystyle cdot } R−1 ⋅ ⋅ {displaystyle cdot } K−1

La matriz de homografía H tiene 8 parámetros o grados de libertad. La homografía se puede calcular mediante transformación lineal directa y descomposición de valores singulares con

- A ⋅ ⋅ {displaystyle cdot } h = 0,

donde A es la matriz construida utilizando las coordenadas de correspondencias y h es el vector unidimensional de los 9 elementos de la matriz de homografía reformada. Para llegar a h podemos aplicar sencillamente SVD: A = U ⋅ ⋅ {displaystyle cdot } S ⋅ ⋅ {displaystyle cdot } V TY h = V (columna correspondiente al vector singular más pequeño). Esto es cierto ya que h se encuentra en el espacio nulo de A. Dado que tenemos 8 grados de libertad, el algoritmo requiere al menos cuatro correspondencias de puntos. En caso de que se utilice RANSAC para estimar la homografía y múltiples correspondencias estén disponibles la matriz homográfica correcta es la que tiene el número máximo de inliers.

Composición

La composición es el proceso en el que las imágenes rectificadas se alinean de tal manera que aparecen como una sola toma de una escena. La composición se puede realizar automáticamente ya que el algoritmo ahora sabe qué correspondencias se superponen.

Mezcla

Lamezcla de imágenes implica ejecutar los ajustes calculados en la etapa de calibración, combinados con la reasignación de las imágenes a una proyección de salida. Los colores se ajustan entre imágenes para compensar las diferencias de exposición. Si corresponde, la fusión de alto rango dinámico se realiza junto con la compensación de movimiento y la eliminación de fantasmas. Las imágenes se combinan y se realiza un ajuste de la línea de unión para minimizar la visibilidad de las uniones entre imágenes.

La costura se puede reducir mediante un simple ajuste de ganancia. Esta compensación básicamente minimiza la diferencia de intensidad de los píxeles superpuestos. El algoritmo de fusión de imágenes asigna más peso a los píxeles cerca del centro de la imagen. Las imágenes combinadas con ganancia compensada y multibanda son las que mejor se comparan. IJCV 2007.

El alisado es otro método para rectificar la imagen. Matthew Brown y David G. Lowe en su artículo 'Cosido automático de imágenes panorámicas utilizando características invariantes' describen métodos de enderezamiento que aplican una rotación global tal que el vector u es vertical (en el marco de renderizado), lo que elimina efectivamente el efecto ondulado de los panoramas de salida. Este proceso es similar a la rectificación de imágenes y, más generalmente, a la corrección por software de distorsiones ópticas en fotografías individuales.

Incluso después de la compensación de ganancia, algunos bordes de la imagen siguen siendo visibles debido a una serie de errores no modelados. efectos, como viñeteado (la intensidad disminuye hacia el borde de la imagen), efectos de paralaje debido a movimientos no deseados del centro óptico, errores de registro incorrecto debido al mismo desmontaje de la cámara, distorsión radial, etc. Por estas razones, proponen una estrategia de combinación denominada combinación multibanda.

Diseños proyectivos

Para segmentos de imágenes que se han tomado desde el mismo punto en el espacio, las imágenes unidas se pueden organizar utilizando una de varias proyecciones cartográficas.

Rectilíneo

Proyección rectilínea, donde la imagen unida se ve en un plano bidimensional que cruza la panosfera en un solo punto. Las líneas que en realidad son rectas se muestran rectas independientemente de sus direcciones en la imagen. Las vistas amplias (alrededor de 120° aproximadamente) comienzan a exhibir una distorsión severa cerca de los bordes de la imagen. Un caso de proyección rectilínea es el uso de caras cúbicas con mapeo cúbico para visualización panorámica. El panorama se asigna a seis cuadrados, cada cara del cubo muestra un área de 90 por 90 grados del panorama.

Cilíndrica

(feminine)Proyección cilíndrica, donde la imagen unida muestra un campo de visión horizontal de 360° y un campo de visión vertical limitado. Las panorámicas de esta proyección deben verse como si la imagen estuviera envuelta en un cilindro y vista desde dentro. Cuando se ven en un plano 2D, las líneas horizontales parecen curvas mientras que las líneas verticales permanecen rectas. La distorsión vertical aumenta rápidamente al acercarse a la cima de la panosfera. Hay varios otros formatos cilíndricos, como los cilíndricos de Mercator y Miller, que tienen menos distorsión cerca de los polos de la panosfera.

Esférico

()vista como un panorama interactivo 360°)

Proyección esférica o proyección equirectangular, que en sentido estricto es otra proyección cilíndrica, donde la imagen unida muestra un campo de visión horizontal de 360° por vertical de 180°, es decir, el conjunto. esfera. Las panorámicas de esta proyección deben verse como si la imagen estuviera envuelta en una esfera y vista desde dentro. Cuando se ven en un plano 2D, las líneas horizontales aparecen curvadas como en una proyección cilíndrica, mientras que las líneas verticales permanecen verticales.

Panini

Dado que un panorama es básicamente un mapa de una esfera, si así se desea, también se pueden utilizar otras proyecciones cartográficas de cartógrafos. Además, existen proyecciones especializadas que pueden tener ventajas estéticas más agradables que las proyecciones cartográficas normales, como la proyección Panini de Hugin, que lleva el nombre del pintor de vedutismo italiano Giovanni Paolo Panini, o la proyección de Vedutismo de PTgui. Se pueden combinar diferentes proyecciones en la misma imagen para ajustar el aspecto final de la imagen de salida.

Estereográfico

Se puede utilizar una proyección estereográfica o de ojo de pez para formar un panorama de pequeño planeta apuntando la cámara virtual hacia abajo y configurando el campo de visión lo suficientemente grande como para mostrar todo el terreno y algunas de las áreas superiores. él; Apuntar la cámara virtual hacia arriba crea un efecto de túnel. La conformidad de la proyección estereográfica puede producir resultados visualmente más agradables que la proyección de ojo de pez de igual área, como se analiza en el artículo sobre proyección estereográfica.

Artefactos

El uso de imágenes no tomadas desde el mismo lugar (en un pivote alrededor de la pupila de entrada de la cámara) puede provocar errores de paralaje en el producto final. Cuando la escena capturada presenta movimientos rápidos o dinámicos, pueden ocurrir artefactos como resultado de diferencias de tiempo entre los segmentos de la imagen. "Costura ciega" A través de métodos de alineación basados en características (ver costura automática), a diferencia de la selección y unión manuales, puede causar imperfecciones en el ensamblaje del panorama.

Software

Los programas dedicados incluyen Autostitch, Hugin, Ptgui, Panorama Tools, Microsoft Research Image Composite Editor y CleVR Stitcher. Muchos otros programas también pueden unir varias imágenes; un ejemplo popular es Adobe Systems' Photoshop, que incluye una herramienta conocida como Photomerge y, en las últimas versiones, el nuevo Auto-Blend. Otros programas como VideoStitch permiten unir vídeos y Vahana VR permite unir vídeos en tiempo real. El módulo Image Stitching para el software de microscopio QuickPHOTO permite unir de forma interactiva múltiples campos de visión desde el microscopio utilizando la vista en vivo de la cámara. También se puede utilizar para unir manualmente muestras completas de microscopía.