Teoría de probabilidad

La teoría de la probabilidad es la rama de las matemáticas que se ocupa de la probabilidad. Aunque hay varias interpretaciones de probabilidad diferentes, la teoría de la probabilidad trata el concepto de manera matemática rigurosa al expresarlo a través de un conjunto de axiomas. Por lo general, estos axiomas formalizan la probabilidad en términos de un espacio de probabilidad, que asigna una medida que toma valores entre 0 y 1, denominada medida de probabilidad, a un conjunto de resultados denominado espacio muestral. Cualquier subconjunto especificado del espacio muestral se denomina evento. Los temas centrales de la teoría de la probabilidad incluyen variables aleatorias discretas y continuas, distribuciones de probabilidad y procesos estocásticos (que proporcionan abstracciones matemáticas de procesos no deterministas o inciertos o cantidades medidas que pueden ser ocurrencias únicas o evolucionar con el tiempo de forma aleatoria). Aunque no es posible predecir perfectamente eventos aleatorios, se puede decir mucho sobre su comportamiento. Dos resultados importantes en la teoría de la probabilidad que describen tal comportamiento son la ley de los grandes números y el teorema del límite central.

Como base matemática para las estadísticas, la teoría de la probabilidad es esencial para muchas actividades humanas que implican el análisis cuantitativo de datos. Los métodos de la teoría de la probabilidad también se aplican a las descripciones de sistemas complejos dado solo un conocimiento parcial de su estado, como en la mecánica estadística o la estimación secuencial. Un gran descubrimiento de la física del siglo XX fue la naturaleza probabilística de los fenómenos físicos a escala atómica, descritos en la mecánica cuántica.

Historia de la probabilidad

La moderna teoría matemática de la probabilidad tiene sus raíces en los intentos de analizar los juegos de azar de Gerolamo Cardano en el siglo XVI, y de Pierre de Fermat y Blaise Pascal en el siglo XVII (por ejemplo, el "problema de los puntos& #34;). Christiaan Huygens publicó un libro sobre el tema en 1657. En el siglo XIX, Pierre Laplace completó lo que se considera la definición clásica de probabilidad.

Inicialmente, la teoría de la probabilidad consideraba principalmente eventos discretos, y sus métodos eran principalmente combinatorios. Eventualmente, las consideraciones analíticas obligaron a la incorporación de variables continuas en la teoría.

Esto culminó en la moderna teoría de la probabilidad, sobre los cimientos establecidos por Andrey Nikolaevich Kolmogorov. Kolmogorov combinó la noción de espacio muestral, introducida por Richard von Mises, y la teoría de la medida y presentó su sistema de axiomas para la teoría de la probabilidad en 1933. Esto se convirtió en la base axiomática mayoritariamente indiscutible de la teoría de la probabilidad moderna; pero existen alternativas, como la adopción de aditividad finita en lugar de numerable por Bruno de Finetti.

Tratamiento

La mayoría de las introducciones a la teoría de la probabilidad tratan las distribuciones de probabilidad discretas y las distribuciones de probabilidad continuas por separado. El tratamiento de la probabilidad basado en la teoría de la medida cubre lo discreto, lo continuo, una combinación de los dos y más.

Motivación

Considere un experimento que pueda producir varios resultados. El conjunto de todos los resultados se denomina espacio muestral del experimento. El conjunto potencia del espacio muestral (o, de manera equivalente, el espacio de eventos) se forma considerando todas las diferentes colecciones de resultados posibles. Por ejemplo, lanzar un dado honesto produce uno de seis resultados posibles. Una colección de posibles resultados corresponde a obtener un número impar. Así, el subconjunto {1,3,5} es un elemento del conjunto potencia del espacio muestral de tiradas de dados. Estas colecciones se denominan eventos. En este caso, {1,3,5} es el evento de que el dado cae en algún número impar. Si los resultados que realmente ocurren caen en un evento dado, se dice que ese evento ha ocurrido.

La probabilidad es una forma de asignar cada "evento" un valor entre cero y uno, con el requisito de que al evento formado por todos los resultados posibles (en nuestro ejemplo, el evento {1,2,3,4,5,6}) se le asigne el valor uno. Para calificar como una distribución de probabilidad, la asignación de valores debe cumplir el requisito de que si observa una colección de eventos mutuamente excluyentes (eventos que no contienen resultados comunes, por ejemplo, los eventos {1,6}, {3} y { 2,4} son todos mutuamente excluyentes), la probabilidad de que cualquiera de estos eventos ocurra está dada por la suma de las probabilidades de los eventos.

La probabilidad de que ocurra cualquiera de los eventos {1,6}, {3} o {2,4} es 5/6. Esto es lo mismo que decir que la probabilidad del evento {1,2,3,4,6} es 5/6. Este evento abarca la posibilidad de que salga cualquier número excepto cinco. El evento mutuamente excluyente {5} tiene una probabilidad de 1/6, y el evento {1,2,3,4,5,6} tiene una probabilidad de 1, es decir, certeza absoluta.

Al hacer cálculos utilizando los resultados de un experimento, es necesario que todos esos eventos elementales tengan un número asignado a ellos. Esto se hace utilizando una variable aleatoria. Una variable aleatoria es una función que asigna a cada evento elemental en el espacio de muestra un número real. Esta función generalmente es denotada por una letra mayúscula. En el caso de un fallecimiento, la asignación de un número a ciertos eventos elementales se puede hacer utilizando la función de identidad. Esto no siempre funciona. Por ejemplo, al voltear una moneda los dos posibles resultados son "cabezas" y "talles". En este ejemplo, la variable aleatoria X podría asignar al resultado "cabezas" el número "0" () y al resultado "tallas" el número "1" ().

Distribuciones de probabilidad discretas

La teoría de la probabilidad discreta se ocupa de los eventos que ocurren en espacios muestrales contables.

Ejemplos: lanzamiento de dados, experimentos con barajas de cartas, paseo aleatorio y lanzamiento de monedas

Definición clásica: Inicialmente, la probabilidad de que ocurra un evento se definió como el número de casos favorables para el evento, sobre el número de resultados totales posibles en un espacio muestral equiprobable: ver Definición clásica de probabilidad.

Por ejemplo, si el evento es "ocurrencia de un número aún cuando se roda una muerte", la probabilidad es dada por , ya que 3 caras de los 6 tienen incluso números y cada cara tiene la misma probabilidad de aparecer.

Definición moderna: La definición moderna comienza con un conjunto finito o contable llamado espacio de muestra, que se relaciona con el conjunto de todos posibles resultados en sentido clásico, denotado por . Se supone entonces que para cada elemento , un valor intrínseco de "probabilidad" se adjunta, que satisface las siguientes propiedades:

Es decir, la función de probabilidad f()x) mentiras entre cero y uno por cada valor de x en el espacio de la muestra Ω, y la suma de f()x) sobre todos los valores x en el espacio de la muestra Ω es igual a 1. An evento se define como cualquier subconjunto del espacio de la muestra . El probabilidad del evento se define como

Entonces, la probabilidad de todo el espacio muestral es 1 y la probabilidad del evento nulo es 0.

La función mapear un punto en el espacio de muestra al valor de "probabilidad" se llama un función de masa de probabilidad abreviado como F. La definición moderna no trata de responder cómo se obtienen las funciones de masa de probabilidad; en cambio, construye una teoría que asume su existencia.

Distribuciones de probabilidad continua

La teoría de la probabilidad continua se ocupa de los eventos que ocurren en un espacio muestral continuo.

Definición clásica: La definición clásica se rompe cuando se confronta con el caso continuo. Vea la paradoja de Bertrand.

Definición moderna: Si el espacio de muestra de una variable aleatoria X es el conjunto de números reales () o un subconjunto de ellos, luego una función llamada el función de distribución acumulativa (o cdf) existe, definida por . Eso es, F()x) devuelve la probabilidad de que X será inferior o igual a x.

La cdf necesariamente satisface las siguientes propiedades.

- es una función monotonicamente no creciente, derecha-continua;

La variable aleatoria se dice que tiene una distribución de probabilidad continua si el cdf correspondiente es continuo. Si es absolutamente continuo, es decir, su derivado existe e integrar el derivado nos da el cdf de nuevo, luego la variable aleatoria X se dice que tiene un función de densidad de probabilidad o pdf o simplemente densidad

Para un set , la probabilidad de la variable aleatoria X estar en es

En caso de que exista la función de densidad de probabilidad, esto se puede escribir como

Mientras que pdf existe sólo para variables aleatorias continuas, cdf existe para todas las variables aleatorias (incluyendo variables discretas aleatorias) que toman valores en

Estos conceptos pueden generalizarse para casos multidimensionales y otros espacios de muestra continua.

Teoría de la probabilidad teórica de la medida

La razón de ser del tratamiento teórico de la medida de la probabilidad es que unifica los casos discretos y continuos, y hace que la diferencia sea una cuestión de qué medida se utiliza. Además, cubre distribuciones que no son ni discretas ni continuas ni mezclas de las dos.

Un ejemplo de estas distribuciones podría ser una mezcla de distribuciones discretas y continuas, por ejemplo, una variable aleatoria que es 0 con probabilidad 1/2, y toma un valor aleatorio de una distribución normal con probabilidad 1/2. Todavía se puede estudiar en cierta medida considerando que tiene un pdf , donde es la función Dirac delta.

Es posible que otras distribuciones ni siquiera sean una combinación; por ejemplo, la distribución de Cantor no tiene probabilidad positiva para ningún punto único, ni tampoco tiene densidad. El enfoque moderno de la teoría de la probabilidad resuelve estos problemas utilizando la teoría de la medida para definir el espacio de probabilidad:

Dado cualquier conjunto (también llamado muestra espacio) y un álgebra σ en ella, una medida definidas se llama Medida de probabilidad si

Si es el Borel σ-algebra en el conjunto de números reales, entonces hay una medida de probabilidad única en por cualquier cdf, y viceversa. Se dice que la medida correspondiente a un cdf inducida por el cdf. Esta medida coincide con la pf para variables discretas y pdf para variables continuas, haciendo que el enfoque teórico-medida sea libre de falacias.

El probabilidad de un conjunto en el álgebra se define como

donde la integración es con respecto a la medida inducido por

Junto con proporcionar una mejor comprensión y unificación de probabilidades discretas y continuas, el tratamiento teórico-medida también nos permite trabajar en probabilidades externas , como en la teoría de los procesos estocásticos. Por ejemplo, para estudiar el movimiento de Brownian, la probabilidad se define en un espacio de funciones.

Cuando es conveniente trabajar con una medida dominante, se utiliza el teorema de Radon-Nikodym para definir una densidad como la derivada de Radon-Nikodym de la distribución de probabilidad de interés con respecto a esta medida dominante. Las densidades discretas generalmente se definen como esta derivada con respecto a una medida de conteo sobre el conjunto de todos los resultados posibles. Las densidades para distribuciones absolutamente continuas se definen generalmente como esta derivada con respecto a la medida de Lebesgue. Si un teorema puede probarse en este marco general, se cumple tanto para distribuciones discretas como continuas, así como para otras; no se requieren pruebas separadas para distribuciones discretas y continuas.

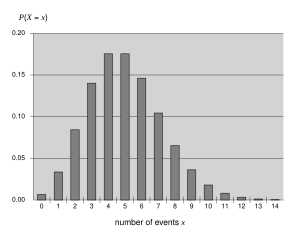

Distribuciones de probabilidad clásicas

Ciertas variables aleatorias ocurren con mucha frecuencia en la teoría de la probabilidad porque describen bien muchos procesos naturales o físicos. Sus distribuciones, por lo tanto, han ganado importancia especial en la teoría de la probabilidad. Algunas distribuciones discretas fundamentales son las distribuciones uniforme discreta, de Bernoulli, binomial, binomial negativa, de Poisson y geométrica. Las distribuciones continuas importantes incluyen las distribuciones continua uniforme, normal, exponencial, gamma y beta.

Convergencia de variables aleatorias

En la teoría de la probabilidad, existen varias nociones de convergencia para variables aleatorias. Se enumeran a continuación en orden de fuerza, es decir, cualquier noción posterior de convergencia en la lista implica convergencia de acuerdo con todas las nociones anteriores.

- Convergencia débil

- Una secuencia de variables aleatorias convergencias débil a la variable aleatoria si sus respectivos acumulativos Funciones de distribución converger en la función de distribución acumulativa de , donde sea es continuo. La convergencia débil también se llama convergencia en la distribución.

- Notación de mano corta más común:

- Convergencia en probabilidad

- La secuencia de variables aleatorias se dice que convergen hacia la variable aleatoria en probabilidad si para todos los ε 0.

- Notación de mano corta más común:

- Convergencia fuerte

- La secuencia de variables aleatorias se dice que convergen hacia la variable aleatoria firmemente si . Una fuerte convergencia también se conoce como casi seguro convergencia.

- Notación de mano corta más común:

Como indican los nombres, la convergencia débil es más débil que la convergencia fuerte. De hecho, una convergencia fuerte implica una convergencia en probabilidad, y una convergencia en probabilidad implica una convergencia débil. Las afirmaciones inversas no siempre son verdaderas.

Ley de los grandes números

La intuición común sugiere que si se lanza una moneda al aire muchas veces, aproximadamente la mitad de las veces saldrá cara y la otra mitad saldrá colas. Además, cuanto más a menudo se lanza la moneda, más probable es que la relación entre el número de caras y el número de cruces se acerque a la unidad. La teoría moderna de la probabilidad proporciona una versión formal de esta idea intuitiva, conocida como la ley de los grandes números. Esta ley es notable porque no se asume en los fundamentos de la teoría de la probabilidad, sino que surge de estos fundamentos como un teorema. Dado que vincula las probabilidades derivadas teóricamente con su frecuencia real de ocurrencia en el mundo real, la ley de los grandes números se considera un pilar en la historia de la teoría estadística y ha tenido una amplia influencia.

La ley de los grandes números (LLN) establece que el promedio de la muestra

de una secuencia de Variables aleatorias distribuidas idénticamente converge hacia su expectativa común , siempre que la expectativa es finito.

Es en las diferentes formas de convergencia de variables aleatorias que separa la débil y la fuerte ley de los grandes números

- Ley débil: para

- Ley fuerte: para

Se deduce del LLN que si un evento de probabilidad p se observa repetidamente durante experimentos independientes, la relación entre la frecuencia observada de ese evento y el número total de repeticiones converge hacia p .

Por ejemplo, si son independientes Bernoulli variables aleatorias tomando valores 1 con probabilidad p y 0 con probabilidad 1-p, entonces para todos iAsí que convergencias a p Casi seguro.

Teorema límite central

El teorema del límite central (CLT) explica la aparición ubicua de la distribución normal en la naturaleza, y este teorema, según David Williams, "es uno de los grandes resultados de las matemáticas".

El teorema afirma que el promedio de muchas variables aleatorias independientes y distribuidas idénticamente con varianza finita tiende a una distribución normal independientemente de la distribución seguida por las variables aleatorias originales. Formally, déjalo ser variables aleatorias independientes con media y diferencia Luego la secuencia de variables aleatorias

converge en distribución a una variable aleatoria normal estándar.

Para algunas clases de variables aleatorias, el clásico teorema del límite central funciona bastante rápido, como se ilustra en el teorema de Berry-Esseen. Por ejemplo, las distribuciones con primer, segundo y tercer momento finitos de la familia exponencial; por otro lado, para algunas variables aleatorias de la variedad heavy tail y fat tail, funciona muy lentamente o puede no funcionar en absoluto: en tales casos, se puede usar el Teorema del Límite Central Generalizado (GCLT).

Contenido relacionado

Problema de correspondencia postal

Urbain Le Verrier

Espacio T1

![f(x)in [0,1]{mbox{ for all }}xin Omega ,;](https://wikimedia.org/api/rest_v1/media/math/render/svg/d9fb6901c7d0c1686386da77b3a2af38bc0d7952)

![(delta [x]+varphi (x))/2](https://wikimedia.org/api/rest_v1/media/math/render/svg/b59e7c343760eb33e805760c20aff9d9c3831260)

![delta [x]](https://wikimedia.org/api/rest_v1/media/math/render/svg/3953eacd8865ec4c182566de1728419117164d2c)