Red neuronal con picos

Las redes neuronales con picos (SNN) son redes neuronales artificiales (ANN) que imitan de forma más precisa a las redes neuronales naturales. Estos modelos aprovechan la sincronización de picos discretos como principal portador de información.

Además del estado neuronal y sináptico, las redes neuronales supranucleares incorporan el concepto de tiempo en su modelo operativo. La idea es que las neuronas de las redes neuronales supranucleares no transmiten información en cada ciclo de propagación (como sucede con las típicas redes perceptrónicas multicapa), sino que transmiten información sólo cuando un potencial de membrana (una cualidad intrínseca de la neurona relacionada con su carga eléctrica de membrana) alcanza un valor específico, llamado umbral. Cuando el potencial de membrana alcanza el umbral, la neurona se activa y genera una señal que viaja a otras neuronas que, a su vez, aumentan o disminuyen sus potenciales en respuesta a esta señal. Un modelo de neurona que se activa en el momento en que se cruza el umbral también se denomina modelo de neurona en descarga.

Aunque antes se creía que el cerebro codificaba la información a través de tasas de picos, que pueden considerarse como la salida variable analógica de una ANN tradicional, la investigación en el campo de la neurobiología ha indicado que el procesamiento a alta velocidad no puede realizarse únicamente a través de un esquema basado en la tasa. Por ejemplo, los humanos pueden realizar una tarea de reconocimiento de imágenes a una tasa que no requiere más de 10 ms de tiempo de procesamiento por neurona a través de las capas sucesivas (desde la retina hasta el lóbulo temporal). Esta ventana de tiempo es demasiado corta para una codificación basada en la tasa. Los tiempos de pico precisos en un pequeño conjunto de neuronas que emiten picos también tienen una mayor capacidad de codificación de información en comparación con un enfoque basado en la tasa.

El modelo de neurona con picos más destacado es el modelo de integración y disparo con fugas. En este modelo, el nivel de activación momentáneo (modelado como una ecuación diferencial) se considera normalmente el estado de la neurona, y los picos entrantes aumentan o disminuyen este valor hasta que el estado finalmente decae o, si se alcanza el umbral de disparo, la neurona se activa. Después del disparo, la variable de estado se restablece a un valor inferior.

Existen varios métodos de decodificación para interpretar el tren de picos saliente como un número de valor real, basándose en la frecuencia de los picos (código de velocidad), el tiempo hasta el primer pico después de la estimulación o el intervalo entre picos.

Historia

Muchas redes neuronales artificiales multicapa están completamente conectadas, reciben información de cada neurona de la capa anterior y envían señales a cada neurona de la capa siguiente. Aunque estas redes han logrado avances en muchos campos, son biológicamente inexactas y no imitan el mecanismo de funcionamiento de las neuronas en el cerebro de un ser vivo.

El modelo de Hodgkin-Huxley, de inspiración biológica, de una neurona en actividad, fue propuesto en 1952. Este modelo describe cómo se inician y propagan los potenciales de acción. La comunicación entre neuronas, que requiere el intercambio de neurotransmisores químicos en el espacio sináptico, se describe en varios modelos, como el modelo de integración y disparo, el modelo de FitzHugh-Nagumo (1961-1962) y el modelo de Hindmarsh-Rose (1984). El modelo de integración y disparo con fugas (o un derivado) se utiliza comúnmente porque es más fácil de calcular que el modelo de Hodgkin-Huxley.

Si bien la noción de red neuronal artificial de picos se hizo muy popular recién durante el primer cuarto del siglo XXI, existen numerosos estudios entre 1980 y 1995 que respaldaron el concepto y en los que aparecieron los primeros modelos de este tipo de redes neuronales artificiales para simular sistemas inteligentes de procesamiento de información no algorítmicos. Sin embargo, la noción misma de red neuronal de picos como modelo matemático ya había sido trabajada a principios de los años 70.

Fundamentos

La información en el cerebro se representa como potenciales de acción (picos neuronales), que pueden agruparse en trenes de picos o incluso en ondas coordinadas de actividad cerebral. Una cuestión fundamental de la neurociencia es determinar si las neuronas se comunican mediante un código temporal o de ritmo. La codificación temporal sugiere que una única neurona que emite picos puede reemplazar a cientos de unidades ocultas en una red neuronal sigmoidea.

Una red neuronal segmentada (SNN) realiza sus cálculos en el dominio continuo en lugar del discreto. La idea es que las neuronas no puedan comprobar si se activan en cada iteración de propagación (como es el caso de una red perceptrónica multicapa típica), sino solo cuando sus potenciales de membrana alcanzan un valor determinado. Cuando una neurona se activa, produce una señal que se transmite a las neuronas conectadas, aumentando o disminuyendo su potencial de membrana.

En una red neuronal con picos, el estado actual de una neurona se define como su potencial de membrana (posiblemente modelado como una ecuación diferencial). Un pulso de entrada hace que el potencial de membrana aumente durante un período de tiempo y luego disminuya gradualmente. Se han construido esquemas de codificación para interpretar estas secuencias de pulsos como un número, teniendo en cuenta tanto la frecuencia como el intervalo de pulso. Se puede establecer un modelo de red neuronal basado en el tiempo de generación de pulsos. Al utilizar el tiempo exacto de ocurrencia del pulso, una red neuronal puede emplear más información y ofrecer mejores propiedades de computación.

El enfoque SNN produce una salida continua en lugar de la salida binaria de las redes neuronales artificiales (ANN) tradicionales. Los trenes de pulsos no son fácilmente interpretables, de ahí la necesidad de esquemas de codificación como los anteriores. Sin embargo, una representación de tren de pulsos puede ser más adecuada para procesar datos espaciotemporales (o clasificación continua de datos sensoriales del mundo real). Las SNN consideran el espacio conectando neuronas solo con neuronas cercanas para que procesen bloques de entrada por separado (similar a CNN usando filtros). Consideran el tiempo codificando la información como trenes de pulsos para no perder información en una codificación binaria. Esto evita la complejidad adicional de una red neuronal recurrente (RNN). Resulta que las neuronas de impulso son unidades computacionales más poderosas que las neuronas artificiales tradicionales.

Las SNN son teóricamente más potentes que las llamadas "redes de segunda generación", definidas como "[ANN] basadas en unidades computacionales que aplican una función de activación con un conjunto continuo de posibles valores de salida a una suma ponderada (o polinomio) de las entradas; sin embargo, los problemas de entrenamiento de las SNN y los requisitos de hardware limitan su uso. Aunque existen métodos de aprendizaje no supervisados inspirados en la biología, como el aprendizaje hebbiano y el STDP, no existe ningún método de entrenamiento supervisado efectivo que sea adecuado para las SNN y que pueda proporcionar un mejor rendimiento que las redes de segunda generación. La activación basada en picos de las SNN no es diferenciable, por lo que resulta difícil desarrollar métodos de entrenamiento basados en el descenso de gradiente para realizar la retropropagación de errores.

Las SNN tienen costos computacionales mucho mayores para simular modelos neuronales realistas que las ANN tradicionales.

Las redes neuronales acopladas a pulsos (PCNN) suelen confundirse con las SNN. Una PCNN puede considerarse como un tipo de SNN.

Actualmente, existen algunos desafíos al utilizar redes neuronales restringidas en los que los investigadores están trabajando activamente. El primer desafío se refiere a la no diferenciabilidad de la no linealidad de picos. Las expresiones para los métodos de aprendizaje hacia adelante y hacia atrás contienen la derivada de la función de activación neuronal, que no es diferenciable porque la salida de la neurona es 1 cuando se dispara y 0 en caso contrario. Este comportamiento de todo o nada de la no linealidad de picos binarios impide que los gradientes "fluyan" y hace que las neuronas LIF no sean adecuadas para la optimización basada en gradientes. El segundo desafío se refiere a la implementación del algoritmo de optimización en sí. La BP estándar puede ser costosa en términos de computación, memoria y comunicación y puede ser poco adecuada para las restricciones dictadas por el hardware que la implementa (por ejemplo, una computadora, un cerebro o un dispositivo neuromórfico). Con respecto al primer desafío, existen varios enfoques para resolverlo. Algunos de ellos son:

- recurrir a reglas de aprendizaje local totalmente inspiradas biológicamente para las unidades ocultas

- Traductor de NN convencionalmente entrenados “basados en tasa” a SNN

- suavizar el modelo de red para ser continuamente diferente

- definir un SG (Surrogate Gradient) como una relajación continua de los gradientes reales

En el desarrollo de las redes neuronales de subsuelo, la incorporación de dinámicas neuronales adicionales como la Adaptación de la Frecuencia de Espigas (SFA, por sus siglas en inglés) en los modelos neuronales marca un avance notable, mejorando tanto la eficiencia como la potencia computacional. Estas neuronas se encuentran entre la complejidad biológica y la complejidad computacional. La SFA, que se origina a partir de conocimientos biológicos, ofrece importantes beneficios computacionales al reducir el uso de energía mediante una codificación eficiente, especialmente en casos de estímulos repetitivos o intensos. Esta adaptación mejora la claridad de la señal frente al ruido de fondo e introduce una memoria elemental a corto plazo a nivel neuronal, que a su vez, refina la precisión y la eficiencia del procesamiento de la información. Recientemente, este fenómeno se logró principalmente utilizando modelos neuronales compartimentados. Las versiones más simples son modelos neuronales con umbrales adaptativos, una forma indirecta de lograr la SFA. Equipa a las redes neuronales de subsuelo con capacidades de aprendizaje mejoradas, incluso con plasticidad sináptica restringida, y eleva la eficiencia computacional. Esta característica reduce la demanda de las capas de red al disminuir la necesidad de procesamiento de picos, lo que reduce la carga computacional y el tiempo de acceso a la memoria, aspectos esenciales de la computación neuronal. Además, las SNN que utilizan neuronas capaces de SFA logran niveles de precisión que rivalizan con los de las redes neuronales artificiales convencionales, incluidas las basadas en modelos de memoria a corto plazo a largo plazo, al tiempo que requieren menos neuronas para tareas computacionales comparables. Esta eficiencia no solo agiliza el flujo de trabajo computacional, sino que también conserva espacio y energía, lo que ofrece un avance pragmático en la aplicación práctica de las SNN para tareas computacionales complejas, al tiempo que mantiene un compromiso con la integridad técnica. Redes neuronales de picos profundos de alto rendimiento con 0,3 picos por neurona

Aplicaciones

Las SNN pueden, en principio, aplicarse a las mismas aplicaciones que las ANN tradicionales. Además, las SNN pueden modelar el sistema nervioso central de organismos biológicos, como un insecto que busca alimento sin conocimiento previo del entorno. Debido a su realismo relativo, pueden utilizarse para estudiar el funcionamiento de circuitos neuronales biológicos. Partiendo de una hipótesis sobre la topología de un circuito neuronal biológico y su función, las grabaciones de este circuito pueden compararse con la salida de la SNN correspondiente, evaluando la plausibilidad de la hipótesis. Sin embargo, existe una falta de mecanismos de entrenamiento efectivos para las SNN, lo que puede resultar inhibidor para algunas aplicaciones, incluidas las tareas de visión artificial.

A partir de 2019, las SNN están por detrás de las ANN en términos de precisión, pero la brecha está disminuyendo y ha desaparecido en algunas tareas.

Al utilizar redes neuronales de red para datos basados en imágenes, las imágenes deben convertirse en trenes de picos binarios. Los tipos de codificaciones incluyen:

- Codificación temporal; generando un pico por neurona, en el que la latencia del pico es inversamente proporcional a la intensidad del píxel.

- Codificación de tarifas: convertir la intensidad del píxel en un tren de punta, donde el número de espigas es proporcional a la intensidad del píxel.

- Codificación directa; usando una capa capacitable para generar un valor de punto flotante para cada paso de tiempo. La capa convierte cada pixel en un determinado paso en un valor de punto flotante, y luego se utiliza un umbral en los valores de punto flotante generados para elegir cero o uno.

- Codificación de fases; codificación de información temporal en patrones de pico basados en un oscilador global.

- Codificación del entierro; transmisión de una explosión de picos en un pequeño tiempo, aumentando la fiabilidad de la comunicación sináptica entre las neuronas.

Software

Existe una amplia gama de software de aplicación que puede simular redes neuronales retículas. Este software se puede clasificar según sus usos:

Simulación SNN

Estos simulan modelos neuronales complejos con un alto nivel de detalle y precisión. Las redes grandes suelen requerir un procesamiento prolongado. Los candidatos incluyen:

- Brian – desarrollado por Romain Brette y Dan Goodman en la École Normale Supérieure;

- GENESIS (sistema de simulación neuronural GEneral) - desarrollado en el laboratorio de James Bower en Caltech;

- NEST – desarrollado por la Iniciativa NEST;

- NEURON - desarrollado principalmente por Michael Hines, John W. Moore y Ted Carnevale en la Universidad de Yale y Duke University;

- RAVSim (Runtime Tool) - desarrollado principalmente por Sanaullah en la Universidad de Bielefeld de Ciencias Aplicadas y Artes;

Hardware

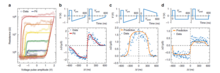

Las futuras arquitecturas neuromórficas comprenderán miles de millones de estas nanosinapsis, que requieren una comprensión clara de los mecanismos físicos responsables de la plasticidad. Se han utilizado sistemas experimentales basados en uniones túnel ferroeléctricas para demostrar que la STDP se puede aprovechar a partir de la conmutación de polarización heterogénea. Mediante la combinación de imágenes de sonda de barrido, transporte eléctrico y dinámica molecular a escala atómica, las variaciones de conductancia se pueden modelar mediante la inversión de dominios dominada por la nucleación. Las simulaciones muestran que las matrices de nanosinapsis ferroeléctricas pueden aprender de forma autónoma a reconocer patrones de una manera predecible, abriendo el camino hacia el aprendizaje no supervisado.

- Akida es un dispositivo de procesamiento neuronal completamente digital basado en eventos con 1,2 millones de neuronas artificiales y 10 mil millones de sinapsis artificiales desarrolladas por BrainChip. Utilizando la posesión basada en eventos, analiza insumos esenciales en puntos específicos. Los resultados se almacenan en las unidades de memoria en chip.

- Neurogrid es un tablero que puede simular las redes neuronales de arañazo directamente en hardware. (Stanford University)

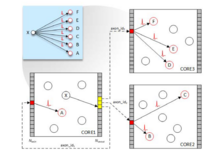

- SpiNNaker (Spiking Neural Network Architecture) utiliza procesadores ARM como bloques de construcción de una plataforma de cálculo masivamente paralela basada en un modelo thalamocortical de seis capas. (Universidad de Manchester) El sistema SpiNNaker se basa en modelos numéricos que funcionan en tiempo real en chips multicore digitales personalizados utilizando la arquitectura ARM. Proporciona chips digitales personalizados, cada uno con dieciocho núcleos y una RAM local compartida 128 Mbyte, con un total de más de 1.000.000 núcleos. Un solo chip puede simular 16.000 neuronas con ocho millones de sinapsis de plástico funcionando en tiempo real.

- TrueNorth es un procesador que contiene 5.4 billones de transistores que consume sólo 70 milliwatts; la mayoría de los procesadores en computadoras personales contienen alrededor de 1.400 millones de transistores y requieren 35 vatios o más. IBM se refiere al principio de diseño detrás de TrueNorth como computación neuromorfo. Su propósito principal es el reconocimiento de patrones. Mientras los críticos dicen que el chip no es lo suficientemente poderoso, sus partidarios señalan que esto es sólo la primera generación, y las capacidades de las iteraciones mejoradas se volverán claras. (IBM)

Criterios

Las capacidades de clasificación de las redes de picos entrenadas según métodos de aprendizaje no supervisado se han probado en los conjuntos de datos de referencia comunes, como los conjuntos de datos Iris, Wisconsin Breast Cancer o Statlog Landsat. Se han utilizado varios enfoques para la codificación de la información y el diseño de redes. Por ejemplo, una red de avance de dos capas para la agrupación y clasificación de datos. Basándose en la idea propuesta en Hopfield (1995), los autores implementaron modelos de campos receptivos locales que combinan las propiedades de las funciones de base radial (RBF) y las neuronas de picos para convertir las señales de entrada (datos clasificados) que tienen una representación de punto flotante en una representación de picos.

Véase también

- CoDi

- Arquitectura cognitiva

- Mapa cognitivo

- Cognitive computer

- Neurociencia computacional

- Codificación neuronal

- Correlación neuronal

- Decodificación neural

- Neuroetología

- Neuroinformática

- Modelos de cálculo neuronal

- Percepción de movimiento

- Sistemas neurociencia

Referencias

- ^ a b Maass W (1997). "Networks of spiking neurons: The third generation of neural network models". Redes neuronales. 10 (9): 1659 –1671. doi:10.1016/S0893-6080(97)00011-7. ISSN 0893-6080.

- ^ Auge, Daniel; Hille, Julian; Mueller, Etienne; Knoll, Alois (2021-12-01). "A Survey of Encoding Techniques for Signal Processing in Spiking Neural Networks". Cartas de procesamiento neuronal. 53 (6): 4693 –4710. doi:10.1007/s11063-021-10562-2. ISSN 1573-773X.

- ^ Gerstner W, Kistler WM (2002). Modelos de neurona para espiar: neuronas individuales, poblaciones, plasticidad. Cambridge, Reino Unido: Cambridge University Press. ISBN 0-511-07817-X. OCLC 57417395.

- ^ Wang, Xiangwen; Lin, Xianghong; Dang, Xiaochao (2020-05-01). "Aprendizaje supervisado en redes neuronales: una revisión de algoritmos y evaluaciones". Redes neuronales. 125: 258–280. doi:10.1016/j.neunet.2020.02.011. ISSN 0893-6080. S2CID 212638634.

- ^ Taherkhani, Aboozar; Belatreche, Ammar; Li, Yuhua; Cosma, Georgina; Maguire, Liam P.; McGinnity, T. M. (2020-02-01). "Una revisión del aprendizaje en redes neuronales biológicamente plausibles". Redes neuronales. 122: 253 –272. doi:10.1016/j.neunet.2019.09.036. ISSN 0893-6080. S2CID 207904985.

- ^ a b Ganguly, Chittotosh; Bezugam, Sai Sukruth; Abs, Elisabeth; Payvand, Melika; Dey, Sounak; Suri, Manan (2024-02-01). "Adecuación de la frecuencia de las agujas: modelos neuromorféricos de cobertura y aplicaciones neuromórficas". Ingeniería de comunicaciones. 3 1): 22. doi:10.1038/s44172-024-00165-9. ISSN 2731-3395. PMC 11053160.

- ^ Lee D, Lee G, Kwon D, Lee S, Kim Y, Kim J (junio de 2018). "Flexon: una neurona digital flexible para simulaciones de redes neuronales eficientes". 2018 ACM/IEEE 45o Simposio Internacional Anual sobre Arquitectura Informática (ISCA). pp. 275–288. doi:10.1109/isca.2018.00032. ISBN 978-1-5386-5984-7. S2CID 50778421.

- ^ Goodman, D. F., " Brette, R. (2008). Brian: un simulador para espiar redes neuronales en pitón. Fronteras en neuroinformática, 2, 350.

- ^ Vreeken, J. (2003). Redes neuronales espiando, una introducción

- ^ Yamazaki, K.; Vo-Ho, V. K.; Bulsara, D.; Le, N (30 de junio de 2022). "Spiking neural networks and their applications: A review". Ciencias del cerebro. 12 (7): 863. doi:10.3390/brainsci12070863. PMC 9313413. PMID 35884670.

- ^ Ballard, D. H. (1987, julio). Aprendizaje modular en redes neuronales. En Proceedings of the sixth National conference on Artificial intelligence-Volume 1 (pp. 279-284).

- ^ Peretto, P. (1984). Propiedades colectivas de redes neuronales: un enfoque de física estadística. Cibernética biológica, 50(1), 51-62.

- ^ Kurogi, S. (1987). Un modelo de red neuronal para el reconocimiento de patrón espatiotemporal. Cybernetics biológicos, 57(1), 103-114.

- ^ Anderson, J. A. (1972). Una simple red neuronal generando una memoria interactiva. Biociencias matemáticas, 14(3-4), 197-220.

- ^ Gerstner W (2001). "Espiar neuronas". En Maass W, Obispo CM (eds.). Redes neuronales pulsadas. MIT Prensa. ISBN 978-0-262-63221-8.

- ^ Hodgkin, A. L.; Huxley, A. F. (1952-08-28). "Una descripción cuantitativa de la corriente de membrana y su aplicación a la conducción y excitación en el nervio". The Journal of Physiology. 117 4): 500 –544. doi:10.1113/jphysiol.1952.sp004764. ISSN 0022-3751. PMC 1392413. PMID 12991237.

- ^ Dan, Yang; Poo, Mu-Ming (julio de 2006). "Spike Timing-Dependent Plasticity: From Synapse to Perception". Fisiológica Reseñas. 86 3): 1033 –1048. doi:10.1152/physrev.00030.2005. ISSN 0031-9333. PMID 16816145.

- ^ Nagornov, Nikolay N.; Lyakhov, Pavel A.; Bergerman, Maxim V.; Kalita, Diana I. (2024). "Modern Trends in Improving the Technical Characteristics of Devices and Systems for Digital Image Processing". Acceso al IEEE. 12: 44659 –44681. Bibcode:2024IEEEA..1244659N. doi:10.1109/ACCESS.2024.3381493. ISSN 2169-3536.

- ^ Van Wezel M (2020). Una robusta metodología de formación de redes neuronales modulares para series de datos: Con un enfoque en el control de gestos (Tesis de la Ciencia). Delft University of Technology.

- ^ a b c Maass W (1997). "Networks of spiking neurons: The third generation of neural network models". Redes neuronales. 10 (9): 1659 –1671. doi:10.1016/S0893-6080(97)00011-7.

- ^ Furber, Steve (agosto de 2016). "Sistemas de computación neuromorfónica de escala alta". Journal of Neural Engineering. 13 (5): 051001. Bibcode:2016JNEng..13e1001F. doi:10.1088/1741-2560/13/5/051001. ISSN 1741-2552. PMID 27529195.

- ^ Neftci, Emre O.; Mostafa, Hesham; Zenke, Friedemann (2019). "Surrogate Gradient Learning in Spiking Neural Networks: Bringing the Power of Gradient-Based Optimization to Spiking Neural Networks". Revista de Procesamiento de Señal IEEE. 36 (6): 51 –63. Bibcode:2019ISPM...36f..51N. doi:10.1109/msp.2019.2931595.

- ^ Salaj, Darjan; Subramoney, Anand; Kraisnikovic, Ceca; Bellec, Guillaume; Legenstein, Robert; Maass, Wolfgang (2021-07-26). O'Leary, Timothy; Behrens, Timothy E; Gutierrez, Gabrielle (eds.). "La adaptación a la frecuencia de las pulsaciones es compatible con computaciones de red sobre la información dispersa temporal". eLife. 10: e65459. doi:10.7554/eLife.65459. ISSN 2050-084X. PMC 8313230. PMID 34310281.

- ^ Izhikevich, E.M. (2004). "¿Qué modelo utilizar para las neuronas de araña cortical?". Transacciones IEEE en redes neuronales. 15 5): 1063 –1070. doi:10.1109/tn.2004.832719. S2CID 7354646. Retrieved 2024-02-14.

- ^ Adibi, M., McDonald, J. S., Clifford, C. W. ' Arabzadeh, E. Adaptation mejora la eficiencia de codificación neuronal a pesar de las crecientes correlaciones en variabilidad. J. Neurosci. 33, 2108–2120 (2013)

- ^ Laughlin, S. (1981). "Un simple procedimiento de codificación aumenta la capacidad de información de una neurona". Zeitschrift für Naturforschung C. 36 ()9 –10): 910 –912. ISSN 0341-0382. PMID 7303823.

- ^ Querlioz, Damien; Bichler, Olivier; Dollfus, Philippe; Gamrat, Christian (2013). "Inmunity to Device Variations in a Spiking Neural Network with Memristive Nanodevices". Transacciones IEEE en Nanotecnología. 12 3): 288–295. Bibcode:2013ITNan..12..288Q. doi:10.1109/TNANO.2013.2250995. S2CID 14416573. Retrieved 2024-02-14.

- ^ Yamazaki, Kashu; Vo-Ho, Viet-Khoa; Bulsara, Darshan; Le, Ngan (Julio 2022). "Spiking Neural Networks and Their Applications: A Review". Ciencias del cerebro. 12 (7): 863. doi:10.3390/brainsci12070863. ISSN 2076-3425. PMC 9313413. PMID 35884670.

- ^ Shaban, Ahmed; Bezugam, Sai Sukruth; Suri, Manan (2021-07-09). "Una neurona umbral adaptativa para redes neuronales recidivas con implementación de hardware nanodispositivo". Nature Communications. 12 (1): 4234. Bibcode:2021NatCo..12.4234S. doi:10.1038/s41467-021-24427-8. ISSN 2041-1723. PMC 8270926. PMID 34244491.

- ^ Bellec, Guillaume; Salaj, Darjan; Subramoney, Anand; Legenstein, Robert; Maass, Wolfgang (2018-12-25), Memoria a corto plazo y aprendizaje a aprendizaje en redes de neuronas arañadoras, arXiv:1803.09574

- ^ Alnajjar F, Murase K (2008). "Una simple red neuronal como Aplia para generar comportamiento adaptativo en robots autónomos". Adaptive Behavior. 14 5): 306–324. doi:10.1177/1059712308093869. S2CID 16577867.

- ^ Zhang X, Xu Z, Henriquez C, Ferrari S (Dec 2013). "Adiestramiento indirecto a base de chorro de un insecto virtual controlado por la red neural". 52a Conferencia IEEE sobre Decisión y Control. pp. 6798 –6805. CiteSeerX 10.1.1.671.6351. doi:10.1109/CDC.2013.6760966. ISBN 978-1-4673-5717-3. S2CID 13992150.

- ^ Tavanaei A, Ghodrati M, Kheradpisheh SR, Masquelier T, Maida A (marzo 2019). "Deep learning in spiking neural networks". Redes neuronales. 111: 47 –63. arXiv:1804.08150. doi:10.1016/j.neunet.2018.12.002. PMID 30682710. S2CID 5039751.

- ^ Yamazaki K, Vo-Ho VK, Bulsara D, Le N (junio 2022). "Spiking Neural Networks and Their Applications: A Review". Ciencias del cerebro. 12 (7): 863. doi:10.3390/brainsci12070863. PMC 9313413. PMID 35884670.

- ^ Kim Y, Park H, Moitra A, Bhattacharjee A, Venkatesha Y, Panda P (2022-01-31). ¿Cuál es mejor para las redes neuronales precisas, robustas y energéticamente eficientes? arXiv:2202.03133 [cs.NE].

- ^ Abbott LF, Nelson SB (noviembre de 2000). "Psicología síntica: tocar a la bestia". Neurociencia. 3 (S11): 1178–1183. doi:10.1038/81453. PMID 11127835. S2CID 2048100.

- ^ Atiya AF, Parlos AG (mayo de 2000). "Nuevos resultados en el entrenamiento de red recurrente: unificar los algoritmos y acelerar la convergencia". Transacciones IEEE en redes neuronales. 11 3): 697 –709. doi:10.1109/72.846741. PMID 18249797.

- ^ Sanaullah S, Koravuna S, Rückert U, Jungeblut T (agosto 2023). "Evaluation of Spiking Neural Nets-Based Image Classification Using the Runtime Simulator RAVSim". International Journal of Neural Systems. 33 (9): 2350044. doi:10.1142/S0129065723500442. PMID 37604777. S2CID 259445644.

- ^ Sutton RS, Barto AG (2002) Reinforcement Learning: An Introduction. Bradford Books, MIT Press, Cambridge, MA.

- ^ Boyn S, Grollier J, Lecerf G, Xu B, Locatelli N, Fusil S, et al. (abril de 2017). "Aprendizaje a través de dinámicas de dominio ferroeléctrico en sinapsis de estado sólido". Nature Communications. 8: 14736. Bibcode:2017NatCo...814736B. doi:10.1038/ncomms14736. PMC 5382254. PMID 28368007.

- ^ Jin X, Furber SB, Woods JV (2008). "Modelo eficiente de redes neuronales de arañazo en un multiprocesador de chip escalable". 2008 IEEE International Joint Conference on Neural Networks (IEEE World Congress on Computational Intelligence). pp. 2812 –2819. doi:10.1109/IJCNN.2008.4634194. ISBN 978-1-4244-1820-6. S2CID 2103654.

- ^ "Computing neuromorfo". Human Brain Project.

- ^ "Hardware: Sistemas disponibles". Human Brain Project. Retrieved 2020-05-10.

- ^ Markoff J (8 de agosto de 2014). "Un nuevo chip funciona como un cerebro, dice IBM". El New York Times. P. B1.

- ^ Ponulak F, Kasiński A (febrero de 2010). "Aprendizaje supervisado en redes neuronales con ReSuMe: aprendizaje de secuencias, clasificación y cambio de picos". Computación neuronal. 22 2): 467 –510. doi:10.1162/neco.2009.11-08-901. PMID 19842989. S2CID 12572538.

- ^ Newman D, Hettich S, Blake C, Merz C (1998). "Repositorio de las bases de datos de aprendizaje automático".

- ^ Bohte S, Kok JN, La Poutré H (2002). "Error-backpropagation in temporally encoded networks of spiking neurons". Neurocomputación. 48 ()1 –4): 17 –37. doi:10.1016/S0925-2312(01)00658-0.

- ^ Pfister JP, Toyoizumi T, Barber D, Gerstner W (junio de 2006). "Psicología óptima dependiente de la estimulación de picos para la acción precisa potencial de disparo en el aprendizaje supervisado". Computación neuronal. 18 (6): 1318–1348. arXiv:q-bio/0502037. Bibcode:2005q.bio.....2037P. doi:10.1162/neco.2006.18.6.1318. PMID 16764506. S2CID 6379045.

- ^ Bohte SM, La Poutré H, Kok JN (marzo de 2002). "Unsupervised clustering with spiking neurons by escasa coding temporal and multilayer RBF networks". Transacciones IEEE en redes neuronales. 13 2): 426 –435. doi:10.1109/72.991428. PMID 18244443.