Reconocimiento de gestos

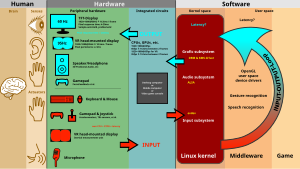

Gesture recognition es una esfera de investigación y desarrollo en la ciencia informática y la tecnología lingüística relacionada con el reconocimiento e interpretación de los gestos humanos. Una subdisciplina de visión informática, emplea algoritmos matemáticos para interpretar gestos.

El reconocimiento de Gesture ofrece un camino para que los ordenadores comiencen a comprender mejor e interpretar el lenguaje corporal humano, previamente no posible a través de interfaces gráficas (GUI) sin mejorar.

Los gestos pueden originarse a partir de cualquier movimiento o estado corporal, pero comúnmente se originan en la cara o la mano. Un área del campo es el reconocimiento de emociones derivadas de expresiones faciales y gestos con las manos. Los usuarios pueden realizar gestos sencillos para controlar o interactuar con los dispositivos sin tocarlos físicamente.

Se han realizado muchos enfoques utilizando cámaras y algoritmos de visión por computadora para interpretar el lenguaje de señas; sin embargo, la identificación y el reconocimiento de la postura, la marcha, la proxémica y los comportamientos humanos también es objeto de técnicas de reconocimiento de gestos.

Descripción general

El reconocimiento de gestos tiene aplicación en áreas tales como:

- Automóviles

- Consumer electronics

- Transit

- Gaming

- Dispositivos portátiles

- Defensa

- Automatización

- Traducción de lengua de señas automatizada

El reconocimiento de gestos se puede realizar con técnicas de visión por computadora y procesamiento de imágenes.

La literatura incluye trabajos en curso en el campo de la visión por computadora sobre la captura de gestos o posturas y movimientos humanos más generales mediante cámaras conectadas a una computadora.

El término "reconocimiento de gestos" se ha utilizado para referirse de manera más estricta a símbolos de escritura a mano que no son de entrada de texto, como la escritura manuscrita en una tableta gráfica, gestos multitáctiles y reconocimiento de gestos del mouse. Se trata de una interacción informática mediante el dibujo de símbolos con un cursor de dispositivo señalador. La computación con lápiz expande el reconocimiento de gestos digitales más allá de los dispositivos de entrada tradicionales, como teclados y ratones, y reduce el impacto del hardware de un sistema.

Tipos de gestos

En las interfaces de computadora, se distinguen dos tipos de gestos: consideramos gestos en línea, que también pueden considerarse manipulaciones directas como escalar y rotar y, por el contrario, los gestos fuera de línea generalmente se procesan una vez finalizada la interacción; mi. gramo. Se dibuja un círculo para activar un menú contextual.

- Cambios en línea: Los gestos que se procesan después de la interacción del usuario con el objeto. Un ejemplo es un gesto para activar un menú.

- Momentos en línea: Gestos de manipulación directa. Se utilizan para escalar o rotar un objeto tangible.

Interfaz sin contacto

Una interfaz de usuario sin contacto (TUI) es un tipo emergente de tecnología en la que un dispositivo se controla mediante movimientos corporales y gestos sin tocar el teclado, el mouse o la pantalla.

Tipos de tecnología sin contacto

Hay varios dispositivos que utilizan este tipo de interfaz, como teléfonos inteligentes, computadoras portátiles, juegos, televisores y equipos de música.

Un tipo de interfaz sin contacto utiliza la conectividad Bluetooth de un teléfono inteligente para activar el sistema de gestión de visitantes de una empresa. Esto elimina tener que tocar una interfaz, por conveniencia o para evitar una fuente potencial de contaminación como durante la pandemia de COVID-19.

Dispositivos de entrada

La capacidad de rastrear los movimientos de una persona y determinar qué gestos puede estar realizando se puede lograr a través de varias herramientas. Las interfaces de usuario cinéticas (KUI) son un tipo emergente de interfaces de usuario que permiten a los usuarios interactuar con dispositivos informáticos a través del movimiento de objetos y cuerpos. Ejemplos de KUI incluyen interfaces de usuario tangibles y juegos sensibles al movimiento como Wii y Kinect de Microsoft, y otros proyectos interactivos.

Aunque se ha realizado una gran cantidad de investigaciones sobre el reconocimiento de gestos basado en imágenes y vídeos, existen algunas variaciones en las herramientas y entornos utilizados entre las implementaciones.

- Guantes rojos. Estos pueden proporcionar entrada al ordenador sobre la posición y rotación de las manos utilizando dispositivos de rastreo magnéticos o inerciales. Además, algunos guantes pueden detectar la doblación de los dedos con un alto grado de precisión (5-10 grados), o incluso proporcionar retroalimentación hepática al usuario, que es una simulación del sentido del tacto. El primer dispositivo comercialmente disponible de tipo guante fue el DataGlove, un dispositivo tipo guante que podría detectar la posición de la mano, el movimiento y la curvatura de los dedos. Esto utiliza cables de fibra óptica corriendo por la parte posterior de la mano. Se crean pulsos de luz y cuando los dedos están doblados, se filtra luz a través de pequeñas grietas y se registra la pérdida, dando una aproximación de la pose de la mano.

- Cámaras desprevenidas. Utilizando cámaras especializadas como cámaras de luz estructuradas o de tiempo de vuelo, se puede generar un mapa de profundidad de lo que se está viendo a través de la cámara a corto plazo, y utilizar estos datos para aproximar una representación 3d de lo que se está viendo. Esto puede ser eficaz para la detección de gestos de mano debido a sus capacidades de corto alcance.

- Cámaras Stereo. Usando dos cámaras cuyas relaciones entre sí se conocen, una representación 3d puede ser aproximada por la salida de las cámaras. Para conseguir las relaciones de las cámaras, se puede utilizar una referencia de posicionamiento como un emisor lexiano-stripe o infrarrojo. En combinación con gestos directos de medición de movimiento (6D-Vision) se pueden detectar directamente.

- Controladores basados en Gesture. Estos controladores actúan como una extensión del cuerpo para que cuando se realizan gestos, algunos de su movimiento pueden ser convenientemente capturados por el software. Un ejemplo de captura de movimiento basada en gestos emergentes es el seguimiento de mano esqueleto, que se está desarrollando para la realidad virtual y aplicaciones de realidad aumentada. Un ejemplo de esta tecnología es mostrado por empresas de seguimiento uSens y Gestigon, que permiten a los usuarios interactuar con sus entornos sin controladores.

- Conexión Wi-Fi

- Ratón de seguimiento de gestos, donde el movimiento del ratón está correlacionado con un símbolo siendo dibujado por la mano de una persona que puede estudiar cambios en la aceleración con el tiempo para representar gestos. El software también compensa el temblor humano y el movimiento inadvertido. Los sensores de estos cubos inteligentes que emiten luz se pueden utilizar para percibir manos y dedos, así como otros objetos cercanos, y se pueden utilizar para procesar datos. La mayoría de las aplicaciones están en la síntesis de música y sonido, pero se pueden aplicar a otros campos.

- Cámara individual. Una cámara 2D estándar se puede utilizar para el reconocimiento de gestos donde los recursos/ambiente no serían convenientes para otras formas de reconocimiento basado en imágenes. Antes se pensaba que una sola cámara no podría ser tan eficaz como cámaras estéreo o de conciencia profunda, pero algunas compañías están desafiando esta teoría. Tecnología de reconocimiento de gestos basada en software utilizando una cámara 2D estándar que puede detectar gestos de mano robustos.

Algoritmos

Dependiendo del tipo de datos de entrada, el enfoque para interpretar un gesto se puede realizar de diferentes maneras. Sin embargo, la mayoría de las técnicas se basan en punteros clave representados en un sistema de coordenadas 3D. Basado en el movimiento relativo de estos, el gesto puede detectarse con alta precisión, dependiendo de la calidad de la entrada y del enfoque del algoritmo.

Para interpretar los movimientos del cuerpo, hay que clasificarlos según las propiedades comunes y el mensaje que los movimientos pueden expresar. Por ejemplo, en la lengua de signos, cada gesto representa una palabra o frase.

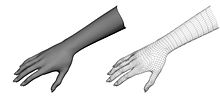

Alguna literatura diferencia dos enfoques diferentes en el reconocimiento de gestos: uno basado en modelos 3D y otro basado en apariencia. El método principal utiliza información 3D sobre elementos clave de las partes del cuerpo para obtener varios parámetros importantes, como la posición de la palma o los ángulos de las articulaciones. Los enfoques derivados de él, como los modelos volumétricos, han demostrado ser muy intensivos en términos de potencia computacional y requieren mayores desarrollos tecnológicos para poder implementarlos en el análisis en tiempo real. Alternativamente, los sistemas basados en la apariencia utilizan imágenes o vídeos para la interpretación directa. Estos modelos son más fáciles de procesar, pero normalmente carecen de la generalidad necesaria para la interacción persona-computadora.

Algoritmos basados en modelos 3D

El enfoque del modelo 3D puede utilizar modelos volumétricos o esqueléticos o incluso una combinación de ambos. Los enfoques volumétricos se han utilizado mucho en la industria de la animación por computadora y con fines de visión por computadora. Los modelos generalmente se crean a partir de superficies 3D complicadas, como NURBS o mallas poligonales.

El inconveniente de este método es que requiere mucha computación y aún están por desarrollarse sistemas para el análisis en tiempo real. Por el momento, un enfoque más interesante sería asignar objetos primitivos simples a las partes más importantes del cuerpo de la persona (por ejemplo, cilindros para los brazos y el cuello, esferas para la cabeza) y analizar la forma en que interactúan entre sí. . Además, algunas estructuras abstractas como las supercuádricas y los cilindros generalizados pueden ser incluso más adecuadas para aproximar las partes del cuerpo.

Algoritmos basados en el esqueleto

En lugar de utilizar un procesamiento intensivo de los modelos 3D y tratar con muchos parámetros, se puede utilizar una versión simplificada de los parámetros de los ángulos de las articulaciones junto con las longitudes de los segmentos. Esto se conoce como representación esquelética del cuerpo, donde se calcula un esqueleto virtual de la persona y se asignan partes del cuerpo a ciertos segmentos. El análisis aquí se realiza utilizando la posición y orientación de estos segmentos y la relación entre cada uno de ellos (por ejemplo el ángulo entre las juntas y la posición u orientación relativa)

Ventajas de utilizar modelos esqueléticos:

- Los algoritmos son más rápidos porque solo se analizan los parámetros clave.

- Pattern matching against a template database is possible

- Usando puntos clave permite que el programa de detección se centre en las partes significativas del cuerpo

Modelos basados en la apariencia

Los modelos basados en la apariencia ya no utilizan una representación espacial del cuerpo, sino que derivan sus parámetros directamente de las imágenes o vídeos utilizando una base de datos de plantillas. Algunos se basan en plantillas 2D deformables de las partes del cuerpo humano, en particular las manos. Las plantillas deformables son conjuntos de puntos en el contorno de un objeto, utilizados como nodos de interpolación para la aproximación del contorno del objeto. Una de las funciones de interpolación más simples es la lineal, que realiza una forma promedio a partir de conjuntos de puntos, parámetros de variabilidad de puntos y deformación externa. Estos modelos basados en plantillas se utilizan principalmente para el seguimiento manual, pero también podrían utilizarse para la clasificación de gestos simples.

El segundo enfoque en la detección de gestos que utiliza modelos basados en la apariencia utiliza secuencias de imágenes como plantillas de gestos. Los parámetros de este método son las imágenes mismas o ciertas características derivadas de ellas. La mayoría de las veces, sólo se utilizan una vista (monoscópica) o dos (estereoscópicas).

Modelos basados en electromiografía

La electromiografía (EMG) se refiere al estudio de las señales eléctricas producidas por los músculos del cuerpo. Mediante la clasificación de los datos recibidos de los músculos del brazo, es posible clasificar la acción y así introducir el gesto en un software externo. Los dispositivos EMG de consumo permiten enfoques no invasivos, como una banda para el brazo o la pierna, y se conectan a través de Bluetooth. Debido a esto, la EMG tiene una ventaja sobre los métodos visuales, ya que el usuario no necesita estar frente a una cámara para dar información, lo que permite una mayor libertad de movimiento.

Desafíos

Existen muchos desafíos asociados con la precisión y utilidad del reconocimiento de gestos y el software diseñado para implementarlo. Para el reconocimiento de gestos basado en imágenes, existen limitaciones en cuanto al equipo utilizado y al ruido de la imagen. Es posible que las imágenes o los videos no estén bajo una iluminación constante o en el mismo lugar. Los elementos en segundo plano o las características distintivas de los usuarios pueden dificultar el reconocimiento.

La variedad de implementaciones para el reconocimiento de gestos basado en imágenes también puede causar problemas con la viabilidad de la tecnología para uso general. Por ejemplo, es posible que un algoritmo calibrado para una cámara no funcione para otra cámara. La cantidad de ruido de fondo también provoca dificultades de seguimiento y reconocimiento, especialmente cuando se producen oclusiones (parciales y totales). Además, la distancia a la cámara y la resolución y calidad de la cámara también provocan variaciones en la precisión del reconocimiento.

Para capturar los gestos humanos mediante sensores visuales también se requieren métodos robustos de visión por computadora, por ejemplo para el seguimiento de las manos y el reconocimiento de la postura de las manos o para capturar los movimientos de la cabeza, las expresiones faciales o la dirección de la mirada.

Aceptabilidad social

Un desafío importante para la adopción de interfaces de gestos en dispositivos móviles de consumo, como teléfonos inteligentes y relojes inteligentes, surge de las implicaciones de aceptabilidad social de los gestos. Si bien los gestos pueden facilitar la entrada rápida y precisa en muchas computadoras con factores de forma novedosos, su adopción y utilidad a menudo están limitadas por factores sociales más que técnicos. Con este fin, los diseñadores de métodos de entrada de gestos pueden buscar equilibrar tanto las consideraciones técnicas como la voluntad del usuario de realizar gestos en diferentes contextos sociales. Además, diferentes dispositivos de hardware y mecanismos de detección admiten diferentes tipos de gestos reconocibles.

Dispositivo móvil

Las interfaces de gestos en dispositivos móviles y de factor de forma pequeño suelen estar respaldadas por la presencia de sensores de movimiento, como unidades de medida inercial (IMU). En estos dispositivos, la detección de gestos depende de que los usuarios realicen gestos basados en el movimiento capaces de ser reconocidos por estos sensores de movimiento. Potencialmente, esto puede dificultar la captura de señales de gestos sutiles o de movimiento lento, ya que puede resultar difícil distinguirlos de los movimientos naturales o del ruido. A través de una encuesta y un estudio sobre la usabilidad de los gestos, los investigadores descubrieron que los gestos que incorporan movimientos sutiles, que parecen similares a la tecnología existente, se ven o se sienten similares a cada acción y son agradables, tenían más probabilidades de ser aceptados por los usuarios, mientras que los gestos que parecen extraños. , son incómodos de realizar, interfieren con la comunicación o implican movimientos poco comunes, lo que hace que los usuarios sean más propensos a rechazar su uso. La aceptabilidad social de los gestos de los dispositivos móviles depende en gran medida de la naturalidad del gesto y del contexto social.

Ordenadores corporales y portátiles

Las computadoras portátiles generalmente se diferencian de los dispositivos móviles tradicionales en que su ubicación de uso e interacción tiene lugar en el cuerpo del usuario. En estos contextos, las interfaces gestuales pueden resultar preferidas a los métodos de entrada tradicionales, ya que su pequeño tamaño hace que las pantallas táctiles o los teclados sean menos atractivos. Sin embargo, comparten muchos de los mismos obstáculos de aceptabilidad social que los dispositivos móviles cuando se trata de interacción gestual. Sin embargo, la posibilidad de que las computadoras portátiles queden ocultas a la vista o integradas en otros objetos cotidianos, como la ropa, permite que los gestos imiten interacciones comunes con la ropa, como ajustar el cuello de una camisa o frotarse el bolsillo delantero del pantalón. Una consideración importante para la interacción con computadoras portátiles es la ubicación para la colocación e interacción del dispositivo. Un estudio que explora las actitudes de terceros hacia la interacción con dispositivos portátiles realizado en Estados Unidos y Corea del Sur encontró diferencias en la percepción del uso de computadoras portátiles entre hombres y mujeres, en parte debido a diferentes áreas del cuerpo consideradas socialmente sensibles. Otro estudio que investigó la aceptabilidad social de las interfaces proyectadas en el cuerpo encontró resultados similares, y ambos estudios etiquetaron las áreas alrededor de la cintura, la ingle y la parte superior del cuerpo (para las mujeres) como las menos aceptables, mientras que las áreas alrededor del antebrazo y la muñeca son las más aceptables.

Instalaciones públicas

Las instalaciones públicas, como las pantallas públicas interactivas, permiten el acceso a información y muestran medios interactivos en entornos públicos como museos, galerías y teatros. Si bien las pantallas táctiles son una forma frecuente de entrada para pantallas públicas, las interfaces de gestos brindan beneficios adicionales, como una mejor higiene, interacción a distancia y una mejor visibilidad, y pueden favorecer la interacción performativa. Una consideración importante para la interacción gestual con exhibiciones públicas es la alta probabilidad o expectativa de una audiencia de espectadores.

Fatiga

La fatiga del brazo fue un efecto secundario del uso de una pantalla táctil orientada verticalmente o de un lápiz óptico. En periodos de uso prolongado, los usuarios' Los brazos comenzaron a sentirse fatigados y/o incómodos. Este efecto contribuyó al declive de la entrada de datos en la pantalla táctil a pesar de su popularidad inicial en la década de 1980.

Para medir el efecto secundario de la fatiga del brazo, los investigadores desarrollaron una técnica llamada Resistencia Consumida.