Principio de incertidumbre

En la mecánica cuántica, el principio de incertidumbre (también conocido como principio de incertidumbre de Heisenberg) es cualquiera de una variedad de desigualdades matemáticas que establecen un límite fundamental para la Precisión con la que se pueden predecir los valores de ciertos pares de cantidades físicas de una partícula, como la posición, x y el momento, p, a partir de las condiciones iniciales.

Estos pares de variables se conocen como variables complementarias o variables canónicamente conjugadas; y, dependiendo de la interpretación, el principio de incertidumbre limita hasta qué punto tales propiedades conjugadas mantienen su significado aproximado, ya que el marco matemático de la física cuántica no admite la noción de propiedades conjugadas simultáneamente bien definidas expresadas por un solo valor. El principio de incertidumbre implica que, en general, no es posible predecir el valor de una cantidad con certeza arbitraria, incluso si se especifican todas las condiciones iniciales.

Introducido primero en 1927 por el físico alemán Werner Heisenberg, el principio de incertidumbre establece que cuanto más precisamente se determina la posición de una partícula, menos precisamente su impulso se puede predecir de las condiciones iniciales y viceversa. En el documento publicado en 1927, Heisenberg concluyó originalmente que el principio de incertidumbre era Δ Δ {displaystyle Delta }pΔ Δ {displaystyle Delta }q ~ h usando la constante de Planck completo. La desigualdad formal relacionada con la desviación estándar de posición σx y la desviación estándar del impulso σp fue derivado por Earle Hesse Kennard más tarde ese año y por Hermann Weyl en 1928:

σ σ xσ σ p≥ ≥ ▪ ▪ 2{displaystyle sigma _{x}sigma ¿Qué? {hbar} } {2}~~}

donde ħ es la constante de Planck reducida, h /(2π).

Históricamente, el principio de incertidumbre se ha confundido con un efecto relacionado en la física, llamado efecto del observador, que señala que las mediciones de ciertos sistemas no se pueden realizar sin afectar el sistema, es decir, sin cambiar algo en un sistema. Heisenberg utilizó tal efecto de observador a nivel cuántico (ver más abajo) como una "explicación" física; de la incertidumbre cuántica. Sin embargo, desde entonces ha quedado más claro que el principio de incertidumbre es inherente a las propiedades de todos los sistemas ondulatorios y que surge en la mecánica cuántica simplemente debido a la naturaleza ondulatoria de la materia de todos los objetos cuánticos. Por lo tanto, el principio de incertidumbre en realidad establece una propiedad fundamental de los sistemas cuánticos y no es una declaración sobre el éxito observacional de la tecnología actual. De hecho, el principio de incertidumbre tiene sus raíces en cómo aplicamos el cálculo para escribir las ecuaciones básicas de la mecánica. Debe enfatizarse que medida no significa solo un proceso en el que participa un físico-observador, sino cualquier interacción entre objetos clásicos y cuánticos independientemente de cualquier observador.

Dado que el principio de incertidumbre es un resultado tan básico en la mecánica cuántica, los experimentos típicos de la mecánica cuántica observan aspectos del mismo de manera rutinaria. Ciertos experimentos, sin embargo, pueden probar deliberadamente una forma particular del principio de incertidumbre como parte de su principal programa de investigación. Estos incluyen, por ejemplo, pruebas de relaciones de incertidumbre número-fase en sistemas superconductores o de óptica cuántica. Las aplicaciones que dependen del principio de incertidumbre para su funcionamiento incluyen tecnología de ruido extremadamente bajo, como la que se requiere en los interferómetros de ondas gravitacionales.

Introducción

Es fundamental ilustrar cómo se aplica el principio a situaciones físicas relativamente inteligibles, ya que es imperceptible en las escalas macroscópicas que experimentan los humanos. Dos marcos alternativos para la física cuántica ofrecen diferentes explicaciones para el principio de incertidumbre. La imagen de la mecánica ondulatoria del principio de incertidumbre es visualmente más intuitiva, pero la imagen más abstracta de la mecánica matricial lo formula de una manera que se generaliza más fácilmente.

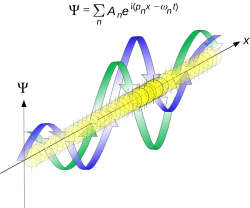

Matemáticamente, en la mecánica ondulatoria, la relación de incertidumbre entre la posición y el momento surge porque las expresiones de la función de onda en las dos bases ortonormales correspondientes en el espacio de Hilbert son transformadas de Fourier entre sí (es decir, la posición y el momento son variables conjugadas). Una función distinta de cero y su transformada de Fourier no pueden localizarse claramente al mismo tiempo. Una compensación similar entre las varianzas de los conjugados de Fourier surge en todos los sistemas subyacentes al análisis de Fourier, por ejemplo, en las ondas de sonido: un tono puro es un pico agudo en una sola frecuencia, mientras que su transformada de Fourier da la forma de la onda de sonido en el tiempo. dominio, que es una onda sinusoidal completamente deslocalizada. En mecánica cuántica, los dos puntos clave son que la posición de la partícula toma la forma de una onda de materia, y el momento es su conjugado de Fourier, asegurado por la relación de De Broglie p = ħk, donde k es el número de onda.

En la mecánica matricial, la formulación matemática de la mecánica cuántica, cualquier par de operadores autoadjuntos que no conmutan y representan observables están sujetos a límites de incertidumbre similares. Un estado propio de un observable representa el estado de la función de onda para un determinado valor de medición (el valor propio). Por ejemplo, si se realiza una medición de un A observable, entonces el sistema se encuentra en un estado propio particular Ψ de ese observable. Sin embargo, el estado propio particular del observable A no necesita ser un estado propio de otro observable B: si es así, entonces no tiene una única medida asociada, ya que el sistema no está en un estado propio de ese observable.

Interpretación de la mecánica ondulatoria

(Referencia)

Según la hipótesis de Broglie, cada objeto en el universo es una ola, es decir, una situación que da lugar a este fenómeno. La posición de la partícula se describe por una función de onda Ψ Ψ ()x,t){displaystyle Psi (x,t)}. La función de onda independiente del tiempo de una onda plana única de número de onda k0 o impulso p0 es

La regla de Born establece que esto debe interpretarse como una función de amplitud de densidad de probabilidad en el sentido de que la probabilidad de encontrar la partícula entre a y b es

En el caso de la onda de avión monomoded, Silencio↑ ↑ ()x)Silencio2{displaystyle Silenciopsi (x) es una distribución uniforme. En otras palabras, la posición de partículas es extremadamente incierta en el sentido de que podría ser esencialmente en cualquier lugar a lo largo del paquete de ondas.

Por otro lado, considere una función de onda que es una suma de muchas ondas, que podemos escribir como

Una manera de cuantificar la precisión de la posición y el impulso es la desviación estándarσ. Desde Silencio↑ ↑ ()x)Silencio2{displaystyle Silenciopsi (x) es una función de densidad de probabilidad para la posición, calculamos su desviación estándar.

La precisión de la posición se mejora, es decir, se reduce σx, mediante el uso de muchas ondas planas, lo que debilita la precisión del impulso, es decir, se aumenta σp. Otra forma de decir esto es que σx y σp tienen una relación inversa o al menos están acotados desde abajo. Este es el principio de incertidumbre, cuyo límite exacto es el límite de Kennard. Haga clic en el botón mostrar a continuación para ver una derivación semiformal de la desigualdad de Kennard utilizando la mecánica ondulatoria.

We are interested in the variances of position and momentum, defined as

Without loss of generality, we will assume that the means vanish, which just amounts to a shift of the origin of our coordinates. (A more general proof that does not make this assumption is given below.) This gives us the simpler form

The function f ( x ) = x ⋅ ψ ( x ) {displaystyle f(x)=xcdot psi (x)} can be interpreted as a vector in a function space. We can define an inner product for a pair of functions u(x) and v(x) in this vector space:

With this inner product defined, we note that the variance for position can be written as

We can repeat this for momentum by interpreting the function g ~ ( p ) = p ⋅ φ ( p ) {displaystyle {tilde {g}}(p)=pcdot varphi (p)} as a vector, but we can also take advantage of the fact that ψ ( x ) {displaystyle psi (x)} and φ ( p ) {displaystyle varphi (p)} are Fourier transforms of each other. We evaluate the inverse Fourier transform through integration by parts:

The Cauchy–Schwarz inequality asserts that

The modulus squared of any complex number z can be expressed as

All that remains is to evaluate these inner products.

Plugging this into the above inequalities, we get

Note that the only physics involved in this proof was that ψ ( x ) {displaystyle psi (x)} and φ ( p ) {displaystyle varphi (p)} are wave functions for position and momentum, which are Fourier transforms of each other. A similar result would hold for any pair of conjugate variables.

Interpretación de la mecánica de matrices

(Referencia)

En los mecánicos de matriz, observables como la posición y el impulso están representados por operadores autónomos. Al considerar pares de observables, una cantidad importante es la conmutador. Para un par de operadores # y B^ ^ {displaystyle {hat {B}}}, uno define su conmutador como

El significado físico de la no-commutatividad se puede entender considerando el efecto del conmutador en la posición y el impulso eigenstats. Vamos Silencio↑ ↑ .. {displaystyle TENED rangle } ser un eigenstat derecho de posición con un eigenvalue constante x0. Por definición, esto significa que x^ ^ Silencio↑ ↑ .. =x0Silencio↑ ↑ .. .{displaystyle {hat {x}Sobrevivirpsi rangle - ¿Qué? Aplicar el conmutador a Silencio↑ ↑ .. {displaystyle TENED rangle } rendimientos

Supongamos, por el bien de la prueba por contradicción, que Silencio↑ ↑ .. {displaystyle TENED rangle } es también un correcto eigenstat de impulso, con constante eigenvalue p0. Si esto fuera cierto, entonces uno podría escribir

Cuando se mide un estado, se proyecta en un estado propio en base al observable relevante. Por ejemplo, si se mide la posición de una partícula, entonces el estado equivale a un estado propio de posición. Sin embargo, esto significa que el estado no es un estado propio de cantidad de movimiento, sino que puede representarse como una suma de múltiples estados propios de base de cantidad de movimiento. En otras palabras, el impulso debe ser menos preciso. Esta precisión puede ser cuantificada por las desviaciones estándar,

Al igual que en la interpretación anterior de la mecánica ondulatoria, se ve una compensación entre las respectivas precisiones de los dos, cuantificada por el principio de incertidumbre.

Límite de Heisenberg

En metrología cuántica, y especialmente en interferometría, el límite de Heisenberg es la tasa óptima a la que la precisión de una medición puede escalar con la energía utilizada en la medición. Normalmente, esta es la medida de una fase (aplicada a un brazo de un divisor de haz) y la energía viene dada por el número de fotones utilizados en un interferómetro. Aunque algunos afirman haber superado el límite de Heisenberg, esto refleja un desacuerdo sobre la definición del recurso de escala. Definido adecuadamente, el límite de Heisenberg es una consecuencia de los principios básicos de la mecánica cuántica y no se puede superar, aunque se puede superar el límite débil de Heisenberg.

Relaciones de incertidumbre de Robertson-Schrödinger

La forma general más común del principio de incertidumbre es la relación de incertidumbre de Robertson.

Para un operador Hermitian arbitrario O^ ^ {displaystyle {hat {fnMithcal}}} {fnK}}} {fnK}} {f}}} {fn}}}}}}} podemos asociar una desviación estándar

En esta notación, la relación de incertidumbre de Robertson viene dada por

La relación de incertidumbre de Robertson se deriva inmediatamente de una desigualdad un poco más fuerte, la relación de incertidumbre de Schrödinger,

σ σ A2σ σ B2≥ ≥ Silencio12.. {}A^ ^ ,B^ ^ }.. − − .. A^ ^ .. .. B^ ^ .. Silencio2+Silencio12i.. [A^ ^ ,B^ ^ ].. Silencio2,{displaystyle sigma - ¿Qué? ################################################################################################################################################################################################################################################################ - ¿Por qué? {1}{2i}langle [{hat {A},{hat {B}]rangle right WordPress{2}

donde hemos introducido el anticonmutador,

La derivación que se muestra aquí incorpora y construye de los que se muestran en Robertson, Schrödinger y libros de texto estándar como Griffiths. Para cualquier operador Hermitian A^ ^ {displaystyle {hat {}}}, basado en la definición de varianza, tenemos

Del mismo modo, para cualquier otro operador Hermitiano B^ ^ {displaystyle {hat {B}}} en el mismo estado

El producto de las dos desviaciones se puede expresar así como

- σ σ A2σ σ B2=.. f▪ ▪ f.. .. g▪ ▪ g.. .{displaystyle sigma - ¿Qué? {B}=langle frangle langle gmid grangle.}

()1)

Para relacionar los dos vectores Silenciof.. {displaystyle Silencioso y Silenciog.. {displaystyle TENGArangle }, utilizamos la desigualdad Cauchy-Schwarz que se define como

- σ σ A2σ σ B2≥ ≥ Silencio.. f▪ ▪ g.. Silencio2.{displaystyle sigma - ¿Qué? _{B}{2}geq tenciónlangle fmid grangle

()2)

Desde .. f▪ ▪ g.. {displaystyle langle fmid grangle } es en general un número complejo, utilizamos el hecho de que el módulo cuadrado de cualquier número complejo z{displaystyle z} se define como SilenciozSilencio2=zzAlternativa Alternativa {fnMicrosoft Sans Serif}, donde zAlternativa Alternativa {displaystyle z^{*} es el complejo conjugado de z{displaystyle z}. El módulo cuadrado también se puede expresar como

- SilenciozSilencio2=()Re ()z))2+()Im ()z))2=()z+zAlternativa Alternativa 2)2+()z− − zAlternativa Alternativa 2i)2.{displaystyle - ¿Qué? Grande. Grande. ¿Qué? Grande. } {2i} {Big)}} {2}}

()3)

Dejamos z=.. f▪ ▪ g.. {displaystyle z=langle fmid grangle } y zAlternativa Alternativa =.. g▪ ▪ f.. {displaystyle z^{*}=langle gmid frangle } y sustituir estos en la ecuación anterior para conseguir

- Silencio.. f▪ ▪ g.. Silencio2=().. f▪ ▪ g.. +.. g▪ ▪ f.. 2)2+().. f▪ ▪ g.. − − .. g▪ ▪ f.. 2i)2{bigg}{2}{2}{bigg}}{2}}{2}}{2}bigg}{bigg}{bigg} {m} {m}m} {m} {m}m} {m} {m} {m} {m}m}}m}m} {m}m}}m}m}m} {m}}}m}}}}m}m}m}m}m}}m}m}}} {m} {m} {m}}m}m}}m}}}}}m}}}}m}m}m}m}m}m}}m}m}m}}m}m}m}m}}m}}m}m}m}m}m}m}m}m}}}}}}m}}

()4)

El producto interior .. f▪ ▪ g.. {displaystyle langle fmid grangle } está escrito explícitamente como

Del mismo modo se puede demostrar que .. g▪ ▪ f.. =.. B^ ^ A^ ^ .. − − .. A^ ^ .. .. B^ ^ .. .{displaystyle langle gmid frangle =langle {hat {B}{hat {A}rangle -langle {hat {}rangle {langle {hat {B}rangle}rangle.}

Así, tenemos

Ahora sustituimos las dos ecuaciones anteriores arriba en Eq. (4) y conseguir

Sustituir lo anterior a la ecuación (Ecuación)2) tenemos la relación de incertidumbre Schrödinger

Esta prueba tiene un problema relacionado con los dominios de los operadores involucrados. Para que la prueba tenga sentido, el vector B^ ^ SilencioΨ Ψ .. {displaystyle {hat {fn}SobrevivirPsirangle} tiene que estar en el dominio del operador sin límites A^ ^ {displaystyle {hat {}}}, que no es siempre el caso. De hecho, la relación de incertidumbre de Robertson es falsa si A^ ^ {displaystyle {hat {}}} es una variable de ángulo y B^ ^ {displaystyle {hat {B}}} es el derivado con respecto a esta variable. En este ejemplo, el conmutador es una constante no cero —como en la relación de incertidumbre de Heisenberg— y sin embargo hay estados donde el producto de las incertidumbres es cero. (Véase la sección del contraejemplo a continuación.) Este problema se puede superar utilizando un método de variación para la prueba, o trabajando con una versión exponente de las relaciones de conmutación canónica.

Tenga en cuenta que en la forma general de la relación de incertidumbre Robertson-Schrödinger, no hay necesidad de asumir que los operadores A^ ^ {displaystyle {hat {}}} y B^ ^ {displaystyle {hat {B}}} son operadores autónomos. Basta asumir que son meramente operadores simétricos. (La distinción entre estas dos nociones es generalmente enlucida en la literatura física, donde el término Hermitian se utiliza para o ambas clases de operadores. Véase el capítulo 9 del libro de Hall para una discusión detallada de esta importante pero técnica distinción.)

Estados mixtos

La relación de incertidumbre de Robertson-Schrödinger puede generalizarse de forma directa para describir estados mixtos.

Las relaciones de incertidumbre Maccone-Pati

La relación de incertidumbre Robertson-Schrödinger puede ser trivial si el estado del sistema es elegido para ser eigenstat de uno de los observables. Las relaciones de incertidumbre más fuertes probadas por Maccone y Pati dan límites no-triviales a la suma de las diferencias para dos observables incompatibles. (Los trabajos adicionales sobre relaciones de incertidumbre formuladas como la suma de diferencias incluyen, por ejemplo, Ref. debido a Huang.) Para dos observables no transmutadores A{displaystyle A} y B{displaystyle B} la primera relación de incertidumbre más fuerte es dada por

La segunda relación de incertidumbre más fuerte viene dada por

Mejora de la relación de incertidumbre de Robertson-Schrödinger basada en descomposiciones de la matriz de densidad

La incertidumbre Robertson-Schrödinger se puede mejorar notando que debe mantener para todos los componentes *** *** k{displaystyle varrho _{k} en cualquier descomposición de la matriz de densidad dada como

Con argumentos similares, se puede derivar una relación con un techo convexo en el lado derecho

Sigue una desigualdad más simple sin un techo convexo

Espacio de fase

En la formulación del espacio de fase de la mecánica cuántica, la relación Robertson-Schrödinger sigue de una condición de positividad a una función real de la estrella-cuadra. Dada una función Wigner W()x,p){displaystyle W(x,p)} con producto estrella ★ y una función f, lo siguiente es generalmente cierto:

Elegir f=a+bx+cp{displaystyle f=a+bx+cp}, llegamos a

Dado que esta condición de positividad es cierta para todos a, b y c, se deduce que todos los valores propios de la matriz no son negativos.

Los valores propios no negativos implican una condición de no negatividad correspondiente en el determinante,

Ejemplos

Dado que las relaciones de Robertson y Schrödinger son para operadores generales, las relaciones se pueden aplicar a dos observables cualquiera para obtener relaciones de incertidumbre específicas. Algunas de las relaciones más comunes que se encuentran en la literatura se dan a continuación.

- Para la posición y el impulso lineal, la relación de conmutación canónica [x^ ^ ,p^ ^ ]=i▪ ▪ {displaystyle [{hat {x}},{hat {}]=ihbar } implica la desigualdad Kennard de arriba: σ σ xσ σ p≥ ≥ ▪ ▪ 2.{displaystyle sigma _{x}sigma ¿Qué? {hbar} } {2}}.

- Para dos componentes ortogonales del motor angular total de un objeto: Donde i, j, k son distintos, y Ji denota el impulso angular a lo largo del xi Axis. Esta relación implica que a menos que los tres componentes se desvanezcan juntos, sólo un componente único del impulso angular de un sistema se puede definir con precisión arbitraria, normalmente el componente paralelo a un campo externo (magnético o eléctrico). Además, para [Jx,JSí.]=i▪ ▪ ε ε xSí.zJz{displaystyle [J_{x},J_{y}=ihbar varepsilon ¿Qué?, una opción A^ ^ =Jx{displaystyle {hat {}=J_{x}, B^ ^ =JSí.{displaystyle {hat {B}=J_{y}, en multiples de impulso angular, ↑ = Silencioj, m################################################################################################################################################################################################################################################################ .. Jx2+JSí.2+Jz2.. {displaystyle langle ¿Qué?) de abajo y así produce limitaciones útiles como j()j + 1) ≥ m()m + 1), y por lo tanto j ≥ m, entre otros.σ σ Jiσ σ Jj≥ ≥ ▪ ▪ 2Silencio.. Jk.. Silencio,{displaystyle sigma - ¿Por qué? {fnMicrosoft Sans Serif} ################################################################################################################################################################################################################################################################

- En la mecánica no relativista, el tiempo es privilegiado como una variable independiente. Sin embargo, en 1945, L. I. Mandelshtam y I. E. Tamm derivaron un no relativista tiempo-energía incertidumbre relación, como sigue. Para un sistema cuántico en un estado no estacionario ↑ y un observable B representado por un operador autónomo B^ ^ {displaystyle {hat {B}}}, la siguiente fórmula sostiene: Donde σE es la desviación estándar del operador de energía (Hamiltonian) en el estado ↑, σB representa la desviación estándar de B. Aunque el segundo factor en el lado izquierdo tiene dimensión de tiempo, es diferente del parámetro de tiempo que entra en la ecuación Schrödinger. Es una por vida del estado ↑ con respecto al observable B: En otras palabras, esta es la intervalo de tiempo (Δ)t) después del cual el valor de expectativa .. B^ ^ .. {displaystyle langle {hat {B}rangle } cambios apreciablemente. Un significado informal y heurístico del principio es el siguiente: Un estado que sólo existe por un corto tiempo no puede tener una energía definida. Para tener una energía definida, la frecuencia del estado debe definirse con precisión, y esto requiere que el estado se cuelgue por muchos ciclos, el recíproco de la precisión necesaria. Por ejemplo, en la espectroscopia, estados excitados tienen una vida finita. Para el tiempo – principio de incertidumbre energética, no tienen una energía definida, y, cada vez que decaen, la energía que liberan es ligeramente diferente. La energía promedio del fotón saliente tiene un pico en la energía teórica del estado, pero la distribución tiene un ancho finito llamado el ancho de línea natural. Los estados rápidos tienen un ancho de línea amplio, mientras que los estados lentos tienen un ancho de línea estrecho. El mismo efecto de ancho de línea también hace difícil especificar la masa restante de partículas inestables y rápidas en la física de partículas. Cuanto más rápido se desintegra la partícula (más corta su vida), menos seguro es su masa (más grande es el ancho de la partícula).σ σ Eσ σ BSilenciod.. B^ ^ .. dtSilencio≥ ≥ ▪ ▪ 2,{displaystyle sigma ¿Por qué? {sigma ¿Qué? {dlangle {hat} {B}rangle } {dt} {}} {fnK}}}g}g}gn}}}}} {f}} {fn}}}}} {fn}}}}}}}g}}}}}}}}}}}}}}}}}}}} {f}}}}}}}} {fnMic {hbar}{2}}}

- Para el número de electrones en un superconductor y la fase de su parámetro de orden Ginzburg-Landau Δ Δ NΔ Δ φ φ ≥ ≥ 1.{displaystyle Delta N,Delta varphi geq 1.}

Un contraejemplo

Supongamos que consideramos una partícula cuántica en un anillo, donde la función de onda depende de una variable angular Silencio Silencio {displaystyle theta }, que podemos tomar para mentir en el intervalo [0,2π π ]{displaystyle [0,2pi]}. Definir operadores de "posición" y "momentum" A^ ^ {displaystyle {hat {}}} y B^ ^ {displaystyle {hat {B}}} por

Ahora ↑ ↑ {displaystyle psi } ser cualquiera de los eigentales de B^ ^ {displaystyle {hat {B}}}, que se dan por ↑ ↑ ()Silencio Silencio )=e2π π inSilencio Silencio {displaystyle psi (theta)=e^{2pi entheta }. Estos estados son normalizables, a diferencia de los eigenstates del operador de impulso en la línea. También el operador A^ ^ {displaystyle {hat {}}} está obligado, ya que Silencio Silencio {displaystyle theta } abarca un intervalo atado. Así, en el estado ↑ ↑ {displaystyle psi }, la incertidumbre de B{displaystyle B} es cero y la incertidumbre de A{displaystyle A} es finito, así que

Para los operadores de posición e impulso habituales X^ ^ {displaystyle {hat {X}}} y P^ ^ {displaystyle {hat {}}}} en la línea real, no pueden ocurrir tales contraexamples. Mientras tanto σ σ x{displaystyle sigma _{x} y σ σ p{displaystyle sigma _{p} se definen en el estado ↑ ↑ {displaystyle psi }, el principio de incertidumbre Heisenberg sostiene, incluso si ↑ ↑ {displaystyle psi } no está en el dominio de X^ ^ P^ ^ {displaystyle {hat {x}{hat {}}} {f}} {f}} {f}}} {f}}} {f}}}} {f}}}}} {f}}}}} {f}}}}}} {f}}}}}} {f}}}}}}}}}}}}}}}}}}}}}}}} { o de P^ ^ X^ ^ {displaystyle {hat {}{hat {X}}} {f}} {f}} {f}}} {f}}} {f}}}} {f}}}}}} {f}}}}}}}}} {f}}} {f}}}}}} {f}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}} {.

Ejemplos

(Referencias)

Estados estacionarios del oscilador armónico cuántico

Considere un oscilador armónico cuántico unidimensional. Es posible expresar los operadores de posición y momento en términos de los operadores de creación y aniquilación:

Usando las reglas estándar para los operadores de creación y aniquilación en los estados propios de energía,

En particular, el límite de Kennard anterior está saturado para el estado fundamental n=0, para el cual la densidad de probabilidad es simplemente la distribución normal.

Osciladores armónicos cuánticos con condición inicial gaussiana

En un oscilador armónico cuántico de frecuencia angular característica ω, coloque un estado que esté compensado desde la parte inferior del potencial por algún desplazamiento x0 como

De las relaciones

Estados coherentes

Un estado coherente es un estado propio derecho del operador de aniquilación,

En la imagen donde el estado coherente es una partícula masiva en un oscilador armónico cuántico, los operadores de posición y momento pueden expresarse en términos de los operadores de aniquilación en las mismas fórmulas anteriores y usarse para calcular las varianzas,

Partícula en una caja

Considere una partícula en una caja de longitud unidimensional L{displaystyle L.. Las funciones eigen en la posición y el espacio de impulso son

Por lo tanto, el producto de las desviaciones estándar es

Impulso constante

Suponga que una partícula inicialmente tiene una función de onda espacial de momento descrita por una distribución normal alrededor de un momento constante p0 de acuerdo con

Desde .. p()t).. =p0{displaystyle langle p(t)rangle =p_{0} y σ σ p()t)=▪ ▪ /()2x0){displaystyle sigma _{p}(t)=hbar / {sqrt {2}x_{0}}, esto se puede interpretar como una partícula que se mueve junto con el impulso constante a la precisión arbitrariamente alta. Por otro lado, la desviación estándar de la posición es

Relaciones de incertidumbre adicional

Errores sistemáticos y estadísticos

Las desigualdades anteriores se centran en la Imprecisión estadística de los observables cuantificados por la desviación estándar σ σ {displaystyle sigma }. La versión original de Heisenberg, sin embargo, estaba tratando con la error sistemático, una perturbación del sistema cuántico producido por el aparato de medición, es decir, un efecto observador.

Si lo dejamos ε ε A{displaystyle varepsilon _{A} representar el error (es decir, inexactitud) de una medición de un observable A y .. B{displaystyle eta ¿Qué? la perturbación producida en una medición posterior de la variable conjugada B por la anterior medición de A, entonces la desigualdad propuesta por Ozawa —que abarca tanto errores sistemáticos como estadísticos— sostiene:

ε ε A.. B+ε ε Aσ σ B+σ σ A.. B≥ ≥ 12Silencio.[A^ ^ ,B^ ^ ].Silencio{displaystyle varepsilon ¿Por qué? _{B}+varepsilon ¿Qué? _{B}+sigma ¿Por qué? ¿Por qué? Bigl langle }{bigl [} {hat {A} {hat {B}{bigr]}{Bigr rangle }right sometida}

El principio de incertidumbre de Heisenberg, como se describió originalmente en la formulación de 1927, menciona solo el primer término de la desigualdad de Ozawa, con respecto al error sistemático. Usando la notación anterior para describir el efecto error/perturbación de medidas secuenciales (primero A, luego B), podría escribirse como

ε ε A.. B≥ ≥ 12Silencio.[A^ ^ ,B^ ^ ].Silencio{displaystyle varepsilon ¿Por qué? ¿Por qué? Bigl langle }{bigl [} {hat {A} {hat {B}{bigr]}{Bigr rangle }right sometida}

La derivación formal de la relación Heisenberg es posible pero lejos de intuitiva. Era no propuesto por Heisenberg, pero formulado de manera matemáticamente coherente sólo en los últimos años. Además, cabe destacar que la formulación Heisenberg no tiene en cuenta los errores estadísticos intrínsecos σ σ A{displaystyle sigma _{A} y σ σ B{displaystyle sigma _{B}. Hay cada vez más pruebas experimentales de que la incertidumbre cuántica total no puede describirse sólo por el término Heisenberg, sino que requiere la presencia de los tres términos de la desigualdad Ozawa.

Usando el mismo formalismo, también es posible introducir el otro tipo de situación física, a menudo confundida con la anterior, a saber, el caso de medidas simultáneas (A y B al mismo tiempo):

ε ε Aε ε B≥ ≥ 12Silencio.[A^ ^ ,B^ ^ ].Silencio{displaystyle varepsilon _{A},varepsilon ¿Por qué? Bigl langle }{bigl [} {hat {A} {hat {B}{bigr]}{Bigr rangle }right sometida}

Las dos medidas simultáneas en A y B son necesariamente poco nítidas o débiles.

También es posible derivar una relación de incertidumbre que, como la de Ozawa, combina los componentes de error estadístico y sistemático, pero mantiene una forma muy cercana a la desigualdad original de Heisenberg. Al agregar Robertson

σ σ Aσ σ B≥ ≥ 12Silencio.[A^ ^ ,B^ ^ ].Silencio{displaystyle sigma _{A},sigma ¿Por qué? Bigl langle }{bigl [} {hat {A} {hat {B}{bigr]}{Bigr rangle }right sometida}

y las relaciones de Ozawa obtenemos

ε ε ̄ ̄ A.. ̄ ̄ B≥ ≥ Silencio.[A^ ^ ,B^ ^ ].Silencio{displaystyle {bar {varepsilon }_{A},{bar {eta }_{B},geq ,left sometida{Bigl langle }{bigl [}{hat {hat {A}},{hat {B}}{bigr}}{Bigr rangle }derechactamente}

Principio de incertidumbre entrópica cuántica

Para muchas distribuciones, la desviación estándar no es una forma particularmente natural de cuantificar la estructura. Por ejemplo, las relaciones de incertidumbre en las que uno de los observables es un ángulo tienen poco significado físico para fluctuaciones mayores de un período. Otros ejemplos incluyen distribuciones altamente bimodales o distribuciones unimodales con varianza divergente.

Una solución que supera estos problemas es una incertidumbre basada en la incertidumbre entrópica en lugar del producto de varianzas. Mientras formulaba la interpretación de muchos mundos de la mecánica cuántica en 1957, Hugh Everett III conjeturó una mayor extensión del principio de incertidumbre basado en la certeza entrópica. Esta conjetura, también estudiada por Hirschman y probada en 1975 por Beckner y por Iwo Bialynicki-Birula y Jerzy Mycielski es que, para dos pares de transformadas de Fourier normalizados y adimensionales f(a) y g(b) donde

- f()a)=∫ ∫ − − JUEGO JUEGO JUEGO JUEGO g()b)e2π π iabdb{displaystyle f(a)=int _{-infty }{infty }g(b) e^{2pi iab},db} y g()b)=∫ ∫ − − JUEGO JUEGO JUEGO JUEGO f()a)e− − 2π π iabda{displaystyle ,,,g(b)=int _{-infty }{infty }f(a) e^{-2pi iab},da}

las entropías de información de Shannon

Ha+Hb≥ ≥ log ()e/2){displaystyle H_{a}+H_{b}geq log(e/2)}

donde los logaritmos pueden estar en cualquier base.

Las funciones de distribución de probabilidad asociadas con la función de onda de posición ψ(x) y la función de onda de impulso φ(x) tienen dimensiones de longitud y momento inversos respectivamente, pero las entropías pueden volverse adimensionales por

Hx+Hp≥ ≥ log ()eh2x0p0){displaystyle ¿Qué?

donde h es la constante de Planck.

Dependiendo de la elección de uno de x0 p0 producto, la expresión se puede escribir de muchas maneras. Si x0 p0 se elige para ser h, luego

Si, en cambio, x0 p0 se elige para que sea ħ, luego

Si x0 y p0 se eligen para ser la unidad en cualquier sistema de unidades que se esté utilizando, entonces

El principio de incertidumbre entrópica cuántica es más restrictivo que el principio de incertidumbre de Heisenberg. De las desigualdades logarítmicas inversas de Sobolev

En otras palabras, el principio de incertidumbre de Heisenberg es una consecuencia del principio de incertidumbre entrópico cuántico, pero no al revés. Algunas observaciones sobre estas desigualdades. Primero, la elección de la base e es una cuestión de convención popular en física. El logaritmo puede estar alternativamente en cualquier base, siempre que sea consistente en ambos lados de la desigualdad. En segundo lugar, recuerde que se ha utilizado la entropía de Shannon, no la entropía cuántica de von Neumann. Finalmente, la distribución normal satura la desigualdad, y es la única distribución con esta propiedad, porque es la distribución de probabilidad de máxima entropía entre aquellas con varianza fija (cf. aquí para la prueba).

| Incierto entropico de la distribución normal |

|---|

| Demostramos este método en el estado de la QHO, que como se discutió anteriormente satura la incertidumbre habitual basada en desviaciones estándar. La escala de longitud se puede fijar a lo que sea conveniente, por lo que asignamos

x0=▪ ▪ 2m⋅ ⋅ {displaystyle ¿Qué? {hbar}{2momega } ↑ ↑ ()x)=()m⋅ ⋅ π π ▪ ▪ )1/4exp ()− − m⋅ ⋅ x22▪ ▪ )=()12π π x02)1/4exp ()− − x24x02){displaystyle {begin{aligned}psi (x) reducida=left({frac {momega }{pi hbar }}right)^{1/4}exp {left(-{frac {momegaega)}derecho)} ################################################################################################################################################################################################################################################################ {fnMicroc {x^{2}}{4x_{0}}}}}}end{aligned}}}}}}}}}}}}}}}} {fnunció} La distribución de probabilidad es la distribución normal Silencio↑ ↑ ()x)Silencio2=1x02π π exp ()− − x22x02){fnMicrosoft Sans Serif} {fnMicrosoft Sans Serif} {fnMicrosoft Sans Serif} {f} {fnMicrosoft Sans Serif} {fnK}}fnfnMicroc {x^{2}{2x_{0}}}derecha)} Hx=− − ∫ ∫ Silencio↑ ↑ ()x)Silencio2In ()Silencio↑ ↑ ()x)Silencio2⋅ ⋅ x0)dx=− − 1x02π π ∫ ∫ − − JUEGO JUEGO JUEGO JUEGO exp ()− − x22x02)In [12π π exp ()− − x22x02)]dx=12π π ∫ ∫ − − JUEGO JUEGO JUEGO JUEGO exp ()− − u22)[In ()2π π )+u22]du=In ()2π π )+12.{displaystyle {begin{aligned}H_{x} {=-int Silenciopsi (x) sometida^{2}ln(Principepsi (x) soporta^{2}cdot x_{0},dx\\\\ccq {1}{x_}{0}{sqt}{f}}}{f}{f}}}}}}}}{f}}}}}}}f}}}}{f}f}f}f}fnMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMinMi {2fnK} {fnK} {fnK}}fnK} {fnK}} {fnK} {f} {fn}}}fnfnK}} {fnK}} {f}} {f}}}f} {f}fnKf}} {f}}}f}f}}f}}}}}f}f}}f}f}}}f} {f} {f}}f}f}f}f}f}f}}}f}f}f}}f}f}f}f}}}}fnf}}fnf}fnfnfnfnfnf}f}fnfnfnfnfnf}fnfnfnfnf}}}}fn {fnMicrosoft Sans Serif} {fnMicrosoft Sans Serif} {fnMicrosoft Sans Serif} {fn}} {fn} {fnK}} {fnK} {fnK} {c} {ccH0} {ccH00} {cH00}}} {cc}}}cccccH00}ccccH00}cccccccH00} {ccH00}ccH00}ccH00}}}ccccccH00}ccH00}ccH00}}cH00}ccH00cccccH00}}cH00}ccH00}ccH00}ccH00}}}ccc Un cálculo completamente análogo procede para la distribución del impulso. Elegir un impulso estándar p0=▪ ▪ /x0{displaystyle P_{0}=hbar /x_{0}: φ φ ()p)=()2x02π π ▪ ▪ 2)1/4exp ()− − x02p2▪ ▪ 2){displaystyle varphi (p)=left({frac {2x_{0}{2}{pihbar ^{2}}right)^{1/4}exp {left(-{frac} {x_{0}} {2} {hbar }}}derecho)} Silencioφ φ ()p)Silencio2=2x02π π ▪ ▪ 2exp ()− − 2x02p2▪ ▪ 2){fnMicrosoft Sans Serif} {fnMicroc {2x_{0}{2}}{pihbar ^{2}}}}f}f}}f}}f} {left(-{frac {2x_{0} {2} {2}} {hbar }}}derecha)}} Hp=− − ∫ ∫ Silencioφ φ ()p)Silencio2In ()Silencioφ φ ()p)Silencio2⋅ ⋅ ▪ ▪ /x0)dp=− − 2x02π π ▪ ▪ 2∫ ∫ − − JUEGO JUEGO JUEGO JUEGO exp ()− − 2x02p2▪ ▪ 2)In [2π π exp ()− − 2x02p2▪ ▪ 2)]dp=2π π ∫ ∫ − − JUEGO JUEGO JUEGO JUEGO exp ()− − 2v2)[In ()π π 2)+2v2]dv=In ()π π 2)+12.{displaystyle {begin{aligned}H_{p} limit=-int Silenciovarphi (p) habit^{2}ln(Primerifvarphi (p) perpetua^{2}cdot hbar /x_{0}),dp\\\\cH00=-{sqrt {f} {2x_{0} {2} {f} {f}}}} {f}} {f}}} {f}}} {f}}}} {f}}}}} {f}}}}} {f}}}}}} {f}}} {f}}} {f}}}}}}}}}}}} { ¿Qué? {2x_{0} {2}} {hbar ^{2}}right)}ln left[{sqrt {frac {2}{pi}{i}} {i} {fn0}} {fn0}} {fn0}} {f}fnK}}f}}}}}}f}}p}f}}}p}f}p}f}f}f}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}p}pppp}p}p}p}p}p}p}p}p}p}p}p}p}p}p} {fnMicrosoft Sans Serif}fnMicroc {2x_{0} {2}{2}{2}}right),dp\\\cH00} {cH00}ccH00} {ccH00}cH00} {ccH00}cccH00} {ccH00}cH00} {ccH00}ccH00}cH00}cH00}cccH00}}ccccH00}ccH00}cccH00}cH00}ccH00}cH00}cccccH00}cH00}ccH00}cccH00}cH00}cccccH00}cH00}ccH00}cccH00}ccH00}}ccc {fnMicroc {1}} {fnMicroc {2}}} {fnunció}}} Por lo tanto, la incertidumbre entropica es el valor límite Hx+Hp=In ()2π π )+12+In ()π π 2)+12=1+In π π =In ()eπ π ).{displaystyle {begin{aligned}H_{x}+H_{p} limit=ln({sqrt {2pi }})+{frac {1}}}+lnleft({sqrt {fracrt {frac}}}{2}}}+lnlnlnlnleft({sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {sqrt {f}}}}}}}}}}}}}} {f}}}}}}}}}}}}fnf}fnfnf}f}}}}}}}}}}}}}}fnf}fnf}sqf}f}f}fn {pi}{2}}derecha)+{frac {1}}\\=1+ln pi =ln(epi)end{aligned}}} |

Un aparato de medición tendrá una resolución finita establecida por la discretización de sus posibles salidas en contenedores, con la probabilidad de estar dentro de uno de los contenedores dados por la regla de Born. Consideraremos la situación experimental más común, en la que los contenedores tienen un tamaño uniforme. Sea δx una medida de la resolución espacial. Tomamos el contenedor cero para que esté centrado cerca del origen, posiblemente con algún pequeño desplazamiento constante c. La probabilidad de estar dentro del j-ésimo intervalo de ancho δx es

Para dar cuenta de esta discretización, podemos definir la entropía de Shannon de la función de onda para un aparato de medición dado como

Según la definición anterior, la relación de incertidumbre entrópica es

Aquí notamos que δx δp/h es un espacio de fase infinitesimal típico volumen utilizado en el cálculo de una función de partición. La desigualdad también es estricta y no saturada. Los esfuerzos para mejorar este límite son un área activa de investigación.

| Ejemplo de distribución normal |

|---|

| Demostramos este método primero en el estado de la QHO, que como se discutió anteriormente satura la incertidumbre habitual basada en desviaciones estándar.

↑ ↑ ()x)=()m⋅ ⋅ π π ▪ ▪ )1/4exp ()− − m⋅ ⋅ x22▪ ▪ ){displaystyle psi (x)=left({frac {momega }{pihbar }right)^{1/4}exp {left(-{frac {momega) ¿Qué? La probabilidad de mentir dentro de uno de estos contenedores se puede expresar en términos de la función de error. P [xj]=m⋅ ⋅ π π ▪ ▪ ∫ ∫ ()j− − 1/2)δ δ x()j+1/2)δ δ xexp ()− − m⋅ ⋅ x2▪ ▪ )dx=1π π ∫ ∫ ()j− − 1/2)δ δ xm⋅ ⋅ /▪ ▪ ()j+1/2)δ δ xm⋅ ⋅ /▪ ▪ eu2du=12[er ()()j+12)δ δ x⋅ ⋅ m⋅ ⋅ ▪ ▪ )− − er ()()j− − 12)δ δ x⋅ ⋅ m⋅ ⋅ ▪ ▪ )]{displaystyle {begin{aligned}operatorname {P} [x_{j}}}}int _{(j-1/2)delta x}{(j+1/2)delta x}delta x}deta x}expleft(-{frac {momega) ################################################################################################################################################################################################################################################################ {1}{2}}left[f}f} left(left(j+{frac {1}{2}right)delta xcdot {sqrt {fracfrac}derecho) {momega ¿Qué? {momega } {hbar}}right)end{aligned}} Las probabilidades de impulso son completamente análogas. P [pj]=12[er ()()j+12)δ δ p⋅ ⋅ 1▪ ▪ m⋅ ⋅ )− − er ()()j− − 12)δ δ x⋅ ⋅ 1▪ ▪ m⋅ ⋅ )]{displaystyle operatorname [p_{j}]={2}left [operatorname {erf}left(j+{frac {1}{2}right)delta pcdot {frac {1}{sqrt {hbar momegaega) []}derecha]-operatorname {erf} left(left(j-{frac {1}{2}right)delta xcdot {1}{sqrt {hbar momega }}right)derecha]}}}} Para la simplicidad, estableceremos las resoluciones δ δ x=hm⋅ ⋅ {displaystyle delta x={sqrt {frac {h}{momega } δ δ p=hm⋅ ⋅ {displaystyle delta p={sqrt {hmomega } P [xj]=P [pj]=12[er ()()j+12)2π π )− − er ()()j− − 12)2π π )]{displaystyle operatorname {P} [x_{j}=fnMiembro de operador [p_{j}]={2}left {2}f}f}left(left(j+{frac {1}{2}right){2sqrt {2pi}right)-f}fnuncio {f}cH00}cH00}cH00}cH00} {cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}cH00}c La entropía Shannon se puede evaluar numéricamente. Hx=Hp=− − .. j=− − JUEGO JUEGO JUEGO JUEGO P [xj]In P [xj]=− − .. j=− − JUEGO JUEGO JUEGO JUEGO 12[er ()()j+12)2π π )− − er ()()j− − 12)2π π )]In 12[er ()()j+12)2π π )− − er ()()j− − 12)2π π )].. 0,3226{displaystyle {begin{aligned}H_{x}=H_{p} limit=-sum - ¿Qué? {P} [x_{j}ln operatorname {P} [x_{j}\\cH00} {fnMicrosoft Sans Serif} La incertidumbre entropica es más grande que el valor límite. ln left({frac {e}{2}}right)-ln 1approx 0.3069}" display="block" xmlns="http://www.w3.org/1998/Math/MathML">Hx+Hp.. 0,3226+0,3226=0.6452■In ()e2)− − In 1.. 0.3069{displaystyle H_{x}+H_{p}approx 0.3226+0.3226=0.6452 confianzaln left({frac {e}{2}right)-ln 1approx 0.3069} Tenga en cuenta que a pesar de estar en el caso óptimo, la desigualdad no está saturada. |

| Ejemplo de función Sinc |

|---|

| Un ejemplo de una distribución unimodal con varianza infinita es la función sinc. Si la función de onda es la distribución uniforme normalizada correctamente,

aend{cases}}}" display="block" xmlns="http://www.w3.org/1998/Math/MathML">↑ ↑ ()x)={}1/2aparaSilencioxSilencio≤ ≤ a,0paraSilencioxSilencio■a{displaystyle psi (x)={begin{cases}{1}/{sqrt {2a} limit{text{for }}Principe a,[8pt]0 ventaja{text{for }}Principio aend{cases}}}}}} φ φ ()p)=aπ π ▪ ▪ ⋅ ⋅ sinc ()ap▪ ▪ ){displaystyle varphi (p)={sqrt {frac {a}{pihbar }}cdot operatorname {sinc} left({frac {ap}{hbar }right)}}} Partitioning the uniform spatial distribution into two equal bins is straightforward. Hemos fijado el offset c= 1/2 para que los dos contenedores abarquen la distribución. P [x0]=∫ ∫ − − a012adx=12{displaystyle operatorname [x_{0]= ¿Por qué? {1}{2}}} P [x1]=∫ ∫ 0a12adx=12{displaystyle operatorname [x_{1}=int _{0}{a}{1}{2a},dx={frac} {1}{2}}} Hx=− − .. j=01P [xj]In P [xj]=− − 12In 12− − 12In 12=In 2{displaystyle H_{x}=-sum ################################################################################################################################################################################################################################################################ {P} [x_{j}ln operatorname [x_{j]=-{2}ln} {fnMicroc {1}{2}-{frac {1}{2}ln} {fnMicroc {1}{2}=ln} 2} Los cubos para el impulso deben cubrir toda la línea real. Como se hizo con la distribución espacial, podríamos aplicar un offset. Resulta, sin embargo, que la entropía Shannon es minimizada cuando el bin cero para el impulso se centra en el origen. (Se alienta al lector a intentar agregar un offset.) La probabilidad de mentir dentro de un contenedor de impulso arbitrario se puede expresar en términos de la integral sine. P [pj]=aπ π ▪ ▪ ∫ ∫ ()j− − 1/2)δ δ p()j+1/2)δ δ psinc2 ()ap▪ ▪ )dp=1π π ∫ ∫ 2π π ()j− − 1/2)2π π ()j+1/2)sinc2 ()u)du=1π π [Si ()()4j+2)π π )− − Si ()()4j− − 2)π π )]{displaystyle {begin{aligned}operatorname {P} {p_{j}}int _{(j-1/2)delta p}{(j+1/2)delta p. {fnMicrosoft Sans Serif},dp\\fnMicroc {fnMicroc}int}int _{2pi (j-1/2)} {fnMicrosoft Sans Serif} {fnMicrosoft ]}fnuncio {f}fnMicroc}fnMicros} {fnMicrosoft}f}f}f}fnun}f}f}f}fnun}f}f}f}f}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnunfnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun}fnun} }left[operatorname {Si}(4j+2)pi)-operatorname {Si} ((4j-2)pi)right]end{aligned}} La entropía Shannon se puede evaluar numéricamente. Hp=− − .. j=− − JUEGO JUEGO JUEGO JUEGO P [pj]In P [pj]=− − P [p0]In P [p0]− − 2⋅ ⋅ .. j=1JUEGO JUEGO P [pj]In P [pj].. 0,53{displaystyle H_{p}=-sum _{j=-infty {P} [p_{j}ln operatorname [p_{j}]=-operatorname {P} [p_{0}ln operatorname [p_{0}]-2cdot sum _{j=1}{infty }operatorname {P} [p_{j}ln operatorname {P} [p_{j}approx 0.53} La incertidumbre entropica es más grande que el valor límite. ln left({frac {e}{2}}right)-ln 1approx 0.31}" display="block" xmlns="http://www.w3.org/1998/Math/MathML">Hx+Hp.. 0.69+0,53=1.22■In ()e2)− − In 1.. 0.31{displaystyle H_{x}+H_{p}approx 0,69+0.53=1.22 tituladaln left({frac {e}{2}right)-ln 1approx 0,31} |

Relación de incertidumbre con tres componentes de momento angular

Para una partícula de spin-j{displaystyle j} la siguiente relación de incertidumbre

Análisis armónico

En el contexto del análisis armónico, una rama de las matemáticas, el principio de incertidumbre implica que no se puede localizar al mismo tiempo el valor de una función y su transformada de Fourier. A saber, se cumple la siguiente desigualdad,

Más desigualdades de incertidumbre matemática, incluida la incertidumbre entrópica anterior, se dan entre una función f y su transformada de Fourier ƒ̂:

Procesamiento de señales

En el contexto del procesamiento de señales y, en particular, del análisis de tiempo-frecuencia, los principios de incertidumbre se conocen como el límite de Gabor, en honor a Dennis Gabor, o a veces el límite de Heisenberg-Gabor. El resultado básico, que se deriva del "teorema de Benedictis", a continuación, es que una función no puede estar limitada en el tiempo y en la banda (una función y su transformada de Fourier no pueden tener un dominio acotado)—ver banda limitada versus tiempo limitado. Por lo tanto

Dicho de otro modo, "uno no puede localizar de forma precisa una señal simultáneamente (función f) tanto en el dominio del tiempo como en el dominio de frecuencia (ƒ̂, su transformada de Fourier)".

Cuando se aplica a los filtros, el resultado implica que no se puede lograr una resolución temporal alta y una resolución de frecuencia al mismo tiempo; un ejemplo concreto son los problemas de resolución de la transformada de Fourier de tiempo corto: si se usa una ventana ancha, se logra una buena resolución de frecuencia a costa de la resolución temporal, mientras que una ventana estrecha tiene la contrapartida.

Los teoremas alternativos brindan resultados cuantitativos más precisos y, en el análisis de tiempo-frecuencia, en lugar de interpretar los dominios de tiempo y frecuencia (unidimensionales) por separado, uno interpreta el límite como un límite inferior en el soporte de una función en el plano (bidimensional) de tiempo-frecuencia. En la práctica, el límite de Gabor limita la resolución de tiempo-frecuencia simultánea que se puede lograr sin interferencia; es posible lograr una resolución más alta, pero a costa de que diferentes componentes de la señal interfieran entre sí.

Como resultado, para analizar señales en las que los transitorios son importantes, a menudo se usa la transformada wavelet en lugar de Fourier.

Transformada discreta de Fourier

Vamos {}xn}:=x0,x1,...... ,xN− − 1{displaystyle left{Mathbf {x_{n} right:=x_{0},x_{1},ldotsx_{N-1} ser una secuencia de N números complejos y {}Xk}:=X0,X1,...... ,XN− − 1,{displaystyle left{mathbf {X_{k} right}:=X_{0},X_{1},ldotsX_{N-1} su discreta transformación Fourier.

Denote by .. x.. 0{displaystyle "Principio" el número de elementos no cero en la secuencia del tiempo x0,x1,...... ,xN− − 1{displaystyle x_{0},x_{1},ldotsx_{N-1} y por .. X.. 0{displaystyle "Principio" el número de elementos no cero en la secuencia de frecuencias X0,X1,...... ,XN− − 1{displaystyle X_{0},X_{1},ldotsX_{N-1}. Entonces,

Esta desigualdad es pronunciada, y se logra la igualdad cuando x o X es una masa de Dirac, o más generalmente cuando x es un múltiplo distinto de cero de un peine de Dirac apoyado en un subgrupo de los enteros módulo N (en cuyo caso X es también un peine de Dirac apoyado en un subgrupo complementario, y viceversa).

Más generalmente, si T y W son subconjuntos de los enteros modulo N, vamos LT,RW:l l 2()Z/NN)→ → l l 2()Z/NN){displaystyle ¿Qué? denota el operador de limitación de tiempo y operadores de limitación de bandas, respectivamente. Entonces...

Cuando N es un número primo, se cumple una desigualdad más fuerte:

Teorema de Benedictis

El teorema de Amrein–Berthier y Benedicks dice intuitivamente que el conjunto de puntos donde f es distinto de cero y el conjunto de puntos donde ƒ̂ es distinto de cero no puede ser pequeño.

Específicamente, es imposible para una función f en L2(R) y su transformada de Fourier ƒ̂ para que ambos sean compatibles con conjuntos finitos de Lebesgue medida. Una versión más cuantitativa es

Uno espera que el factor CeC|S||Σ| pueda ser reemplazado por CeC(|S||Σ|)1/d, que solo se conoce si S o Σ es convexo.

Principio de incertidumbre de Hardy

El matemático G. H. Hardy formuló el siguiente principio de incertidumbre: no es posible f y . para ser "muy rápidamente disminuyendo". Específicamente, si f dentro L2()R){displaystyle L^{2}(mathbb {R})} es tal que

entonces, si ab > 1, f = 0, mientras que si ab = 1, entonces existe un polinomio P de grado ≤ N tal que

This was later improved as follows: si f▪ ▪ L2()Rd){displaystyle fin L^{2}(mathbb {R} {d})} es tal que

Este resultado fue declarado en las obras completas de Beurling sin pruebas y probado en Hörmander (el caso d=1,N=0{displaystyle d=1,N=0}) y Bonami, Demange, y Jaming para el caso general. Tenga en cuenta que la versión de Hörmander-Beurling implica el caso ab ■ 1 en Hardy's Teorema mientras la versión de Bonami–Demange–Jaming cubre la fuerza total del Teorema de Hardy. Una prueba diferente del teorema de Beurling basado en el teorema de Liouville apareció en ref.

Una descripción completa del caso ab < 1 así como la siguiente extensión a las distribuciones de clase de Schwartz aparece en la ref.

Theorem— Si una distribución templada f▪ ▪ S.()Rd){displaystyle fin {fnMithcal}'(mathbb {R} } es tal que

Historia

Werner Heisenberg formuló el principio de incertidumbre en el instituto Niels Bohr de Copenhague, mientras trabajaba en los fundamentos matemáticos de la mecánica cuántica.

En 1925, siguiendo el trabajo pionero con Hendrik Kramers, Heisenberg desarrolló la mecánica matricial, que reemplazó la antigua teoría cuántica ad hoc con la mecánica cuántica moderna. La premisa central era que el concepto clásico de movimiento no se ajusta al nivel cuántico, ya que los electrones en un átomo no viajan en órbitas claramente definidas. Más bien, su movimiento se difumina de una manera extraña: la transformada de Fourier de su dependencia del tiempo solo involucra aquellas frecuencias que podrían observarse en los saltos cuánticos de su radiación.

El artículo de Heisenberg no admitía ninguna cantidad no observable como la posición exacta del electrón en una órbita en cualquier momento; solo permitió que el teórico hablara sobre los componentes de Fourier del movimiento. Dado que los componentes de Fourier no estaban definidos en las frecuencias clásicas, no podían usarse para construir una trayectoria exacta, por lo que el formalismo no podía responder ciertas preguntas demasiado precisas sobre dónde estaba el electrón o qué tan rápido iba.

Según un relato: el artículo de "Heisenberg' marcó un alejamiento radical de los intentos anteriores de resolver problemas atómicos haciendo uso únicamente de cantidades observables. "Todos mis escasos esfuerzos se dirigen a eliminar y reemplazar adecuadamente el concepto de las trayectorias orbitales que uno no puede observar", escribió en una carta fechada el 9 de julio de 1925."

En realidad, fue Einstein quien planteó el problema por primera vez a Heisenberg en 1926 en su primera discusión real. Einstein había invitado a Heisenberg a su casa para una discusión sobre la mecánica de matrices después de su introducción. Tal como Heisenberg describe la discusión: “De camino a casa, me preguntó sobre mis antecedentes, mis estudios con Sommerfeld. Pero al llegar comenzó de inmediato con una pregunta central sobre el fundamento filosófico de la nueva mecánica cuántica. Me señaló que en mi descripción matemática la noción de 'trayecto de electrones' no ocurrió en absoluto, pero que en una cámara de niebla la trayectoria del electrón puede, por supuesto, observarse directamente. Le parecía absurdo afirmar que efectivamente había un camino de electrones en la cámara de niebla, pero ninguno en el interior del átomo." En esta situación, por supuesto, nosotros [Heisenberg y Bohr] tuvimos muchas discusiones, discusiones difíciles, porque todos sentimos que el esquema matemático de la mecánica cuántica u ondulatoria ya era definitivo. No se podría cambiar, y tendríamos que hacer todos nuestros cálculos a partir de este esquema. Por otro lado, nadie sabía cómo representar en este esquema un caso tan simple como el camino de un electrón a través de una cámara de niebla."

En marzo de 1926, trabajando en el instituto de Bohr, Heisenberg se dio cuenta de que la no conmutatividad implica el principio de incertidumbre. Esta implicación proporcionó una interpretación física clara de la no conmutatividad y sentó las bases de lo que se conoció como la interpretación de Copenhague de la mecánica cuántica. Heisenberg mostró que la relación de conmutación implica una incertidumbre, o en el lenguaje de Bohr, una complementariedad. Dos variables cualesquiera que no se conmutan no se pueden medir simultáneamente: cuanto más precisamente se conoce una, menos precisamente se puede conocer la otra. Heisenberg escribió:

Puede expresarse en su forma más simple como sigue: Uno nunca puede saber con precisión perfecta tanto de esos dos factores importantes que determinan el movimiento de una de las partículas más pequeñas, su posición y su velocidad. Es imposible determinar con precisión ambos la posición y la dirección y velocidad de una partícula en el mismo instante.

En su célebre artículo de 1927, "Über den anschaulichen Inhalt der quantentheoretischen Kinematik und Mechanik" ("Sobre el contenido perceptivo de la cinemática y la mecánica teóricas cuánticas"), Heisenberg estableció esta expresión como la cantidad mínima de perturbación del momento inevitable causada por cualquier medición de posición, pero no dio una definición precisa de las incertidumbres Δx y Δp. En cambio, dio algunas estimaciones plausibles en cada caso por separado. En su conferencia de Chicago refinó su principio:

- Δ Δ xΔ Δ p≳ ≳ h{displaystyle Delta x,Delta pgtrsim h}

()A1)

Kennard en 1927 demostró por primera vez la desigualdad moderna:

- σ σ xσ σ p≥ ≥ ▪ ▪ 2{displaystyle sigma _{x}sigma ¿Qué? {hbar} } {2}}

()A2)

donde ħ = h/2π, y σx, σp son las desviaciones estándar de posición y momento. Heisenberg solo probó la relación (A2) para el caso especial de estados gaussianos.

Terminología y traducción

A lo largo de la parte principal de su artículo original de 1927, escrito en alemán, Heisenberg usó la palabra "Ungenauigkeit" ("indeterminación"), describir el principio teórico básico. Solo en la nota final cambió a la palabra "Unsicherheit" ("incertidumbre"). Sin embargo, cuando la versión en inglés del libro de texto de Heisenberg, Los principios físicos de la teoría cuántica, se publicó en 1930, la traducción "incertidumbre" se usó, y se convirtió en el término más comúnmente usado en el idioma inglés a partir de entonces.

Microscopio de Heisenberg

El principio es bastante contrario a la intuición, por lo que los primeros estudiantes de la teoría cuántica tenían que estar seguros de que las medidas ingenuas para violarlo siempre serían impracticables. Una forma en la que Heisenberg ilustró originalmente la imposibilidad intrínseca de violar el principio de incertidumbre es utilizando el efecto del observador de un microscopio imaginario como dispositivo de medición.

Imagina a un experimentador tratando de medir la posición y el momento de un electrón disparándole un fotón.

- Problema 1 – Si el fotón tiene una longitud de onda corta, y por lo tanto, un gran impulso, la posición se puede medir con precisión. Pero el fotón se dispersa en una dirección al azar, transfiriendo una gran cantidad de impulso al electrón. Si el fotón tiene una larga longitud de onda y un bajo impulso, la colisión no perturba mucho el impulso del electrón, pero la dispersión revelará su posición sólo vagamente.

- Problema 2 – Si se utiliza una abertura grande para el microscopio, la ubicación del electrón puede resolverse bien (ver criterio de Rayleigh); pero por el principio de conservación del impulso, el impulso transversal del foton entrante afecta el impulso de la línea de haz del electrón y por lo tanto, el nuevo impulso del electrón resuelve mal. Si se utiliza una pequeña abertura, la exactitud de ambas resoluciones es la otra manera.

La combinación de estas ventajas y desventajas implica que, independientemente de la longitud de onda del fotón y el tamaño de apertura que se usen, el producto de la incertidumbre en la posición medida y el momento medido es mayor o igual a un límite inferior, que es (hasta un pequeño factor numérico) igual a la constante de Planck. Heisenberg no se preocupó de formular el principio de incertidumbre como un límite exacto, y prefirió usarlo en su lugar, como una afirmación cuantitativa heurística, corregida hasta pequeños factores numéricos, lo que hace inevitable la no conmutatividad radicalmente nueva de la mecánica cuántica.

Reacciones críticas

La interpretación de Copenhague de la mecánica cuántica y el Principio de Incertidumbre de Heisenberg fueron, de hecho, vistos como objetivos gemelos por los detractores que creían en un determinismo y un realismo subyacentes. De acuerdo con la interpretación de Copenhague de la mecánica cuántica, no existe una realidad fundamental que describa el estado cuántico, solo una receta para calcular los resultados experimentales. No hay forma de decir cuál es fundamentalmente el estado de un sistema, solo cuál podría ser el resultado de las observaciones.

Albert Einstein creía que la aleatoriedad es un reflejo de nuestra ignorancia de alguna propiedad fundamental de la realidad, mientras que Niels Bohr creía que las distribuciones de probabilidad son fundamentales e irreducibles, y dependen de las medidas que elijamos realizar. Einstein y Bohr debatieron el principio de incertidumbre durante muchos años.

El ideal del observador imparcial

Wolfgang Pauli llamó a la objeción fundamental de Einstein al principio de incertidumbre "el ideal del observador imparcial" (frase traducida del alemán):

"Al igual que la luna tiene una posición definida" Einstein me dijo el invierno pasado, "si miramos o no a la luna, lo mismo también debe mantener los objetos atómicos, ya que no hay una distinción aguda posible entre estos y objetos macroscópicos. La observación no puede crear un elemento de realidad como una posición, debe haber algo contenido en la descripción completa de la realidad física que corresponde a la posibilidad de observar una posición, ya antes de que se haya hecho la observación." Espero, que cité correctamente a Einstein; siempre es difícil citar a alguien fuera de memoria con quien uno no está de acuerdo. Es precisamente este tipo de postulado que yo llamo el ideal del observador separado.

- Carta de Pauli a Niels Bohr, 15 de febrero de 1955

La hendidura de Einstein

El primero de los experimentos mentales de Einstein que desafió el principio de incertidumbre fue el siguiente:

- Considere una partícula que pasa por una ranura de ancho d. La hendidura introduce una incertidumbre en el impulso de aproximadamente h/d porque la partícula pasa por la pared. Pero vamos a determinar el impulso de la partícula midiendo el retroceso de la pared. Al hacerlo, encontramos el impulso de la partícula a la precisión arbitraria mediante la conservación del impulso.

La respuesta de Bohr fue que la pared también es mecánica cuántica, y que para medir el retroceso con precisión Δp, el el momento de la pared debe conocerse con esta precisión antes de que la partícula pase a través de ella. Esto introduce una incertidumbre en la posición de la pared y por lo tanto la posición de la rendija igual a h/Δp, y si el momento de la pared se conoce con suficiente precisión para medir el retroceso, la posición de la rendija es lo suficientemente incierta como para no permitir una medición de posición.

Richard Feynman proporciona un análisis similar con partículas que se difractan a través de múltiples rendijas.

Caja de Einstein

Bohr estuvo presente cuando Einstein propuso el experimento mental que se conoce como la caja de Einstein. Einstein argumentó que "la ecuación de incertidumbre de Heisenberg implicaba que la incertidumbre en el tiempo estaba relacionada con la incertidumbre en la energía, y el producto de los dos estaba relacionado con la constante de Planck". Considere, dijo, una caja ideal, forrada con espejos para que pueda contener luz indefinidamente. La caja podía pesarse antes de que un mecanismo de relojería abriera un obturador ideal en un instante elegido para permitir que escapara un solo fotón. "Ahora sabemos, explicó Einstein, exactamente el momento en que el fotón salió de la caja." "Ahora, pesa la caja nuevamente. El cambio de masa indica la energía de la luz emitida. De esta manera, dijo Einstein, se podría medir la energía emitida y el tiempo en que fue liberada con cualquier precisión deseada, en contradicción con el principio de incertidumbre."

Bohr pasó una noche sin dormir considerando este argumento y finalmente se dio cuenta de que era erróneo. Señaló que si la caja fuera a pesarse, digamos con un resorte y un puntero en una balanza, "dado que la caja debe moverse verticalmente con un cambio en su peso, habrá incertidumbre en su velocidad vertical y por lo tanto una incertidumbre en su altura sobre la mesa... Además, la incertidumbre sobre la elevación sobre la superficie de la Tierra resultará en una incertidumbre en la velocidad del reloj," debido a la propia teoría de Einstein del efecto de la gravedad sobre el tiempo. "A través de esta cadena de incertidumbres, Bohr demostró que el experimento de la caja de luz de Einstein no podía medir simultáneamente con exactitud la energía del fotón y el tiempo de su escape".

Paradoja EPR para partículas entrelazadas

Bohr se vio obligado a modificar su comprensión del principio de incertidumbre después de otro experimento mental de Einstein. En 1935, Einstein, Podolsky y Rosen publicaron un análisis de partículas entrelazadas ampliamente separadas (paradoja EPR). Einstein se dio cuenta de que medir una partícula alteraría la distribución de probabilidad de la otra, pero aquí la otra partícula no podría verse perturbada. Este ejemplo llevó a Bohr a revisar su comprensión del principio y concluyó que la incertidumbre no fue causada por una interacción directa.

Pero Einstein llegó a conclusiones de mayor alcance a partir del mismo experimento mental. Él creía que la "suposición básica natural" que una descripción completa de la realidad tendría que predecir los resultados de los experimentos a partir de "cantidades deterministas que cambian localmente" y por tanto tendría que incluir más información que la máxima posible permitida por el principio de incertidumbre.

En 1964, John Stewart Bell demostró que esta suposición se puede falsear, ya que implicaría una cierta desigualdad entre las probabilidades de diferentes experimentos. Los resultados experimentales confirman las predicciones de la mecánica cuántica, descartando la suposición básica de Einstein que lo llevó a sugerir sus variables ocultas. Estas variables ocultas pueden estar "ocultas" debido a una ilusión que ocurre durante las observaciones de objetos que son demasiado grandes o demasiado pequeños. Esta ilusión se puede comparar con las aspas de un ventilador giratorio que parecen aparecer y desaparecer en diferentes lugares y, a veces, parecen estar en el mismo lugar al mismo tiempo cuando se observan. Esta misma ilusión se manifiesta en la observación de partículas subatómicas. Tanto las aspas del ventilador como las partículas subatómicas se mueven tan rápido que el observador ve la ilusión. Por lo tanto, es posible que haya previsibilidad del comportamiento y las características de las partículas subatómicas en un dispositivo de registro capaz de rastrear a muy alta velocidad... Irónicamente, este hecho es una de las mejores pruebas que respaldan la filosofía de Karl Popper. de invalidación de una teoría por experimentos de falsación. Es decir, aquí el "supuesto básico" de Einstein; se falsificó mediante experimentos basados en las desigualdades de Bell. Para las objeciones de Karl Popper a la propia desigualdad de Heisenberg, véase más abajo.

Si bien es posible suponer que las predicciones de la mecánica cuántica se deben a variables ocultas no locales y, de hecho, David Bohm inventó tal formulación, esta resolución no es satisfactoria para la gran mayoría de los físicos. La cuestión de si un resultado aleatorio está predeterminado por una teoría no local puede ser filosófica y potencialmente intratable. Si las variables ocultas no estuvieran restringidas, podrían ser solo una lista de dígitos aleatorios que se usan para producir los resultados de la medición. Para que sea sensato, la suposición de variables ocultas no locales a veces se complementa con una segunda suposición: que el tamaño del universo observable pone un límite a los cálculos que pueden hacer estas variables. Una teoría no local de este tipo predice que una computadora cuántica encontraría obstáculos fundamentales al intentar factorizar números de aproximadamente 10.000 dígitos o más; una tarea potencialmente alcanzable en la mecánica cuántica.

Críticas de Popper

Karl Popper abordó el problema de la indeterminación como un lógico y realista metafísico. No estuvo de acuerdo con la aplicación de las relaciones de incertidumbre a partículas individuales en lugar de conjuntos de partículas preparadas de forma idéntica, y se refirió a ellas como "relaciones de dispersión estadísticas". En esta interpretación estadística, una medida particular puede hacerse con una precisión arbitraria sin invalidar la teoría cuántica. Esto contrasta directamente con la interpretación de Copenhague de la mecánica cuántica, que no es determinista pero carece de variables ocultas locales.

En 1934, Popper publicó Zur Kritik der Ungenauigkeitsrelationen (Crítica de las relaciones de incertidumbre) en Naturwissenschaften, y en el mismo año Logik der Forschung (traducido y actualizado por el autor como The Logic of Scientific Discovery en 1959), esbozando sus argumentos a favor de la interpretación estadística. En 1982, desarrolló aún más su teoría en Teoría cuántica y el cisma en física, escribiendo:

[La fórmula de Heisenberg] son, más allá de toda duda, derivados fórmulas estadísticas de la teoría cuántica. Pero han sido habitualmente malinterpretado por aquellos teóricos cuánticos que dijeron que estas fórmulas pueden ser interpretadas como la determinación de algún límite superior al precisión de nuestras mediciones. [con énfasis original]

Popper propuso un experimento para falsificar las relaciones de incertidumbre, aunque luego retiró su versión inicial después de discusiones con Weizsäcker, Heisenberg y Einstein; este experimento puede haber influido en la formulación del experimento EPR.

Incertidumbre de muchos mundos

La interpretación de muchos mundos esbozada originalmente por Hugh Everett III en 1957 pretende en parte reconciliar las diferencias entre los puntos de vista de Einstein y Bohr al reemplazar el colapso de la función de onda de Bohr con un conjunto de universos deterministas e independientes cuya distribución está gobernada por funciones de onda y la ecuación de Schrödinger. Por lo tanto, la incertidumbre en la interpretación de muchos mundos se deriva de que cada observador dentro de cualquier universo no tiene conocimiento de lo que sucede en los otros universos.

Libre albedrío

Algunos científicos, incluidos Arthur Compton y Martin Heisenberg, han sugerido que el principio de incertidumbre, o al menos la naturaleza probabilística general de la mecánica cuántica, podría ser evidencia del modelo de dos etapas del libre albedrío. Sin embargo, una crítica es que, aparte del papel básico de la mecánica cuántica como base para la química, los mecanismos biológicos no triviales que requieren mecánica cuántica son poco probables, debido al rápido tiempo de decoherencia de los sistemas cuánticos a temperatura ambiente. Los defensores de esta teoría dicen comúnmente que esta decoherencia es superada por los subespacios libres de decoherencia y filtrado que se encuentran en las células biológicas.

Termodinámica

Hay razones para creer que violar el principio de incertidumbre también implica fuertemente la violación de la segunda ley de la termodinámica. Véase la paradoja de Gibbs.

Contenido relacionado

Calorimetría

Superconductividad a alta temperatura

Aeronáutica

![{displaystyle operatorname {P} [aleq Xleq b]=int _{a}^{b}|psi (x)|^{2},mathrm {d} x~.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f8852ff1f2e7c518fce8dfbb77f8e8a7920c63f3)

![{displaystyle {begin{aligned}g(x)&={frac {1}{sqrt {2pi hbar }}}cdot int _{-infty }^{infty }{tilde {g}}(p)cdot e^{ipx/hbar },dp\&={frac {1}{sqrt {2pi hbar }}}int _{-infty }^{infty }pcdot varphi (p)cdot e^{ipx/hbar },dp\&={frac {1}{2pi hbar }}int _{-infty }^{infty }left[pcdot int _{-infty }^{infty }psi (chi)e^{-ipchi /hbar },dchi right]cdot e^{ipx/hbar },dp\&={frac {i}{2pi }}int _{-infty }^{infty }left[{cancel {left.psi (chi)e^{-ipchi /hbar }right|_{-infty }^{infty }}}-int _{-infty }^{infty }{frac {dpsi (chi)}{dchi }}e^{-ipchi /hbar },dchi right]cdot e^{ipx/hbar },dp\&={frac {-i}{2pi }}int _{-infty }^{infty }int _{-infty }^{infty }{frac {dpsi (chi)}{dchi }}e^{-ipchi /hbar },dchi ,e^{ipx/hbar },dp\&=left(-ihbar {frac {d}{dx}}right)cdot psi (x),end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/42db5a07d8c895b1e9caffa2cde0b6df608ec8f8)

![{displaystyle {begin{aligned}langle fmid grangle -langle gmid frangle ={}&int _{-infty }^{infty }psi ^{*}(x),xcdot left(-ihbar {frac {d}{dx}}right),psi (x),dx\&{}-int _{-infty }^{infty }psi ^{*}(x),left(-ihbar {frac {d}{dx}}right)cdot x,psi (x),dx\={}&ihbar cdot int _{-infty }^{infty }psi ^{*}(x)left[left(-xcdot {frac {dpsi (x)}{dx}}right)+{frac {d(xpsi (x))}{dx}}right],dx\={}&ihbar cdot int _{-infty }^{infty }psi ^{*}(x)left[left(-xcdot {frac {dpsi (x)}{dx}}right)+psi (x)+left(xcdot {frac {dpsi (x)}{dx}}right)right],dx\={}&ihbar cdot int _{-infty }^{infty }psi ^{*}(x)psi (x),dx\={}&ihbar cdot int _{-infty }^{infty }|psi (x)|^{2},dx\={}&ihbar end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d4ddead3f7e2d237c2ad9bb5258ad66a9d92c599)

![{displaystyle [{hat {A}},{hat {B}}]={hat {A}}{hat {B}}-{hat {B}}{hat {A}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3133da214f8f0fcf1ba11e907cfd121a2179b1b4)

![{displaystyle [{hat {x}},{hat {p}}]=ihbar.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fee0861ae7784cb51a1b43f6c51735c22c23274e)

![{displaystyle [{hat {x}},{hat {p}}]|psi rangle =({hat {x}}{hat {p}}-{hat {p}}{hat {x}})|psi rangle =({hat {x}}-x_{0}{hat {I}}){hat {p}},|psi rangle =ihbar |psi rangle}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8255257353e4743e966c106dea5674689ed04690)

![{displaystyle [{hat {x}},{hat {p}}]|psi rangle =ihbar |psi rangle neq 0.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/04d341bbd1c29d8f96a5ce5ad6e2cf856d1b1f40)

![{displaystyle [{hat {A}},{hat {B}}]={hat {A}}{hat {B}}-{hat {B}}{hat {A}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9814a77ea436e956fd7abaad7b5906457037b565)

![{displaystyle sigma _{A}sigma _{B}geq left|{frac {1}{2i}}langle [{hat {A}},{hat {B}}]rangle right|={frac {1}{2}}left|langle [{hat {A}},{hat {B}}]rangle right|,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2e237cc47d6a6ffaf614f696672356c362f84ac0)

![{displaystyle sigma _{A}^{2}sigma _{B}^{2}geq left|{frac {1}{2}}langle {{hat {A}},{hat {B}}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle right|^{2}+left|{frac {1}{2i}}langle [{hat {A}},{hat {B}}]rangle right|^{2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/81d7a893fe43757553fb6a3e5a51cdb83290aadd)

![{displaystyle {begin{aligned}langle fmid grangle &=langle Psi |({hat {A}}-langle {hat {A}}rangle)({hat {B}}-langle {hat {B}}rangle)Psi rangle \[4pt]&=langle Psi mid ({hat {A}}{hat {B}}-{hat {A}}langle {hat {B}}rangle -{hat {B}}langle {hat {A}}rangle +langle {hat {A}}rangle langle {hat {B}}rangle)Psi rangle \[4pt]&=langle Psi mid {hat {A}}{hat {B}}Psi rangle -langle Psi mid {hat {A}}langle {hat {B}}rangle Psi rangle -langle Psi mid {hat {B}}langle {hat {A}}rangle Psi rangle +langle Psi mid langle {hat {A}}rangle langle {hat {B}}rangle Psi rangle \[4pt]&=langle {hat {A}}{hat {B}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle +langle {hat {A}}rangle langle {hat {B}}rangle \[4pt]&=langle {hat {A}}{hat {B}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle.end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e8c0c05428ab53be785878d1546c265c45c6e755)

![{displaystyle langle fmid grangle -langle gmid frangle =langle {hat {A}}{hat {B}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle -langle {hat {B}}{hat {A}}rangle +langle {hat {A}}rangle langle {hat {B}}rangle =langle [{hat {A}},{hat {B}}]rangle }](https://wikimedia.org/api/rest_v1/media/math/render/svg/eaf12a5caf8e73c4e1cfdfbbf3ebb1c3e32e7e0f)

![{displaystyle |langle fmid grangle |^{2}={Big (}{frac {1}{2}}langle {{hat {A}},{hat {B}}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle {Big)}^{2}+{Big (}{frac {1}{2i}}langle [{hat {A}},{hat {B}}]rangle {Big)}^{2},.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/074cd206c3b6789fd747fa2efa892ea596651470)

![{displaystyle sigma _{A}sigma _{B}geq {sqrt {{Big (}{frac {1}{2}}langle {{hat {A}},{hat {B}}}rangle -langle {hat {A}}rangle langle {hat {B}}rangle {Big)}^{2}+{Big (}{frac {1}{2i}}langle [{hat {A}},{hat {B}}]rangle {Big)}^{2}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/96a2a724edaa3e9b3e175f7de8158b796bef58c0)

![{displaystyle sigma _{A}^{2}sigma _{B}^{2}geq left|{frac {1}{2}}operatorname {tr} (rho {A,B})-operatorname {tr} (rho A)operatorname {tr} (rho B)right|^{2}+left|{frac {1}{2i}}operatorname {tr} (rho [A,B])right|^{2}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c8271822251517d5a4e6879ea287fd36556a95e8)

![{displaystyle sigma _{A}^{2}+sigma _{B}^{2}geq pm ilangle Psi mid [A,B]|Psi rangle +mid langle Psi mid (Apm iB)mid {bar {Psi }}rangle |^{2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fe87035b4463c5578ccda71d74b8e7c9fd627515)

![{displaystyle pm ilangle Psi mid [A,B]mid Psi rangle }](https://wikimedia.org/api/rest_v1/media/math/render/svg/3a34a5250780e2a23b4befafff39d5522cc8266c)

![{displaystyle sigma _{A}^{2}sigma _{B}^{2}geq left[sum _{k}p_{k}L(varrho _{k})right]^{2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fe2197885d47337c2e848acc051efdea71b02870)

![{displaystyle L(varrho)={sqrt {left|{frac {1}{2}}operatorname {tr} (rho {A,B})-operatorname {tr} (rho A)operatorname {tr} (rho B)right|^{2}+left|{frac {1}{2i}}operatorname {tr} (rho [A,B])right|^{2}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9217563cc15d7b37797888126f4b4c44b7f19c08)

![{displaystyle sigma _{A}^{2}sigma _{B}^{2}geq left[max _{p_{k},varrho _{k}}sum _{k}p_{k}L(varrho _{k})right]^{2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/98f249b302c95aa4be14de7ec6f82ffb5f169d5e)

![{displaystyle sigma _{A}^{2}F_{Q}[varrhoB]geq 4left[min _{p_{k},Psi _{k}}sum _{k}p_{k}L(vert Psi _{k}rangle langle Psi _{k}vert)right]^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/58902ccc3a0b70047c4db2a60db2c59e012fd34f)

![{displaystyle F_{Q}[varrhoB]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7022310dbb24400e5c70f2a78e6f35633b161a2a)

![{displaystyle sigma _{A}^{2}F_{Q}[varrhoB]geq vert langle i[A,B]rangle vert ^{2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c25345e515fab68aaa473847b0f644f1d1b0965a)

![{displaystyle F_{Q}[varrhoB]leq 4sigma _{B},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/76b697790877dcd32b480f16ef3565113c062e83)

![{displaystyle [{hat {x}},{hat {p}}]=ihbar }](https://wikimedia.org/api/rest_v1/media/math/render/svg/42dbbd0db710385288536bcf4f4a1b7cceb75d9a)

![{displaystyle [J_{x},J_{y}]=ihbar varepsilon _{xyz}J_{z}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92feb40a1e1bb732beffa55c687ccfbcec8ff007)

![[0,2pi]](https://wikimedia.org/api/rest_v1/media/math/render/svg/348d40bf3f8b7e1c00c4346440d7e2e4f0cc9b91)

![{displaystyle {hat {A}}psi (theta)=theta psi (theta),quad theta in [0,2pi ],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f85b2a63d69030bd4deabafe7641563413b8ec23)

![{displaystyle [{hat {A}},{hat {B}}]=ihbar }](https://wikimedia.org/api/rest_v1/media/math/render/svg/ac8c6748f07eed66c5b329fcebdb8ca9d859ff71)

![{displaystyle varepsilon _{A},eta _{B}+varepsilon _{A},sigma _{B}+sigma _{A},eta _{B},geq ,{frac {1}{2}},left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e07b031a15d10a6380f7ee47da5c5c1dfb93e31a)

![{displaystyle varepsilon _{A},eta _{B},geq ,{frac {1}{2}},left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|}](https://wikimedia.org/api/rest_v1/media/math/render/svg/28d08057de34306115c996b9943fb0603282befc)

![{displaystyle varepsilon _{A},varepsilon _{B},geq ,{frac {1}{2}},left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8f93231686a00ca50485a5eccdadddfbc4f6b2c3)

![{displaystyle sigma _{A},sigma _{B},geq ,{frac {1}{2}},left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1606cabaad53903e8110417fff05ebda20a2dd41)

![{displaystyle varepsilon _{A}eta _{B}+varepsilon _{A},sigma _{B}+sigma _{A},eta _{B}+sigma _{A}sigma _{B}geq left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/99801a6fd6e9d9f36223cce7aba8a30cf39e6230)

![{displaystyle (varepsilon _{A}+sigma _{A}),(eta _{B}+sigma _{B}),geq ,left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8ec1acc4af7b675c838b09fc719057c5d16819c4)

![{displaystyle {bar {varepsilon }}_{A},{bar {eta }}_{B},geq ,left|{Bigl langle }{bigl [}{hat {A}},{hat {B}}{bigr ]}{Bigr rangle }right|}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bb507c6e7fa92a94bfb07f979999ccbb5ac7450a)