Mapa lineal

En matemáticas, y más específicamente en álgebra lineal, a mapa lineal (también llamado a cartografía lineal, transformación lineal, homomorfismo espacial vectorial, o en algunos contextos función lineal) es un mapeo V→ → W{displaystyle Vto W} entre dos espacios vectoriales que preserva las operaciones de la adición vectorial y la multiplicación del escalar. Los mismos nombres y la misma definición también se utilizan para el caso más general de módulos sobre un anillo; véase el homomorfismo del módulo.

Si un mapa lineal es una bijeción entonces se llama isomorfismo lineal. En el caso en que V=W{displaystyle V=W!, un mapa lineal se llama a (linear) endomorfismo. A veces el término operador lineal se refiere a este caso, pero el término "operador lineal" puede tener diferentes significados para diferentes convenciones: por ejemplo, se puede utilizar para enfatizar que V{displaystyle V} y W{displaystyle W. son espacios vectoriales reales (no necesariamente con V=W{displaystyle V=W!), o se puede utilizar para enfatizar que V{displaystyle V} es un espacio de función, que es una convención común en el análisis funcional. A veces el término función lineal tiene el mismo significado que mapa lineal, mientras que en análisis no lo hace.

Un mapa lineal de V a W siempre mapea el origen de V al origen de W. Además, asigna subespacios lineales en V a subespacios lineales en W (posiblemente de una dimensión inferior); por ejemplo, asigna un plano a través del origen en V a un plano a través del origen en W, una línea a través del origen en W, o simplemente el origen en W. Los mapas lineales a menudo se pueden representar como matrices, y los ejemplos simples incluyen transformaciones lineales de rotación y reflexión.

En el lenguaje de la teoría de categorías, los mapas lineales son los morfismos de los espacios vectoriales.

Definición y primeras consecuencias

Vamos V{displaystyle V} y W{displaystyle W. ser espacios vectoriales sobre el mismo campo K{displaystyle K}. Una función f:V→ → W{displaystyle f:Vto W} se dice que es un mapa lineal si para cualquier dos vectores u,v▪ ▪ V{textstyle mathbf {u}mathbf {v} in V} y cualquier escalar c▪ ▪ K{displaystyle cin K} las dos condiciones siguientes están satisfechas:

- Aditividad / operación de adición f()u+v)=f()u)+f()v){displaystyle f(mathbf {u} +mathbf {v})=f(mathbf {u})+f(mathbf {v})}

- Homogeneidad del grado 1 / operación de multiplicación de escalar f()cu)=cf()u){displaystyle f(cmathbf {u})=cf(mathbf {u})}

Por lo tanto, se dice que un mapa lineal preserva la operación. En otras palabras, no importa si el mapa lineal se aplica antes (los lados derechos de los ejemplos anteriores) o después (los lados izquierdos de los ejemplos) de las operaciones de suma y multiplicación escalar.

Por la asociación de la operación de adición denotó como +, para cualquier vector u1,...... ,un▪ ▪ V{textstyle mathbf {u} _{1},ldotsmathbf {u} _{n}in V} and scalars c1,...... ,cn▪ ▪ K,{textstyle c_{1},ldotsc_{n}in K,} la siguiente igualdad establece:

Denotar los elementos cero de los espacios vectoriales V{displaystyle V} y W{displaystyle W. por 0V{textstyle mathbf {0} y 0W{textstyle mathbf {0} respectivamente, sigue que f()0V)=0W.{textstyle f(mathbf {0} _{V})=mathbf {0} Vamos c=0{displaystyle c=0} y v▪ ▪ V{textstyle mathbf {v} in V} en la ecuación para la homogeneidad del grado 1:

Un mapa lineal V→ → K{displaystyle Vto K} con K{displaystyle K} visto como un espacio vectorial único sobre sí mismo se llama un funcional lineal.

Estas declaraciones se generalizan a cualquier módulo izquierdo RM{textstyle {fnK}M} sobre un anillo R{displaystyle R. sin modificación, y a cualquier modelo adecuado al invertir la multiplicación del escalar.

Ejemplos

- Un ejemplo prototípico que da mapas lineales su nombre es una función f:R→ → R:x↦ ↦ cx{displaystyle f:mathbb {R} to mathbb {R}:xmapsto cx}, del cual el gráfico es una línea a través del origen.

- Más generalmente, cualquier homothety v↦ ↦ cv{textstyle mathbf {v} mapsto cmathbf {v} Donde c{displaystyle c} centrado en el origen de un espacio vectorial es un mapa lineal.

- El mapa cero x↦ ↦ 0{textstyle mathbf {x} mapsto mathbf {0} entre dos espacios vectoriales (sobre el mismo campo) es lineal.

- El mapa de identidad en cualquier módulo es un operador lineal.

- Para números reales, el mapa x↦ ↦ x2{textstyle xmapsto x^{2} no es lineal.

- Para números reales, el mapa x↦ ↦ x+1{textstyle xmapsto x+1} no es lineal (pero es una transformación afinada).

- Si A{displaystyle A} es un m× × n{displaystyle mtimes n} matriz real, entonces A{displaystyle A} define un mapa lineal desde Rn{displaystyle mathbb {R} {} {}} {fn}} a Rm{displaystyle mathbb {R} {} {m} por enviar un vector de columna x▪ ▪ Rn{displaystyle mathbf {x} in mathbb {R} {fn} al vector de la columna Ax▪ ▪ Rm{displaystyle Amathbf {x} in mathbb {R} ^{m}. Por el contrario, cualquier mapa lineal entre espacios vectoriales finitos-dimensionales puede ser representado de esta manera; vea el § Matrices, abajo.

- Si f:V→ → W{textstyle f:Vto W} es una isometría entre los verdaderos espacios nórdicos tal que f()0)=0{textstyle f(0)=0} entonces f{displaystyle f} es un mapa lineal. Este resultado no es necesariamente cierto para el espacio complejo y ordenado.

- Diferenciación define un mapa lineal desde el espacio de todas las funciones diferenciables hasta el espacio de todas las funciones. También define un operador lineal en el espacio de todas las funciones suaves (un operador lineal es lineal endomorfismo, es decir, un mapa lineal con el mismo dominio y codomain). Un ejemplo es ddx()c1f1()x)+c2f2()x)+⋯ ⋯ +cnfn()x))=c1df1()x)dx+c2df2()x)dx+⋯ ⋯ +cndfn()x)dx.{displaystyle {frac {dx}left(c_{1}(x)+c_{2}f_{2}(x)+cdots {c_{n}(x)right)=c_{1}{1}{df_{1}(x)}{dx}+c_{2}{frac {2}(x)}{dx}+cdots ¿Qué?

- Una integral definida en algún intervalo I es un mapa lineal desde el espacio de todas las funciones integrables de valor real en I a R{displaystyle mathbb {R}. Por ejemplo, ∫ ∫ ab[c1f1()x)+c2f2()x)+⋯ ⋯ +cnfn()x)]dx=c1∫ ∫ abf1()x)dx+c2∫ ∫ abf2()x)dx+⋯ ⋯ +cn∫ ∫ abfn()x)dx.### {x}##########################################################################################################################################################################################################################################################

- Una integral indefinida (o antiderivativa) con un punto de partida de integración fijo define un mapa lineal desde el espacio de todas las funciones integradoras de valor real en R{displaystyle mathbb {R} al espacio de todas las funciones de valor real y diferenciables en R{displaystyle mathbb {R}. Sin un punto de partida fijo, los mapas antiderivativos al espacio cociente de las funciones diferenciables por el espacio lineal de funciones constantes.

- Si V{displaystyle V} y W{displaystyle W. son espacios vectoriales de dimensión finita sobre un campo F, de las dimensiones respectivas m y n, entonces la función que mapea mapas lineales f:V→ → W{textstyle f:Vto W} a n × m matrices en la forma descrita en § Matrices (bajo) es un mapa lineal, e incluso un isomorfismo lineal.

- El valor esperado de una variable aleatoria (que es de hecho una función, y como tal elemento de un espacio vectorial) es lineal, como para variables aleatorias X{displaystyle X} y Y{displaystyle Sí. tenemos E[X+Y]=E[X]+E[Y]{displaystyle E[X+Y]=E[X]+E[Y] y E[aX]=aE[X]{displaystyle E[aX]=aE[X]}, pero la variabilidad de una variable aleatoria no es lineal.

Extensiones lineales

A menudo, un mapa lineal se construye definiéndolo en un subconjunto de un espacio vectorial y luego extendiéndolo por linearidad al lazo lineal del dominio. A extensión lineal de una función f{displaystyle f} es una extensión de f{displaystyle f} a un espacio vectorial que es un mapa lineal.

Suppose X{displaystyle X} y Y{displaystyle Sí. son espacios vectoriales y f:S→ → Y{displaystyle f:Sto Sí. es una función definida en algún subconjunto S⊆ ⊆ X.{displaystyle Ssubseteq X.} Entonces... f{displaystyle f} se puede ampliar a un mapa lineal F:lapso S→ → Y{displaystyle F:operatorname {span} Sto Sí. si 0}" xmlns="http://www.w3.org/1998/Math/MathML">n■0{displaystyle n confiado0}0" aria-hidden="true" class="mwe-math-fallback-image-inline" src="https://wikimedia.org/api/rest_v1/media/math/render/svg/27a6a5d982d54202a14f111cb8a49210501b2c96" style="vertical-align: -0.338ex; width:5.656ex; height:2.176ex;"/> es un entero, c1,...... ,cn{displaystyle c_{1},ldotsc_{n} son escalares, y s1,...... ,sn▪ ▪ S{displaystyle s_{1},ldotss_{n}in S. son vectores tales que 0=c1s1+⋯ ⋯ +cnsn,{displaystyle 0=c_{1}s_{1}+cdots ¿Qué? entonces necesariamente 0=c1f()s1)+⋯ ⋯ +cnf()sn).{displaystyle 0=c_{1}fleft(s_{1}right)+cdots +c_{n}fleft(s_{n}right).} Si una extensión lineal f:S→ → Y{displaystyle f:Sto Sí. existe entonces la extensión lineal F:lapso S→ → Y{displaystyle F:operatorname {span} Sto Sí. es único y

Por ejemplo, si X=R2{displaystyle X=Mathbb {R} {2} y Y=R{displaystyle Y=Mathbb {R} entonces la asignación ()1,0)→ → − − 1{displaystyle (1,0)to -1} y ()0,1)→ → 2{displaystyle (0,1)to 2} se puede ampliar linealmente del conjunto linealmente independiente de vectores S:={}()1,0),()0,1)}{displaystyle S:={(1,0),(0,1)} a un mapa lineal en lapso {}()1,0),()0,1)}=R2.{displaystyle operatorname {span} {(1,0),(0,1)}=mathbb {R} ^{2}.} La extensión lineal única F:R2→ → R{displaystyle F:mathbb {R} {2}to mathbb {R} es el mapa que envía ()x,Sí.)=x()1,0)+Sí.()0,1)▪ ▪ R2{displaystyle (x,y)=x(1,0)+y(0,1)in mathbb {R} ^{2} a

Cada (valorado escalar) funcionamiento lineal f{displaystyle f} definido en un subespacio vectorial de un espacio vectorial real o complejo X{displaystyle X} tiene una extensión lineal a todos X.{displaystyle X.} De hecho, el teorema de extensión dominado Hahn-Banach garantiza incluso que cuando este funcional lineal f{displaystyle f} está dominado por algunos seminorm dado p:X→ → R{displaystyle p:Xto mathbb {R} (que significa que Silenciof()m)Silencio≤ ≤ p()m){displaystyle Silenciof(m) para todos m{displaystyle m} en el dominio de f{displaystyle f}) entonces existe una extensión lineal X{displaystyle X} que también está dominado p.{displaystyle p.}

Matrices

Si V{displaystyle V} y W{displaystyle W. son espacios vectoriales finitos y una base se define para cada espacio vectorial, entonces cada mapa lineal de V{displaystyle V} a W{displaystyle W. puede ser representado por una matriz. Esto es útil porque permite cálculos concretos. Las matrices dan ejemplos de mapas lineales: si A{displaystyle A} es un verdadero m× × n{displaystyle mtimes n} matriz, entonces f()x)=Ax{displaystyle f(mathbf {x})=Amathbf {x} describe un mapa lineal Rn→ → Rm{displaystyle mathbb {R}n}to mathbb {R} {m} (ver Espacio Euclideano).

Vamos {}v1,...... ,vn}{fnMicrosoft Sans Serif} ser una base para V{displaystyle V}. Entonces cada vector v▪ ▪ V{displaystyle mathbf {v} in V} está determinado por los coeficientes c1,...... ,cn{displaystyle c_{1},ldotsc_{n} sobre el terreno R{displaystyle mathbb {R}:

Si f:V→ → W{textstyle f:Vto W} es un mapa lineal,

que implica la función f es enteramente determinado por los vectores f()v1),...... ,f()vn){displaystyle f(mathbf {v} _{1}),ldotsf(mathbf {v} _{n})}. Ahora {}w1,...... ,wm}{displaystyle {mathbf {w} ¿Qué? ¿Qué? ser una base para W{displaystyle W.. Entonces podemos representar cada vector f()vj){displaystyle f(mathbf {v} {j})} como

Así, la función f{displaystyle f} está completamente determinado por los valores de aij{displaystyle a_{ij}. Si ponemos estos valores en un m× × n{displaystyle mtimes n} matriz M{displaystyle M}, entonces podemos utilizarlo convenientemente para calcular la salida vectorial f{displaystyle f} para cualquier vector en V{displaystyle V}. Para conseguir M{displaystyle M}, cada columna j{displaystyle j} de M{displaystyle M} es un vector

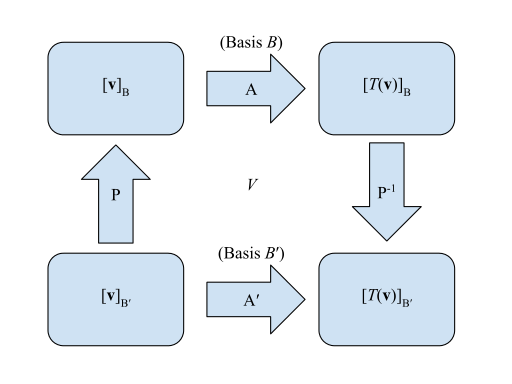

Las matrices de una transformación lineal se pueden representar visualmente:

- Matriz para T{textstyle T} relativa a B{textstyle B}: A{textstyle A}

- Matriz para T{textstyle T} relativa a B.{textstyle B'}: A.{textstyle A'}

- Matriz de transición B.{textstyle B'} a B{textstyle B}: P{textstyle P}

- Matriz de transición B{textstyle B} a B.{textstyle B'}: P− − 1{textstyle P^{-1}

Tal que comienza en la esquina inferior izquierda [v]B.{textstyle left[mathbf {v}right]_{B'} y buscando la esquina inferior derecha [T()v)]B.{textstyle left[Tleft(mathbf {v}right)right], uno se dejaría-multiplicadamente - es decir, A.[v]B.=[T()v)]B.{textstyle A'left[mathbf {v}right]_{B'}=left[Tleft(mathbf {v}right)right]_{B'}}. El método equivalente sería el método "peligro" que va en sentido de reloj desde el mismo punto tal que [v]B.{textstyle left[mathbf {v}right]_{B'} está multiplicado por la izquierda P− − 1AP{textstyle P^{-1}AP}, o P− − 1AP[v]B.=[T()v)]B.{textstyle ¿Por qué?.

Ejemplos en dos dimensiones

En el espacio bidimensional R2 los mapas lineales se describen mediante matrices de 2 × 2. Estos son algunos ejemplos:

- rotación

- por 90 grados a la derecha: A=()0− − 110){displaystyle mathbf {A} ={begin{pmatrix}0 sensible-11 paciente0end{pmatrix}}}

- por un ángulo Silencio en sentido contrario: A=()# Silencio Silencio − − pecado Silencio Silencio pecado Silencio Silencio # Silencio Silencio ){displaystyle mathbf {A} ={begin{pmatrix}cos theta &-sin theta \sin theta &cos theta end{pmatrix}}}

- por 90 grados a la derecha:

- reflexión

- a través de x axis: A=()100− − 1){displaystyle mathbf {A} ={begin{pmatrix}1 âTMa âTMa âTMa}}

- a través de Sí. axis: A=()− − 1001){displaystyle mathbf {A} ={begin{pmatrix}-1 implica0 simultáneamente1end{pmatrix}}}

- a través de una línea haciendo un ángulo Silencio con el origen: A=()# 2Silencio Silencio pecado 2Silencio Silencio pecado 2Silencio Silencio − − # 2Silencio Silencio ){displaystyle mathbf {A} ={begin{pmatrix}cos 2theta > sin 2theta\sin 2theta > 2theta end{pmatrix}}

- a través de x axis:

- escalando por 2 en todas direcciones: A=()2002)=2I{displaystyle mathbf {A}=2mathbf} {I}

- cartografía horizontal: A=()1m01){displaystyle mathbf {A} ={begin{pmatrix}1 sensiblem simultáneamente1end{pmatrix}}}

- mapeo de presión: A=()k001k){displaystyle mathbf {A} ={begin{pmatrix}k ventaja0 {1}end{pmatrix}}

- proyección sobre la Sí. axis: A=()0001).{displaystyle mathbf {A} ={begin{pmatrix}0 ventaja0 coincide1end{pmatrix}}}

Espacio vectorial de mapas lineales

La composición de los mapas lineales es lineal: si f:V→ → W{displaystyle f:Vto W} y g:W→ → Z{textstyle g:Wto Z} son lineales, entonces también su composición g∘ ∘ f:V→ → Z{textstyle gcirc f:Vto Z}. De esto se desprende que la clase de todos los espacios vectoriales sobre un campo dado K, junto con K- mapas lineales como morfismos, forma una categoría.

El inverso de un mapa lineal, cuando se define, es nuevamente un mapa lineal.

Si f1:V→ → W{textstyle F_{1}:Vto W. y f2:V→ → W{textstyle F_{2}:Vto W} son lineales, entonces así es su suma de sentido f1+f2{displaystyle F_{1}+f_{2}, que se define por ()f1+f2)()x)=f1()x)+f2()x){displaystyle (f_{1}+f_{2})(mathbf {x})=f_{1}(mathbf {x})+f_{2}(mathbf {x})}.

Si f:V→ → W{textstyle f:Vto W} es lineal y α α {textstyle alpha } es un elemento del campo terrestre K{textstyle K}, entonces el mapa α α f{textstyle alpha f}, definida por ()α α f)()x)=α α ()f()x)){textstyle (alpha f)(mathbf {x})=alpha (f(mathbf {x})}, también es lineal.

Así el conjunto L()V,W){textstyle {Mathcal {L}(V,W)} de mapas lineales de V{textstyle V} a W{textstyle W} forma un espacio vectorial sobre K{textstyle K}, a veces denotado Hom ()V,W){textstyle operatorname (V,W)}. Además, en el caso de que V=W{textstyle V=W}, este espacio vectorial, denotado Final ()V){textstyle operatorname {End} (V)}, es un álgebra asociativa bajo composición de mapas, ya que la composición de dos mapas lineales es de nuevo un mapa lineal, y la composición de mapas es siempre asociativa. Este caso se examina con más detalle a continuación.

Dado nuevamente el caso de dimensión finita, si se han elegido bases, entonces la composición de mapas lineales corresponde a la multiplicación de matrices, la suma de mapas lineales corresponde a la suma de matrices y la multiplicación de mapas lineales con escalares corresponde a la multiplicación de matrices con escalares.

Endomorfismos y automorfismos

Una transformación lineal f:V→ → V{textstyle f:Vto V} es un endomorfismo V{textstyle V}; el conjunto de todos estos endomorfismos Final ()V){textstyle operatorname {End} (V)} junto con la adición, composición y multiplicación de escalar tal como se define arriba formas un álgebra asociativa con elemento de identidad sobre el campo K{textstyle K} (y en particular un anillo). El elemento de identidad multiplicativo de este álgebra es el mapa de identidad id:V→ → V{textstyle operatorname V a V..

Un endomorfismo V{textstyle V} que es también un isomorfismo se llama automorfismo V{textstyle V}. La composición de dos automorfismos es otra vez un automorfismo, y el conjunto de todos los automorfismos V{textstyle V} forma un grupo, el grupo de automorfismo V{textstyle V} que se denota Aut ()V){textstyle operatorname (V)} o GL ()V){textstyle operatorname {GL} (V)}. Puesto que los automorfismos son precisamente aquellos endomorfismos que poseen inversos bajo composición, Aut ()V){textstyle operatorname (V)} es el grupo de unidades en el anillo Final ()V){textstyle operatorname {End} (V)}.

Si V{textstyle V} tiene dimensión finita n{textstyle n}, entonces Final ()V){textstyle operatorname {End} (V)} es isomorfo al álgebra asociativa de todos n× × n{textstyle ntimes n} matrices con entradas K{textstyle K}. El grupo de automorfismo V{textstyle V} es isomorfa al grupo lineal general GL ()n,K){textstyle operatorname {GL} (n,K)} de todos n× × n{textstyle ntimes n} matrices invertibles con entradas K{textstyle K}.

Kernel, imagen y el teorema de rango-nulidad

Si f:V→ → W{textstyle f:Vto W} es lineal, definimos el núcleo y la imagen o rango de f{textstyle f} por

ker ()f){textstyle ker(f)} es un subespacio V{textstyle V} y im ()f){textstyle operatorname {im} (f)} es un subespacio W{textstyle W}. La siguiente fórmula de dimensión se conoce como el teorema de rango anual:

El número dim ()im ()f)){textstyle dim(operatorname {im} (f)} también se llama el rango de f{textstyle f} y escrito como rango ()f){textstyle operatorname {rank} (f)}, o a veces, *** *** ()f){textstyle rho (f)}; el número dim ()ker ()f)){textstyle dim(ker(f)} se llama la nulidad de f{textstyle f} y escrito como nulo ()f){textstyle operatorname {null} (f)} o .. ()f){textstyle nu (f)}. Si V{textstyle V} y W{textstyle W} son finitos-dimensionales, bases han sido elegidas y f{textstyle f} está representado por la matriz A{textstyle A}, entonces el rango y la nulidad de f{textstyle f} son iguales al rango y la nulidad de la matriz A{textstyle A}, respectivamente.

Cokernel

Un invariante más sutil de una transformación lineal f:V→ → W{textstyle f:Vto W} es el cokernel, que se define como

Esta es la noción dual del núcleo: así como el núcleo es un subespacio del dominio, el co-núcleo es un espacio cociente del objetivo. Formalmente, uno tiene la secuencia exacta

Estos pueden interpretarse así: dada una ecuación lineal f(v) = w para resolver,

- el núcleo es el espacio de soluciones a la homogénea ecuación f()v) = 0, y su dimensión es el número de grados de libertad en el espacio de las soluciones, si no está vacía;

- el co-kernel es el espacio de limitaciones que las soluciones deben satisfacer, y su dimensión es el número máximo de limitaciones independientes.

La dimensión del co-kernel y la dimensión de la imagen (el rango) suman la dimensión del espacio de destino. Para dimensiones finitas, esto significa que la dimensión del espacio cociente W/f(V) es la dimensión del espacio objetivo menos la dimensión de la imagen

Como ejemplo simple, considere el mapa f: R2 → R2, dado por f()x, Sí.) = (0, Sí.). Entonces para una ecuación f()x, Sí.) =a, b) para tener una solución, debemos tener a = 0 (una limitación), y en ese caso el espacio de solución es (x, b) o equivalentemente declarado, (0, b) + (x, 0), (un grado de libertad). El núcleo puede ser expresado como el subespacio (x, 0) V: el valor de x es la libertad en una solución – mientras que el cokernel puede ser expresado a través del mapa W → R, ()a,b)↦ ↦ ()a){textstyle (a,b)mapsto (a)}: dado un vectora, b), el valor de a es obstrucción para que haya una solución.

Un ejemplo ilustrando el caso infinite-dimensional es proporcionado por el mapa f: RJUEGO → RJUEGO, {}an}↦ ↦ {}bn}{textstyle left{a_{n}derecha}mapsto ¿Qué? con b1 = 0 y bn + 1 = an para n ■ 0. Su imagen consiste en todas las secuencias con el primer elemento 0, y por lo tanto su cokernel consiste en las clases de secuencias con el primer elemento idéntico. Así, mientras que su núcleo tiene dimensión 0 (sólo mapea la secuencia cero a la secuencia cero), su co-carne tiene dimensión 1. Puesto que el dominio y el espacio objetivo son iguales, el rango y la dimensión del núcleo agregan a la misma suma que el rango y la dimensión del co-kernel (א א 0+0=א א 0+1{textstyle aleph ¿Qué? ¿Qué?), pero en el caso infinita-dimensional no se puede inferir que el núcleo y el co-carne de un endomorfismo tienen la misma dimensión (0 ≠1). La situación inversa obtiene para el mapa h: RJUEGO → RJUEGO, {}an}↦ ↦ {}cn}{textstyle left{a_{n}derecha}mapsto ¿Qué? con cn = an + 1. Su imagen es todo el espacio objetivo, y por lo tanto su co-quenel tiene dimensión 0, pero ya que mapea todas las secuencias en las que sólo el primer elemento no es cero a la secuencia cero, su núcleo tiene dimensión 1.

Índice

Para un operador lineal con núcleo y co-núcleo de dimensión finita, uno puede definir índice como:

Para una transformación entre espacios vectoriales de dimensión finita, esta es solo la diferencia dim(V) − dim(W), por rango-nulidad. Esto da una indicación de cuántas soluciones o cuántas restricciones tiene uno: si se mapea de un espacio más grande a uno más pequeño, el mapa puede estar sobre y, por lo tanto, tendrá grados de libertad incluso sin restricciones. Por el contrario, si se mapea de un espacio más pequeño a uno más grande, el mapa no puede ser sobre y, por lo tanto, uno tendrá restricciones incluso sin grados de libertad.

El índice de un operador es precisamente la característica de Euler del complejo de 2 términos 0 → V → W → 0. En la teoría de operadores, el índice de los operadores de Fredholm es un objeto de estudio, siendo un resultado importante el teorema del índice de Atiyah-Singer.

Clasificaciones algebraicas de transformaciones lineales

Ninguna clasificación de mapas lineales podría ser exhaustiva. La siguiente lista incompleta enumera algunas clasificaciones importantes que no requieren ninguna estructura adicional en el espacio vectorial.

Sea V y W denota espacios vectoriales sobre un campo F y deja T: V → W sea un mapa lineal.

Monomorfismo

T se dice que es inyectivo o un monomorfismo si cualquiera de las siguientes condiciones equivalentes es verdadera:

- T es uno a uno como un mapa de conjuntos.

- ker T = {0}V}

- dim(ker) T) = 0

- T es monic o de izquierda-cancelable, que es decir, para cualquier espacio vectorial U y cualquier par de mapas lineales R: U → V y S: U → V, la ecuación TR = TS implicación R = S.

- T es invertible izquierda, que es decir que existe un mapa lineal S: W → V tales que ST es el mapa de identidad en V.

Epimorfismo

T se dice que es sobreyectiva o un epimorfismo si cualquiera de las siguientes condiciones equivalentes es verdadera:

- T está en un mapa de conjuntos.

- coker T = {0}W}

- T es épico o bien-cancelable, que es decir, para cualquier espacio vectorial U y cualquier par de mapas lineales R: W → U y S: W → U, la ecuación RT = ST implicación R = S.

- T es derecho-invertible, que es decir que existe un mapa lineal S: W → V tales que TS es el mapa de identidad en W.

Isomorfismo

T se dice que es un isomorfismo si es invertible a la izquierda y a la derecha. Esto es equivalente a que T sea uno a uno y sobre (una biyección de conjuntos) o también a T siendo tanto épico como mónico, por lo que es un bimorfismo.

Si T: V → V es un endomorfismo, entonces:

- Si, por algún entero positivo n, el n- el itinerario T, Tn, es idéntico cero, entonces T se dice que es nilpotente.

- Si T2 = T, entonces T se dice que es idempotente

- Si T = kI, donde k es un escalar, entonces T se dice que es un mapa de transformación de escalar o multiplicación de escalar; vea la matriz de escalar.

Cambio de base

Dado un mapa lineal que es un endomorfismo cuya matriz es A, en la base B del espacio transforma las coordenadas vectoriales [u] como [v] = A[u]. Como los vectores cambian con el inverso de B (los vectores son contravariantes) su transformación inversa es [v] = B[v'].

Sustituyendo esto en la primera expresión

Por lo tanto, la matriz en la nueva base es A′ = B−1AB, siendo B la matriz de la base dada.

Por lo tanto, se dice que los mapas lineales son objetos 1-co- 1-contra-variante, o tensores de tipo (1, 1).

Continuidad

Una transformación lineal entre espacios vectoriales topológicos, por ejemplo espacios normados, puede ser continua. Si su dominio y codominio son iguales, entonces será un operador lineal continuo. Un operador lineal en un espacio lineal normado es continuo si y solo si está acotado, por ejemplo, cuando el dominio es de dimensión finita. Un dominio de dimensión infinita puede tener operadores lineales discontinuos.

Un ejemplo de una transformación lineal ilimitada, por lo tanto discontinua, es la diferenciación en el espacio de funciones suaves equipadas con la norma suprema (una función con valores pequeños puede tener una derivada con valores grandes, mientras que la derivada de 0 es 0). Para un ejemplo específico, sin(nx)/n converge a 0, pero su derivado cos(nx) no lo hace, por lo que la diferenciación no es continua en 0 (y por una variación de este argumento, no es continua en ninguna parte).

Aplicaciones

Una aplicación específica de los mapas lineales es para transformaciones geométricas, como las realizadas en gráficos por computadora, donde la traslación, rotación y escalado de objetos 2D o 3D se realiza mediante el uso de una matriz de transformación. Las asignaciones lineales también se utilizan como mecanismo para describir el cambio: por ejemplo, en cálculo corresponden a derivadas; o en relatividad, utilizado como un dispositivo para realizar un seguimiento de las transformaciones locales de los marcos de referencia.

Otra aplicación de estas transformaciones es la optimización del compilador de código de bucle anidado y la paralelización de técnicas de compilación.

Contenido relacionado

Monoide

Geometría algebraica

Mapa logístico

![{displaystyle int _{a}^{b}left[c_{1}f_{1}(x)+c_{2}f_{2}(x)+dots +c_{n}f_{n}(x)right],dx={c_{1}int _{a}^{b}f_{1}(x),dx}+c_{2}int _{a}^{b}f_{2}(x),dx+cdots +c_{n}int _{a}^{b}f_{n}(x),dx.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/233c25e8e032052dcb427f670e9d15e1edb7c528)

![{displaystyle E[X+Y]=E[X]+E[Y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ea2251900ec2b03db1d6f870336155a2a09ff7f1)

![{displaystyle E[aX]=aE[X]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3e34453ad80cdf674f4d15fab3e8096be81af79a)

![{textstyle left[mathbf {v} right]_{B'}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/38ce4e66d088a57d8adb2aadc461213818bc3220)

![{textstyle left[Tleft(mathbf {v} right)right]_{B'}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/954ce89644d8b424263ec4dac91becfb6672d931)

![{textstyle A'left[mathbf {v} right]_{B'}=left[Tleft(mathbf {v} right)right]_{B'}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d40bbccc105af68b575ef57b62b1e1943c478aaa)

![{textstyle P^{-1}APleft[mathbf {v} right]_{B'}=left[Tleft(mathbf {v} right)right]_{B'}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5c713b4830cf922213fe7907677ae35be5fffcfc)

![{displaystyle Bleft[v'right]=ABleft[u'right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c2855717373418c2c2134151c0d0f4d5957292f8)

![{displaystyle left[v'right]=B^{-1}ABleft[u'right]=A'left[u'right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/65eb8aa4babed0054fcf025303d23fd58309bf7e)