Compilador

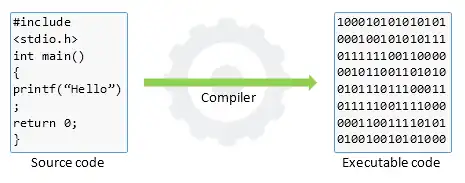

En informática, un compilador es un programa de computadora que traduce el código de computadora escrito en un lenguaje de programación (el idioma de origen) a otro idioma (el idioma de destino). El nombre "compilador" se usa principalmente para programas que traducen el código fuente de un lenguaje de programación de alto nivel a un lenguaje de nivel inferior (por ejemplo, lenguaje ensamblador, código objeto o código máquina) para crear un programa ejecutable.

Hay muchos tipos diferentes de compiladores que producen resultados en diferentes formas útiles. Un compilador cruzado produce código para una CPU o sistema operativo diferente al que se ejecuta en el compilador cruzado. Un compilador de arranque es a menudo un compilador temporal, que se usa para compilar un compilador más permanente o mejor optimizado para un lenguaje.

El software relacionado incluye, un programa que traduce de un lenguaje de bajo nivel a uno de nivel superior es un descompilador; un programa que traduce entre lenguajes de alto nivel, generalmente llamado compilador o transpilador de fuente a fuente. Un reescritor de idiomas suele ser un programa que traduce la forma de las expresiones sin cambiar de idioma. Un compilador-compilador es un compilador que produce un compilador (o parte de uno), a menudo de forma genérica y reutilizable para poder producir muchos compiladores diferentes.

Es probable que un compilador realice algunas o todas las siguientes operaciones, a menudo denominadas fases: preprocesamiento, análisis léxico, análisis sintáctico, análisis semántico (traducción dirigida por la sintaxis), conversión de programas de entrada a una representación intermedia, optimización de código y generación de código. Los compiladores generalmente implementan estas fases como componentes modulares, promoviendo un diseño eficiente y la corrección de las transformaciones de la entrada de origen a la salida de destino. Las fallas del programa causadas por el comportamiento incorrecto del compilador pueden ser muy difíciles de rastrear y solucionar; por lo tanto, los implementadores del compilador invierten un esfuerzo significativo para garantizar la corrección del compilador.

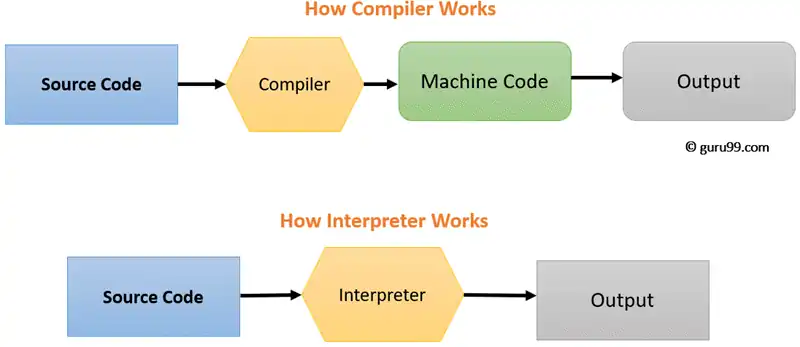

Los compiladores no son el único procesador de lenguaje que se utiliza para transformar los programas fuente. Un intérprete es un software de computadora que transforma y luego ejecuta las operaciones indicadas. El proceso de traducción influye en el diseño de los lenguajes informáticos, lo que conduce a una preferencia por la compilación o la interpretación. En teoría, un lenguaje de programación puede tener tanto un compilador como un intérprete. En la práctica, los lenguajes de programación tienden a asociarse con uno solo (un compilador o un intérprete).

Historia

Los conceptos teóricos de computación desarrollados por científicos, matemáticos e ingenieros formaron la base del desarrollo de la computación digital moderna durante la Segunda Guerra Mundial. Los lenguajes binarios primitivos evolucionaron porque los dispositivos digitales solo entienden unos y ceros y los patrones de circuito en la arquitectura de la máquina subyacente. A fines de la década de 1940, se crearon los lenguajes ensambladores para ofrecer una abstracción más viable de las arquitecturas informáticas. La capacidad de memoria limitada de las primeras computadoras generó desafíos técnicos sustanciales cuando se diseñaron los primeros compiladores. Por lo tanto, el proceso de compilación debía dividirse en varios programas pequeños. Los programas front-end producen los productos de análisis utilizados por los programas back-end para generar el código de destino. A medida que la tecnología informática proporcionaba más recursos,

Por lo general, es más productivo para un programador usar un lenguaje de alto nivel, por lo que el desarrollo de lenguajes de alto nivel siguió de manera natural a las capacidades que ofrecen las computadoras digitales. Los lenguajes de alto nivel son lenguajes formales que están estrictamente definidos por su sintaxis y semántica que forman la arquitectura del lenguaje de alto nivel. Los elementos de estos lenguajes formales incluyen:

- Alfabeto, cualquier conjunto finito de símbolos;

- String, una secuencia finita de símbolos;

- Idioma, cualquier conjunto de cadenas en un alfabeto.

Las oraciones en un idioma pueden estar definidas por un conjunto de reglas llamadas gramática.

La forma Backus-Naur (BNF) describe la sintaxis de las "oraciones" de un idioma y John Backus la utilizó para la sintaxis de Algol 60. Las ideas se derivan de los conceptos de gramática independiente del contexto de Noam Chomsky, un lingüista. "BNF y sus extensiones se han convertido en herramientas estándar para describir la sintaxis de las notaciones de programación y, en muchos casos, las partes de los compiladores se generan automáticamente a partir de una descripción BNF".

En la década de 1940, Konrad Zuse diseñó un lenguaje de programación algorítmico llamado Plankalkül ("Plan Calculus"). Si bien no se produjo una implementación real hasta la década de 1970, presentó conceptos vistos más tarde en APL diseñado por Ken Iverson a fines de la década de 1950. APL es un lenguaje para cálculos matemáticos.

El diseño de lenguajes de alto nivel durante los años de formación de la computación digital proporcionó herramientas de programación útiles para una variedad de aplicaciones:

- FORTRAN (traducción de fórmulas) para aplicaciones científicas y de ingeniería se considera el primer lenguaje de alto nivel.

- COBOL (Common Business-Oriented Language) evolucionó de A-0 y FLOW-MATIC para convertirse en el lenguaje de alto nivel dominante para aplicaciones comerciales.

- LISP (List Processor) para computación simbólica.

La tecnología de compilación evolucionó a partir de la necesidad de una transformación estrictamente definida del programa fuente de alto nivel en un programa objetivo de bajo nivel para la computadora digital. El compilador podría verse como un front-end para manejar el análisis del código fuente y un back-end para sintetizar el análisis en el código de destino. La optimización entre el front-end y el back-end podría producir un código de destino más eficiente.

Algunos hitos iniciales en el desarrollo de la tecnología de compilación:

- 1952: algunos consideran que un compilador Autocode desarrollado por Alick Glennie para la computadora Manchester Mark I en la Universidad de Manchester es el primer lenguaje de programación compilado.

- 1952: el equipo de Grace Hopper en Remington Rand escribió el compilador para el lenguaje de programación A-0 (y acuñó el término compilador para describirlo), aunque el compilador A-0 funcionó más como un cargador o enlazador que la noción moderna de un compilador completo..

- 1954-1957: un equipo dirigido por John Backus en IBM desarrolló FORTRAN, que generalmente se considera el primer lenguaje de alto nivel. En 1957, completaron un compilador FORTRAN al que generalmente se atribuye haber introducido el primer compilador inequívocamente completo.

- 1959: La Conferencia sobre Lenguaje de Sistemas de Datos (CODASYL) inició el desarrollo de COBOL. El diseño de COBOL se basó en A-0 y FLOW-MATIC. A principios de la década de 1960, COBOL se compiló en varias arquitecturas.

- 1958–1962: John McCarthy en el MIT diseñó LISP. Las capacidades de procesamiento de símbolos proporcionaron características útiles para la investigación de inteligencia artificial. En 1962, el lanzamiento de LISP 1.5 señaló algunas herramientas: un intérprete escrito por Stephen Russell y Daniel J. Edwards, un compilador y ensamblador escrito por Tim Hart y Mike Levin.

Los primeros sistemas operativos y software se escribieron en lenguaje ensamblador. En la década de 1960 y principios de la de 1970, el uso de lenguajes de alto nivel para la programación de sistemas aún era controvertido debido a las limitaciones de recursos. Sin embargo, varios esfuerzos de investigación e industria iniciaron el cambio hacia lenguajes de programación de sistemas de alto nivel, por ejemplo, BCPL, BLISS, B y C.

BCPL (Lenguaje de programación combinado básico), diseñado en 1966 por Martin Richards en la Universidad de Cambridge, se desarrolló originalmente como una herramienta de escritura de compiladores. Se han implementado varios compiladores, el libro de Richards proporciona información sobre el lenguaje y su compilador. BCPL no solo fue un lenguaje de programación de sistemas influyente que todavía se usa en la investigación, sino que también proporcionó una base para el diseño de lenguajes B y C.

BLISS (Lenguaje básico para la implementación del software del sistema) fue desarrollado para una computadora PDP-10 de Digital Equipment Corporation (DEC) por el equipo de investigación de la Universidad Carnegie Mellon (CMU) de WA Wulf. El equipo de CMU pasó a desarrollar el compilador BLISS-11 un año después, en 1970.

Multics (Multiplexed Information and Computing Service), un proyecto de sistema operativo de tiempo compartido, involucró al MIT, Bell Labs, General Electric (luego Honeywell) y fue dirigido por Fernando Corbató del MIT. Multics fue escrito en el lenguaje PL/I desarrollado por IBM e IBM User Group. El objetivo de IBM era satisfacer los requisitos comerciales, científicos y de programación de sistemas. Había otros lenguajes que podrían haberse considerado pero PL/I ofreció la solución más completa a pesar de que no se había implementado. Durante los primeros años del proyecto Multics, un subconjunto del lenguaje podría compilarse en lenguaje ensamblador con el compilador Early PL/I (EPL) de Doug McIlory y Bob Morris de Bell Labs.EPL apoyó el proyecto hasta que se pudo desarrollar un compilador de arranque para el PL/I completo.

Bell Labs abandonó el proyecto Multics en 1969 y desarrolló un lenguaje de programación de sistemas B basado en conceptos BCPL, escrito por Dennis Ritchie y Ken Thompson. Ritchie creó un compilador de arranque para B y escribió el sistema operativo Unics (Uniplexed Information and Computing Service) para un PDP-7 en B. Unics finalmente se deletreó Unix.

Bell Labs inició el desarrollo y expansión de C basado en B y BCPL. El compilador BCPL había sido transportado a Multics por Bell Labs y BCPL era un lenguaje preferido en Bell Labs. Inicialmente, se utilizó un programa frontal para el compilador B de Bell Labs mientras se desarrollaba un compilador C. En 1971, un nuevo PDP-11 proporcionó el recurso para definir extensiones a B y reescribir el compilador. En 1973, el diseño del lenguaje C estaba esencialmente completo y el kernel de Unix para un PDP-11 se reescribió en C. Steve Johnson comenzó el desarrollo de Portable C Compiler (PCC) para admitir la reorientación de los compiladores C a nuevas máquinas.

La programación orientada a objetos (POO) ofreció algunas posibilidades interesantes para el desarrollo y mantenimiento de aplicaciones. Los conceptos de programación orientada a objetos van más atrás, pero formaban parte de la ciencia del lenguaje LISP y Simula. En Bell Labs, el desarrollo de C++ se interesó en OOP. C++ se utilizó por primera vez en 1980 para la programación de sistemas. El diseño inicial aprovechó las capacidades de programación de sistemas de lenguaje C con conceptos de Simula. Las instalaciones orientadas a objetos se agregaron en 1983. El programa Cfront implementó un front-end C ++ para el compilador de lenguaje C84. En los años siguientes, se desarrollaron varios compiladores de C++ a medida que crecía la popularidad de C++.

En muchos dominios de aplicación, la idea de utilizar un lenguaje de nivel superior se popularizó rápidamente. Debido a la funcionalidad en expansión admitida por los lenguajes de programación más nuevos y la creciente complejidad de las arquitecturas informáticas, los compiladores se volvieron más complejos.

DARPA (Agencia de Proyectos de Investigación Avanzada de Defensa) patrocinó un proyecto de compilación con el equipo de investigación de CMU de Wulf en 1970. El diseño del compilador de calidad de producción-compilador PQCC produciría un compilador de calidad de producción (PQC) a partir de definiciones formales del lenguaje de origen y el objetivo. PQCC intentó extender el término compilador-compilador más allá del significado tradicional como generador de analizador (por ejemplo, Yacc) sin mucho éxito. PQCC podría denominarse más correctamente como un generador de compiladores.

La investigación de PQCC sobre el proceso de generación de código buscó construir un sistema de escritura de compilador verdaderamente automático. El esfuerzo descubrió y diseñó la estructura de fase del PQC. El compilador BLISS-11 proporcionó la estructura inicial. Las fases incluían análisis (front end), traducción intermedia a máquina virtual (middle end) y traducción al destino (back end). TCOL fue desarrollado para la investigación de PQCC para manejar construcciones específicas del lenguaje en la representación intermedia. Las variaciones de TCOL admiten varios idiomas. El proyecto PQCC investigó técnicas de construcción de compiladores automatizados. Los conceptos de diseño resultaron útiles para optimizar compiladores y compiladores para el lenguaje de programación Ada (desde 1995, orientado a objetos).

El documento de Ada STONEMAN formalizó el entorno de soporte del programa (APSE) junto con el núcleo (KAPSE) y mínimo (MAPSE). Un intérprete de Ada NYU/ED apoyó los esfuerzos de desarrollo y estandarización con el Instituto Nacional Estadounidense de Estándares (ANSI) y la Organización Internacional de Estándares (ISO). El desarrollo inicial del compilador Ada por parte de los Servicios Militares de EE. UU. incluyó los compiladores en un entorno de diseño integrado completo a lo largo de las líneas de STONEMANdocumento. El Ejército y la Marina trabajaron en el proyecto Ada Language System (ALS) dirigido a la arquitectura DEC/VAX, mientras que la Fuerza Aérea comenzó con el Ada Integrated Environment (AIE) dirigido a la serie IBM 370. Si bien los proyectos no proporcionaron los resultados deseados, contribuyeron al esfuerzo general en el desarrollo de Ada.

Otros esfuerzos de compilación de Ada comenzaron en Gran Bretaña en la Universidad de York y en Alemania en la Universidad de Karlsruhe. En los EE. UU., Verdix (posteriormente adquirida por Rational) entregó el Verdix Ada Development System (VADS) al Ejército. VADS proporcionó un conjunto de herramientas de desarrollo, incluido un compilador. Unix/VADS podría hospedarse en una variedad de plataformas Unix como DEC Ultrix y Sun 3/60 Solaris dirigido a Motorola 68020 en una evaluación de Army CECOM.Pronto hubo muchos compiladores de Ada disponibles que pasaron las pruebas de validación de Ada. El proyecto GNU de la Free Software Foundation desarrolló GNU Compiler Collection (GCC) que proporciona una capacidad central para admitir múltiples idiomas y objetivos. La versión de Ada GNAT es uno de los compiladores de Ada más utilizados. GNAT es gratuito pero también hay soporte comercial, por ejemplo, AdaCore, fue fundada en 1994 para proporcionar soluciones de software comercial para Ada. GNAT Pro incluye GNAT basado en GNU GCC con un conjunto de herramientas para proporcionar un entorno de desarrollo integrado.

Los lenguajes de alto nivel continuaron impulsando la investigación y el desarrollo de compiladores. Las áreas de enfoque incluyeron la optimización y la generación automática de código. Las tendencias en los lenguajes de programación y los entornos de desarrollo influyeron en la tecnología de los compiladores. Se incluyeron más compiladores en las distribuciones de lenguaje (PERL, Java Development Kit) y como componente de un IDE (VADS, Eclipse, Ada Pro). Creció la interrelación e interdependencia de las tecnologías. La llegada de los servicios web promovió el crecimiento de los lenguajes web y los lenguajes de secuencias de comandos. Los scripts se remontan a los primeros días de las interfaces de línea de comandos (CLI), donde el usuario podía ingresar comandos para que los ejecutara el sistema. Conceptos de shell de usuario desarrollados con lenguajes para escribir programas de shell. Los primeros diseños de Windows ofrecían una capacidad de programación por lotes simple. La transformación convencional de estas lenguas utilizaba un intérprete. Si bien no se usan ampliamente, se han escrito compiladores Bash y Batch. Más recientemente, los lenguajes interpretados sofisticados se convirtieron en parte del conjunto de herramientas de los desarrolladores. Los lenguajes de secuencias de comandos modernos incluyen PHP, Python, Ruby y Lua. (Lua se usa ampliamente en el desarrollo de juegos). Todos estos tienen soporte de intérprete y compilador.

"Cuando el campo de la compilación comenzó a fines de los años 50, su enfoque se limitaba a la traducción de programas de lenguaje de alto nivel a código de máquina... El campo del compilador está cada vez más entrelazado con otras disciplinas, incluida la arquitectura informática, los lenguajes de programación, los métodos formales, ingeniería de software y seguridad informática". El artículo "Investigación de compiladores: los próximos 50 años" señaló la importancia de los lenguajes orientados a objetos y Java. La seguridad y la computación paralela se mencionaron entre los futuros objetivos de investigación.

Construcción del compilador

Un compilador implementa una transformación formal de un programa fuente de alto nivel a un programa de destino de bajo nivel. El diseño del compilador puede definir una solución integral o abordar un subconjunto definido que interactúa con otras herramientas de compilación, por ejemplo, preprocesadores, ensambladores, enlazadores. Los requisitos de diseño incluyen interfaces rigurosamente definidas tanto internamente entre los componentes del compilador como externamente entre los conjuntos de herramientas de soporte.

En los primeros días, el enfoque adoptado para el diseño del compilador se vio directamente afectado por la complejidad del lenguaje informático que se iba a procesar, la experiencia de las personas que lo diseñaron y los recursos disponibles. Las limitaciones de recursos llevaron a la necesidad de pasar por el código fuente más de una vez.

Un compilador para un lenguaje relativamente simple escrito por una persona puede ser una sola pieza de software monolítica. Sin embargo, a medida que aumenta la complejidad del idioma de origen, el diseño puede dividirse en varias fases interdependientes. Las fases separadas proporcionan mejoras de diseño que centran el desarrollo en las funciones del proceso de compilación.

Compiladores de paso único frente a paso múltiple

La clasificación de compiladores por número de pases tiene su trasfondo en las limitaciones de recursos de hardware de las computadoras. La compilación implica realizar mucho trabajo y las primeras computadoras no tenían suficiente memoria para contener un programa que hiciera todo este trabajo. Por lo tanto, los compiladores se dividieron en programas más pequeños, cada uno de los cuales pasó por encima de la fuente (o alguna representación de la misma) realizando algunos de los análisis y traducciones requeridos.

La capacidad de compilar en un solo paso se ha visto clásicamente como un beneficio porque simplifica el trabajo de escribir un compilador y los compiladores de un solo paso generalmente realizan compilaciones más rápido que los compiladores de varios pasos. Por lo tanto, impulsado en parte por las limitaciones de recursos de los primeros sistemas, muchos de los primeros lenguajes se diseñaron específicamente para que pudieran compilarse en un solo paso (p. ej., Pascal).

En algunos casos, el diseño de una función de lenguaje puede requerir que un compilador realice más de una pasada sobre el código fuente. Por ejemplo, considere una declaración que aparece en la línea 20 de la fuente que afecta la traducción de una declaración que aparece en la línea 10. En este caso, el primer paso debe recopilar información sobre las declaraciones que aparecen después de las declaraciones que afectan, con la traducción real sucediendo durante un pase posterior.

La desventaja de compilar en un solo paso es que no es posible realizar muchas de las optimizaciones sofisticadas necesarias para generar código de alta calidad. Puede ser difícil contar exactamente cuántos pases hace un compilador de optimización. Por ejemplo, diferentes fases de optimización pueden analizar una expresión muchas veces pero solo analizar otra expresión una vez.

Dividir un compilador en pequeños programas es una técnica utilizada por investigadores interesados en producir compiladores comprobablemente correctos. Probar la corrección de un conjunto de pequeños programas a menudo requiere menos esfuerzo que probar la corrección de un programa equivalente más grande y único.

Estructura del compilador de tres etapas

diseño del compilador

diseño del compilador

Independientemente del número exacto de fases en el diseño del compilador, las fases se pueden asignar a una de tres etapas. Las etapas incluyen un extremo frontal, un extremo medio y un extremo posterior.

- El front-end escanea la entrada y verifica la sintaxis y la semántica de acuerdo con un idioma de origen específico. Para los lenguajes tipificados estáticamente, realiza la verificación de tipos mediante la recopilación de información de tipos. Si el programa de entrada es sintácticamente incorrecto o tiene un error de tipo, genera mensajes de error y/o advertencia, generalmente identificando la ubicación en el código fuente donde se detectó el problema; en algunos casos, el error real puede estar (mucho) antes en el programa. Los aspectos del front-end incluyen análisis léxico, análisis de sintaxis y análisis semántico. El extremo frontal transforma el programa de entrada en una representación intermedia (IR) para su posterior procesamiento por parte del extremo medio. Este IR suele ser una representación de nivel inferior del programa con respecto al código fuente.

- El extremo medio realiza optimizaciones en el IR que son independientes de la arquitectura de la CPU a la que se dirige. Esta independencia de código fuente/código de máquina está destinada a permitir que las optimizaciones genéricas se compartan entre versiones del compilador que admitan diferentes lenguajes y procesadores de destino. Ejemplos de optimizaciones intermedias son la eliminación de código inútil (eliminación de código muerto) o código inalcanzable (análisis de accesibilidad), descubrimiento y propagación de valores constantes (propagación constante), reubicación de la computación en un lugar ejecutado con menos frecuencia (p. ej., fuera de un bucle), o especialización de computación basada en el contexto, produciendo finalmente el IR "optimizado" que utiliza el back-end.

- El back-end toma el IR optimizado del medio. Puede realizar más análisis, transformaciones y optimizaciones que son específicas para la arquitectura de la CPU de destino. El back-end genera el código ensamblador dependiente del objetivo, realizando la asignación de registros en el proceso. El back-end realiza la programación de instrucciones, que reordena las instrucciones para mantener ocupadas las unidades de ejecución paralelas llenando las ranuras de retraso. Aunque la mayoría de los problemas de optimización son NP-difíciles, las técnicas heurísticas para resolverlos están bien desarrolladas y actualmente implementadas en compiladores de calidad de producción. Por lo general, la salida de un back-end es un código de máquina especializado para un procesador y sistema operativo en particular.

Este enfoque front-end/middle/back-end hace posible combinar front-end para diferentes lenguajes con back-end para diferentes CPU mientras se comparten las optimizaciones del middle-end. Ejemplos prácticos de este enfoque son GNU Compiler Collection, Clang (compilador C/C++ basado en LLVM) y Amsterdam Compiler Kit, que tienen múltiples front-end, optimizaciones compartidas y múltiples back-end.

Interfaz

El front-end analiza el código fuente para construir una representación interna del programa, llamada representación intermedia (IR). También administra la tabla de símbolos, una estructura de datos que asigna cada símbolo en el código fuente a la información asociada, como la ubicación, el tipo y el alcance.

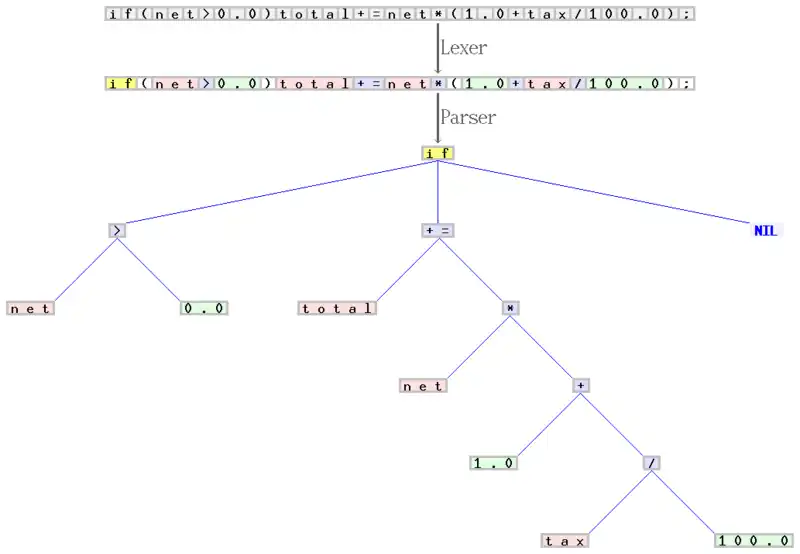

Si bien la interfaz puede ser una sola función o programa monolítico, como en un analizador sin escáner, tradicionalmente se implementó y analizó en varias fases, que pueden ejecutarse de forma secuencial o simultánea. Este método se ve favorecido por su modularidad y separación de preocupaciones. Más comúnmente hoy en día, la interfaz se divide en tres fases: análisis léxico (también conocido como lexing o escaneo), análisis de sintaxis (también conocido como escaneo o análisis) y análisis semántico. Lexing y parsing comprenden el análisis sintáctico (sintaxis de palabras y sintaxis de frases, respectivamente), y en casos simples, estos módulos (lexer y parser) pueden generarse automáticamente a partir de una gramática para el lenguaje, aunque en casos más complejos estos requieren modificación manual.. La gramática léxica y la gramática sintagmática suelen ser gramáticas libres de contexto, lo que simplifica significativamente el análisis, con la sensibilidad al contexto manejada en la fase de análisis semántico. La fase de análisis semántico es generalmente más compleja y está escrita a mano, pero puede automatizarse parcial o totalmente utilizando gramáticas de atributos. Estas fases en sí mismas se pueden dividir aún más: lexing como escanear y evaluar, y analizar sintácticamente como construir un árbol sintáctico concreto (CST, árbol sintáctico) y luego transformarlo en un árbol sintáctico abstracto (AST, árbol sintáctico). En algunos casos se utilizan fases adicionales, en particular y analizar como construir un árbol de sintaxis concreto (CST, árbol de análisis) y luego transformarlo en un árbol de sintaxis abstracto (AST, árbol de sintaxis). En algunos casos se utilizan fases adicionales, en particular y analizar como construir un árbol de sintaxis concreto (CST, árbol de análisis) y luego transformarlo en un árbol de sintaxis abstracto (AST, árbol de sintaxis). En algunos casos se utilizan fases adicionales, en particularreconstrucción de línea y preprocesamiento, pero estos son raros.

Las principales fases del front-end incluyen lo siguiente:

- La reconstrucción de línea convierte la secuencia de caracteres de entrada en una forma canónica lista para el analizador. Los idiomas que limitan sus palabras clave o permiten espacios arbitrarios dentro de los identificadores requieren esta fase. Los analizadores de arriba hacia abajo, descendientes recursivos y controlados por tablas que se usaban en la década de 1960 normalmente leían la fuente un carácter a la vez y no requerían una fase de tokenización separada. Atlas Autocode e Imp (y algunas implementaciones de ALGOL y Coral 66) son ejemplos de lenguajes cortados cuyos compiladores tendrían unafasede reconstrucción de línea

- El preprocesamiento admite la sustitución de macros y la compilación condicional. Normalmente, la fase de preprocesamiento se produce antes del análisis sintáctico o semántico; por ejemplo, en el caso de C, el preprocesador manipula tokens léxicos en lugar de formas sintácticas. Sin embargo, algunos lenguajes como Scheme admiten sustituciones de macros basadas en formas sintácticas.

- El análisis léxico (también conocido como lexing o tokenización) divide el texto del código fuente en una secuencia de pequeñas piezas llamadas tokens léxicos. Esta fase se puede dividir en dos etapas: la exploración, que segmenta el texto de entrada en unidades sintácticas llamadas lexemas y les asigna una categoría; y la evaluación, que convierte los lexemas en un valor procesado. Un token es un par que consta de un nombre de token y un valor de token opcional.Las categorías de tokens comunes pueden incluir identificadores, palabras clave, separadores, operadores, literales y comentarios, aunque el conjunto de categorías de tokens varía en diferentes lenguajes de programación. La sintaxis del lexema suele ser un lenguaje regular, por lo que se puede usar un autómata de estado finito construido a partir de una expresión regular para reconocerlo. El software que realiza el análisis léxico se denomina analizador léxico. Es posible que este no sea un paso separado: se puede combinar con el paso de análisis en el análisis sin escáner, en cuyo caso el análisis se realiza a nivel de carácter, no a nivel de token.

- El análisis de sintaxis (también conocido como parsing) implica analizar la secuencia del token para identificar la estructura sintáctica del programa. Esta fase generalmente construye un árbol de análisis, que reemplaza la secuencia lineal de tokens con una estructura de árbol construida de acuerdo con las reglas de una gramática formal que define la sintaxis del lenguaje. El árbol de análisis a menudo se analiza, aumenta y transforma en fases posteriores del compilador.

- El análisis semántico agrega información semántica al árbol de análisis y crea la tabla de símbolos. Esta fase realiza comprobaciones semánticas como la comprobación de tipos (comprobación de errores de tipo) o la vinculación de objetos (asociación de referencias de variables y funciones con sus definiciones) o asignación definitiva (requerir que todas las variables locales se inicialicen antes de su uso), rechazar programas incorrectos o emitir advertencias El análisis semántico generalmente requiere un árbol de análisis completo, lo que significa que esta fase sigue lógicamente a la fase de análisis y precede lógicamente a la fase de generación de código, aunque a menudo es posible plegar varias fases en una sola pasada sobre el código en una implementación del compilador.

Extremo medio

El extremo medio, también conocido como optimizador, realiza optimizaciones en la representación intermedia para mejorar el rendimiento y la calidad del código de máquina producido. El extremo medio contiene aquellas optimizaciones que son independientes de la arquitectura de la CPU a la que se dirige.

Las principales fases del término medio incluyen las siguientes:

- Análisis: Es la recopilación de información del programa a partir de la representación intermedia derivada de la entrada; El análisis de flujo de datos se utiliza para construir cadenas definidas por el uso, junto con análisis de dependencia, análisis de alias, análisis de puntero, análisis de escape, etc. El análisis preciso es la base para cualquier optimización del compilador. El gráfico de flujo de control de cada función compilada y el gráfico de llamadas del programa también se suelen construir durante la fase de análisis.

- Optimización: la representación del lenguaje intermedio se transforma en formas funcionalmente equivalentes pero más rápidas (o más pequeñas). Las optimizaciones populares son la expansión en línea, la eliminación de código muerto, la propagación constante, la transformación de bucles e incluso la paralelización automática.

El análisis del compilador es el requisito previo para cualquier optimización del compilador, y funcionan estrechamente juntos. Por ejemplo, el análisis de dependencia es crucial para la transformación de bucles.

El alcance del análisis y las optimizaciones del compilador varía mucho; su alcance puede variar desde operar dentro de un bloque básico, hasta procedimientos completos, o incluso todo el programa. Existe un compromiso entre la granularidad de las optimizaciones y el costo de la compilación. Por ejemplo, las optimizaciones de mirilla son rápidas de realizar durante la compilación, pero solo afectan a un pequeño fragmento local del código y se pueden realizar independientemente del contexto en el que aparece el fragmento de código. Por el contrario, la optimización interprocedimiento requiere más tiempo de compilación y espacio de memoria, pero permite optimizaciones que solo son posibles al considerar el comportamiento de múltiples funciones simultáneamente.

El análisis y las optimizaciones entre procedimientos son comunes en los compiladores comerciales modernos de HP, IBM, SGI, Intel, Microsoft y Sun Microsystems. El software libre GCC fue criticado durante mucho tiempo por carecer de potentes optimizaciones interprocedimiento, pero está cambiando a este respecto. Otro compilador de código abierto con una infraestructura completa de análisis y optimización es Open64, que utilizan muchas organizaciones con fines comerciales y de investigación.

Debido al tiempo y espacio adicionales necesarios para el análisis y las optimizaciones del compilador, algunos compiladores los omiten de manera predeterminada. Los usuarios deben usar las opciones de compilación para decirle explícitamente al compilador qué optimizaciones deben habilitarse.

Back-end

El back-end es responsable de las optimizaciones específicas de la arquitectura de la CPU y de la generación de código .

Las principales fases del back-end incluyen lo siguiente:

- Optimizaciones dependientes de la máquina: optimizaciones que dependen de los detalles de la arquitectura de la CPU a la que se dirige el compilador. Un ejemplo destacado son las optimizaciones de mirilla, que reescribe secuencias cortas de instrucciones del ensamblador en instrucciones más eficientes.

- Generación de código: el lenguaje intermedio transformado se traduce al lenguaje de salida, generalmente el lenguaje máquina nativo del sistema. Esto implica decisiones de recursos y almacenamiento, como decidir qué variables caben en los registros y la memoria y la selección y programación de las instrucciones de máquina apropiadas junto con sus modos de direccionamiento asociados (consulte también el algoritmo de Sethi-Ullman). Es posible que también sea necesario generar datos de depuración para facilitar la depuración.

Corrección del compilador

La corrección del compilador es la rama de la ingeniería de software que se ocupa de tratar de demostrar que un compilador se comporta de acuerdo con la especificación de su lenguaje. Las técnicas incluyen el desarrollo del compilador utilizando métodos formales y el uso de pruebas rigurosas (a menudo llamadas validación del compilador) en un compilador existente.

Lenguajes compilados versus interpretados

Los lenguajes de programación de alto nivel suelen aparecer con un tipo de traducción en mente: ya sea diseñado como lenguaje compilado o como lenguaje interpretado. Sin embargo, en la práctica, rara vez hay algo sobre un lenguaje que requiera que se compile o interprete exclusivamente, aunque es posible diseñar lenguajes que se basen en la reinterpretación en tiempo de ejecución. La categorización generalmente refleja las implementaciones más populares o extendidas de un lenguaje; por ejemplo, BASIC a veces se denomina lenguaje interpretado y C compilado, a pesar de la existencia de compiladores BASIC e intérpretes C.

La interpretación no reemplaza completamente la compilación. Solo lo oculta al usuario y lo hace gradual. Aunque un intérprete puede interpretarse a sí mismo, se necesita un programa ejecutado directamente en algún lugar en la parte inferior de la pila de ejecución (ver lenguaje de máquina).

Además, para la optimización, los compiladores pueden contener funciones de interpretación, y los intérpretes pueden incluir técnicas de compilación anticipadas. Por ejemplo, cuando se puede ejecutar una expresión durante la compilación y los resultados se pueden insertar en el programa de salida, evita que se tenga que volver a calcular cada vez que se ejecuta el programa, lo que puede acelerar en gran medida el programa final. Las tendencias modernas hacia la compilación justo a tiempo y la interpretación de códigos de bytes a veces desdibujan aún más las categorizaciones tradicionales de compiladores e intérpretes.

Algunas especificaciones del lenguaje explican que las implementaciones deben incluir una función de compilación; por ejemplo, Common Lisp. Sin embargo, no hay nada inherente en la definición de Common Lisp que impida que se interprete. Otros lenguajes tienen características que son muy fáciles de implementar en un intérprete, pero que hacen que escribir un compilador sea mucho más difícil; por ejemplo, APL, SNOBOL4 y muchos lenguajes de secuencias de comandos permiten que los programas construyan código fuente arbitrario en tiempo de ejecución con operaciones regulares de cadenas y luego ejecutan ese código pasándolo a una función de evaluación especial. Para implementar estas funciones en un lenguaje compilado, los programas generalmente deben enviarse con una biblioteca de tiempo de ejecución que incluya una versión del propio compilador.

Tipos

Una clasificación de los compiladores es por la plataforma en la que se ejecuta su código generado. Esto se conoce como la plataforma de destino.

Un compilador nativo o alojado es aquel cuya salida está destinada a ejecutarse directamente en el mismo tipo de computadora y sistema operativo en el que se ejecuta el compilador. La salida de un compilador cruzado está diseñada para ejecutarse en una plataforma diferente. Los compiladores cruzados se utilizan a menudo cuando se desarrolla software para sistemas integrados que no están destinados a admitir un entorno de desarrollo de software.

La salida de un compilador que produce código para una máquina virtual (VM) puede o no ejecutarse en la misma plataforma que el compilador que lo produjo. Por esta razón, dichos compiladores no suelen clasificarse como compiladores nativos o cruzados.

El lenguaje de nivel inferior que es el objetivo de un compilador puede ser en sí mismo un lenguaje de programación de alto nivel. C, visto por algunos como una especie de lenguaje ensamblador portátil, es frecuentemente el lenguaje de destino de dichos compiladores. Por ejemplo, Cfront, el compilador original de C++, usó C como lenguaje de destino. El código C generado por un compilador de este tipo generalmente no está destinado a ser legible y mantenido por humanos, por lo que se ignoran el estilo de sangría y la creación de un código intermedio C bonito. Algunas de las características de C que lo convierten en un buen lenguaje de destino incluyen la #linedirectiva, que puede generar el compilador para admitir la depuración de la fuente original, y el amplio soporte de plataforma disponible con los compiladores de C.

Si bien un tipo de compilador común genera código de máquina, hay muchos otros tipos:

- Los compiladores fuente a fuente son un tipo de compilador que toma un lenguaje de alto nivel como entrada y genera un lenguaje de alto nivel. Por ejemplo, un compilador de paralelismo automático con frecuencia tomará un programa de lenguaje de alto nivel como entrada y luego transformará el código y lo anotará con anotaciones de código paralelo (por ejemplo, OpenMP) o construcciones de lenguaje (por ejemplo,

DOALLdeclaraciones de Fortran). Otros términos para los compiladores fuente a fuente son traductor de idiomas, convertidor de idiomas o reescritor de idiomas. El último término suele aplicarse a traducciones que no implican un cambio de idioma. - Los compiladores de bytecode compilan en lenguaje ensamblador de una máquina teórica, como algunas implementaciones de Prolog

- Esta máquina Prolog también se conoce como Warren Abstract Machine (o WAM).

- Los compiladores de código de bytes para Java, Python también son ejemplos de esta categoría.

- Los compiladores justo a tiempo (compilador JIT) difieren la compilación hasta el tiempo de ejecución. Los compiladores JIT existen para muchos lenguajes modernos, incluidos Python, JavaScript, Smalltalk, Java, Common Intermediate Language (CIL) de Microsoft.NET y otros. Un compilador JIT generalmente se ejecuta dentro de un intérprete. Cuando el intérprete detecta que una ruta de código es "caliente", lo que significa que se ejecuta con frecuencia, se invocará el compilador JIT y compilará el código "caliente" para un mayor rendimiento.

- Para algunos lenguajes, como Java, las aplicaciones primero se compilan usando un compilador de código de bytes y se entregan en una representación intermedia independiente de la máquina. Un intérprete de código de bytes ejecuta el código de bytes, pero el compilador JIT traducirá el código de bytes a código de máquina cuando sea necesario un mayor rendimiento.

- Los compiladores de hardware (también conocidos como herramientas de síntesis) son compiladores cuya entrada es un lenguaje de descripción de hardware y cuya salida es una descripción, en forma de netlist o de otra forma, de una configuración de hardware.

- La salida de estos compiladores apunta al hardware de la computadora a un nivel muy bajo, por ejemplo, una matriz de puertas programables en campo (FPGA) o un circuito integrado estructurado específico de la aplicación (ASIC). Se dice que estos compiladores son compiladores de hardware porque el código fuente que compilan controla efectivamente la configuración final del hardware y cómo funciona. La salida de la compilación es solo una interconexión de transistores o tablas de búsqueda.

- Un ejemplo de compilador de hardware es XST, la herramienta de síntesis de Xilinx utilizada para configurar FPGA. Hay herramientas similares disponibles de Altera, Synplicity, Synopsys y otros proveedores de hardware.

- Un ensamblador es un programa que compila lenguaje ensamblador legible por humanos en código de máquina, las instrucciones reales ejecutadas por hardware. El programa inverso que traduce el código máquina a lenguaje ensamblador se llama desensamblador.

- Un programa que traduce de un lenguaje de bajo nivel a uno de mayor nivel es un descompilador.

- Un programa que se traduce a un formato de código de objeto que no es compatible con la máquina de compilación se denomina compilador cruzado y se usa comúnmente para preparar código para aplicaciones integradas.

- Un programa que reescribe el código objeto en el mismo tipo de código objeto mientras aplica optimizaciones y transformaciones es un recompilador binario.

Contenido relacionado

SPARC

Procesador superescalar

Extensión de nombre de archivo