Coeficiente de correlación de rango de Spearman

En las estadísticas, Coeficiente de correlación de rango de Spearman o Spearman's ***, nombrado por Charles Spearman y a menudo denotado por la carta griega *** *** {displaystyle rho } (rho) or as rs{displaystyle R_{s}, es una medida no paramétrica de correlación de rango (dependencia estadística entre los rankings de dos variables). Evalua cuan bien puede describirse la relación entre dos variables usando una función monotónica.

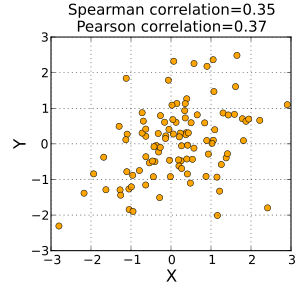

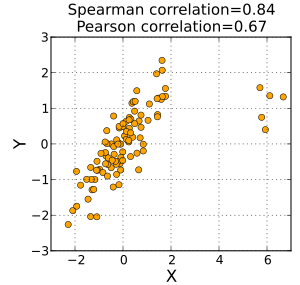

La correlación de Spearman entre dos variables es igual a la correlación de Pearson entre los valores de rango de esas dos variables; mientras que la correlación de Pearson evalúa relaciones lineales, la correlación de Spearman evalúa relaciones monótonas (ya sean lineales o no). Si no hay valores de datos repetidos, se produce una correlación de Spearman perfecta de +1 o −1 cuando cada una de las variables es una función monótona perfecta de la otra.

Intuitivamente, la correlación de Spearman entre dos variables será alta cuando las observaciones tengan un rango similar (o idéntico para una correlación de 1) (es decir, etiqueta de posición relativa de las observaciones dentro de la variable: 1.°, 2.°, 3.°, etc.) entre las dos variables, y bajo cuando las observaciones tienen un rango diferente (o completamente opuesto para una correlación de −1) entre las dos variables.

El coeficiente de Spearman es adecuado tanto para variables ordinal continuas como discretas. Ambos Spearman *** *** {displaystyle rho } y Kendall's τ τ {displaystyle tau } se puede formular como casos especiales de un coeficiente de correlación más general.

Definición y cálculo

El coeficiente de correlación de Spearman se define como el coeficiente de correlación de Pearson entre las variables de rango.

Para una muestra de tamaño n, el n partituras Xi,Yi{displaystyle X_{i},Y_{i} se convierten en filas R ()Xi),R ()Yi){displaystyle operatorname {R} ({X_{i}), nombre del operador {R} {Y_{i}}}, y rs{displaystyle R_{s} es calculado como

- rs=*** *** R ()X),R ()Y)=cov ()R ()X),R ()Y))σ σ R ()X)σ σ R ()Y),{displaystyle r_{s}=rho ################################################################################################################################################################################################################################################################ {R} (X),operatorname {R} (Y)}={frac {operatorname (operatorname {R} (X),operatorname {R} (Y)}{sigma _{operatorname {R} (X)}sigma ################################################################################################################################################################################################################################################################ {R} (Y)}}}}

dónde

- *** *** {displaystyle rho } denota el coeficiente habitual de correlación de Pearson, pero aplicado a las variables de rango,

- cov ()R ()X),R ()Y)){displaystyle operatorname {cov} (operatorname {R} (X),operatorname {R} (Y)} es la covariancia de las variables de rango,

- σ σ R ()X){displaystyle sigma _{operatorname {R} (X)}} y σ σ R ()Y){displaystyle sigma _{operatorname {R} (Y)}} son las desviaciones estándar de las variables de rango.

Solo si todos los n rangos son enteros distintos, se puede calcular usando la fórmula popular

- rs=1− − 6.. di2n()n2− − 1),{displaystyle ¿Qué?

dónde

- di=R ()Xi)− − R ()Yi){displaystyle ♪♪{i}=operatorname [R] (X_{i})-operatorname {R} (Y_{i})} es la diferencia entre las dos filas de cada observación,

- n es el número de observaciones.

Considere una muestra bivariada ()xi,Sí.i),i=1...... ,n{displaystyle (x_{i},y_{i}),,i=1dotsn} con rangos correspondientes ()R()Xi),R()Yi))=()Ri,Si){displaystyle (R(X_{i}),R(Y_{i})=(R_{i},S_{i})}. Luego el coeficiente de correlación de Spearman x,Sí.{displaystyle x,y} es

- rs=1n.. i=1nRiSi− − R̄ ̄ S̄ ̄ σ σ Rσ σ S,{displaystyle ¿Qué? ¿Por qué? {R},{overline {S}{sigma _{R}sigma ♪♪

donde, como siempre, R̄ ̄ =1n.. i=1nRi{displaystyle {fn}fn}fn}textstyle {fn}textstyle sum ¿Qué?, S̄ ̄ =1n.. i=1nSi{displaystyle {fn}fn}=textstyle {fn}textstyle sum ¿Qué?, σ σ R2=1n.. i=1n()Ri− − R̄ ̄ )2{displaystyle sigma - ¿Qué? {fn}}, y σ σ S2=1n.. i=1n()Si− − S̄ ̄ )2{displaystyle sigma ¿Por qué?,

Demostraremos que rs{displaystyle R_{s} puede expresarse únicamente en términos de di:=Ri− − Si{displaystyle ♪♪, siempre que supongamos que no hay vínculos dentro de cada muestra.

En este supuesto, tenemos que R,S{displaystyle R,S} se puede ver como variables aleatorias distribuidos como una variable aleatoria distribuida uniformemente, U{displaystyle U}, en {}1,2,...... ,n}{displaystyle {1,2,ldotsn}. Por lo tanto R̄ ̄ =S̄ ̄ =E[U]{displaystyle {fnMicrosoft}={fnMicrosoft Sans Serif} {S}=Mathbb [E] [U]y σ σ R2=σ σ S2=Var()U)=E[U2]− − E[U]2{displaystyle sigma ¿Qué? ¿Qué? {Var} (U)=Mathbb [E] [U^{2]]-mathbb {E}, Donde E[U]=1n.. i=1ni=()n+1)2{displaystyle mathbb [E]=textstyle {frac {1}{n}textstyle sum ¿Por qué?, E[U2]=1n.. i=1ni2=()n+1)()2n+1)6{displaystyle mathbb {E} [U^{2}]=textstyle {frac {1}{n}textstyle sum _{i=1}^{n}i^{2}=textstyle {frac {(n+1) {2n+1)}{6}}}}} {}}}}} {}}}}}}}} {f}}}}}}} {f}} {}}}}}}} {}}}}}}}}}}}} {}}}}}}}}}}} {}}}}}}} {}}}}}}}}} {}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}} {}}}}}}}}}}}}}}}} {}}}}}}}}}}}}}} {}}}}}}}}}}}}}} {}}}}}}}}}}}} {, y así Var()U)=()n+1)()2n+1)6− − ()()n+1)2)2=n2− − 112{displaystyle mathrm {Var} (U)=textstyle {frac {n+1)(2n+1)}{6}}}}-left(textstyle {frac {n+1)}right)}{2}=textstyle {frac {frac {n^{2}-1}}}}}}}}}}}}}}}}}}}} {. (Estas sumas se pueden calcular utilizando las fórmulas para el número triangular y el número pirámide cuadrado, o resultado básico de la suma de las matemáticas discretas.)

Observe ahora que

- 1n.. i=1nRiSi− − R̄ ̄ S̄ ̄ =1n.. i=1n12()Ri2+Si2− − di2)− − R̄ ̄ 2=121n.. i=1nRi2+121n.. i=1nSi2− − 12n.. i=1ndi2− − R̄ ̄ 2=()1n.. i=1nRi2− − R̄ ̄ 2)− − 12n.. i=1ndi2=σ σ R2− − 12n.. i=1ndi2=σ σ Rσ σ S− − 12n.. i=1ndi2{displaystyle {begin{aligned}{frac {1}{n}sum} ¿Por qué? {R}{overline {fn} {fn}} {fn}} {fn}}} {fn} {fn}}}} {fn}}}}}} {fn}}}}}} {fn}}} {fn}}}} {fn}}}}}}} {fn}}}}}}}}}}}}}}}}}}}}} {s}}}}}} {s}}}}}}}}}}}}}}}}}}}}} {s}}}}}}}}}}}} {s}}}}}}}}}}}}}}}}}}}}} {s}}}}}}}}}}}}}}}}}}}}}}}}}} {s}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}} - ¿Qué? {1}{2} {2} {2}}} {c} {fnK} {2}}} {fnun})-{fnunci} {R}{2}\\\fn}\fn}\\\fnh}\\\\\\fn}\\\\\fn}\\\\\\fnh}\\\\\\fn}\\\\\\fn}\\\\\fn}\\\fn}fn}\\\\fn}\\fn}\\\\\\\\fn}\\\\\\\fn}\\fn}\\fn}\\fn}\\fn}fn}fn}fn}\\\\\\\\\\fn {1}{2}{frac {1}{n}sum ¿Por qué? {1}{2}{frac {1}{n}sum ¿Qué? {1}{2n}sum} ¿Qué? {R} {2}\fn}s}s}s} {fn} {fn} {fn}fn} {fn} {fn}}}fn}fn} {fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}c}c}c}fn}fn}fn}fn}\\\c}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}fn}c}fn}c}fn}c}fn} ¿Qué? {R}}{2}-{frac} {1}{2n}sum} ¿Por qué? ¿Qué? {1}{2n}sum} ¿Por qué? _{R}sigma ¿Qué? {1}{2n}sum} ¿Por qué?

Poner todo esto juntos así rinde

- rs=σ σ Rσ σ S− − 12n.. i=1ndi2σ σ Rσ σ S=1− − .. i=1ndi22n⋅ ⋅ n2− − 112=1− − 6.. i=1ndi2n()n2− − 1).{displaystyle r_{s}={frac {sigma _{R}sigma ¿Qué? {1}{2n}sum {fn} {fn} {fn}} {fn}} {fn}} {fn}} {fn}} {fn}} {fn}}}}} {fn}}} {fn}}} {fn}}} {fn}}}} {fnfn}}}}}}}}} {\fn}}}}}\\\\\\\\\\fn}}}}}}\\\\\\\\\\\fn}}}}}}}}}}}}}}}}}}}}}}}}}}}}}\\\\\\\\\fn}}}}}}}}}}}}}}}}}}}}}}}}}\\\\\\\\\ _{R}sigma ¿Qué? {cncdot {fn}{2}}}=1-{fnfnfn} {fnfn}} {fnfnfnfnfnfnfnfnfn}}}}=1- {fnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnKfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfnfn - ¿Qué?

Normalmente, a los valores idénticos se les asignan rangos fraccionarios iguales al promedio de sus posiciones en el orden ascendente de los valores, lo que equivale a promediar todas las permutaciones posibles.

Si los lazos están presentes en el conjunto de datos, la fórmula simplificada anterior produce resultados incorrectos: Sólo si en ambas variables todas las filas son distintas, entonces σ σ R ()X)σ σ R ()Y)=Var ()R ()X))=Var ()R ()Y))=()n2− − 1)/12{displaystyle sigma _{operatorname {R} (X)}sigma ################################################################################################################################################################################################################################################################ [R] (Y)}=operatorname {fnMicrosoft Sans Serif} {fnMicrosoft Sans Serif} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {f} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft}fnMicrosoft}fnMicrosoft}fnMicrosoft}fnMicrosoft} {fnMicrosoft}fnMicrosoft}fnMicrosoft}f}fnMicrosoft}fnMicrosoft} {fnMicrosoft}}f}fnMicrosoft}fnMicrosoft {fnMicrosoft} {fn}fnMicrosoft}fnMicrosoft {fnMicrosoft {fnMicrosoft {R} (X)}=nombre del operador {fnMicrosoft Sans Serif} {fnMicrosoft Sans Serif} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft} {f} {fnMicrosoft} {fnMicrosoft} {fnMicrosoft}fnMicrosoft}fnMicrosoft}fnMicrosoft}fnMicrosoft} {fnMicrosoft}fnMicrosoft}fnMicrosoft}f}fnMicrosoft}fnMicrosoft} {fnMicrosoft}}f}fnMicrosoft}fnMicrosoft {fnMicrosoft} {fn}fnMicrosoft}fnMicrosoft {fnMicrosoft {fnMicrosoft {R} (Y)}=(n^{2}-1)/12} (calculado según varianza sesgada). La primera ecuación, normalizada por la desviación estándar, puede utilizarse incluso cuando las filas se normalizan a [0, 1] ("clas relativas") porque es insensible tanto a la traducción como al escalado lineal.

El método simplificado tampoco debe utilizarse en los casos en que el conjunto de datos esté truncado; es decir, cuando se desea el coeficiente de correlación de Spearman para los registros X principales (ya sea por rango previo al cambio o posterior al cambio, o ambos), el usuario debe usar la correlación de Pearson. fórmula del coeficiente dada anteriormente.

Cantidades relacionadas

Hay varias otras medidas numéricas que cuantifican el grado de dependencia estadística entre pares de observaciones. El más común de estos es el coeficiente de correlación producto-momento de Pearson, que es un método de correlación similar al rango de Spearman, que mide las relaciones "lineales" entre los números sin procesar en lugar de entre sus rangos.

Un nombre alternativo para la correlación de rango de Spearman es "correlación de grado"; en este, el "rango" de una observación se reemplaza por el "grado". En distribuciones continuas, el grado de una observación es, por convención, siempre la mitad menos que el rango y, por lo tanto, las correlaciones de grado y rango son las mismas en este caso. De manera más general, el "grado" de una observación es proporcional a una estimación de la fracción de una población menor que un valor dado, con el ajuste de la mitad de la observación en los valores observados. Así, esto corresponde a un posible tratamiento de los rangos empatados. Si bien es inusual, el término "correlación de grado" todavía se usa.

Interpretación

El signo de la correlación de Spearman indica la dirección de asociación entre X (la variable independiente) e Y (la variable dependiente). Si Y tiende a aumentar cuando aumenta X, el coeficiente de correlación de Spearman es positivo. Si Y tiende a disminuir cuando X aumenta, el coeficiente de correlación de Spearman es negativo. Una correlación de Spearman de cero indica que no hay tendencia a que Y aumente o disminuya cuando X aumenta. La correlación de Spearman aumenta en magnitud a medida que X e Y se acercan más a ser funciones perfectamente monótonas entre sí. Cuando X y Y están perfectamente monótonamente relacionados, el coeficiente de correlación de Spearman se convierte en 1. Una relación creciente perfectamente monótona implica que para dos pares cualesquiera de valores de datos Xi, Yi y Xj, Y j, que Xi − Xj y Yi − Yj siempre tienen el mismo signo. Una relación decreciente perfectamente monótona implica que estas diferencias siempre tienen signos opuestos.

El coeficiente de correlación de Spearman a menudo se describe como "no paramétrico". Esto puede tener dos significados. Primero, una correlación de Spearman perfecta resulta cuando X e Y están relacionados por cualquier función monótona. Compare esto con la correlación de Pearson, que solo da un valor perfecto cuando X e Y están relacionados mediante una función lineal. El otro sentido en el que la correlación de Spearman no es paramétrica es que su distribución muestral exacta se puede obtener sin necesidad de conocer (es decir, conocer los parámetros) de la distribución de probabilidad conjunta de X e Y.

Ejemplo

En este ejemplo, los datos sin procesar arbitrarios de la siguiente tabla se utilizan para calcular la correlación entre el coeficiente intelectual de una persona y la cantidad de horas que pasa frente al televisor por semana [valores ficticios utilizados].

| IQ, Xi{displaystyle X_{i} | Horas de TV por semana, Yi{displaystyle Y... |

|---|---|

| 106 | 7 |

| 100 | 27 |

| 86 | 2 |

| 101 | 50 |

| 99 | 28 |

| 103 | 29 |

| 97 | 20 |

| 113 | 12 |

| 112 | 6 |

| 110 | 17 |

En primer lugar, evaluar di2{displaystyle ♪ ♪ ♪ ♪♪♪♪♪♪♪♪♪. Para ello, utilice los siguientes pasos, reflejados en el cuadro que figura a continuación.

- Ordenar los datos por la primera columna (Xi{displaystyle X_{i}). Crear una nueva columna xi{displaystyle x_{i}} y asignarle los valores 1, 2, 3,... n.

- A continuación, ordenar los datos por la segunda columna (Yi{displaystyle Y...). Crear una cuarta columna Sí.i{displaystyle Y... y le asignan los valores clasificados 1, 2, 3,... n.

- Crear una quinta columna di{displaystyle D_{i} mantener las diferencias entre las dos columnas de rango (xi{displaystyle x_{i}} y Sí.i{displaystyle Y...).

- Crear una columna final di2{displaystyle ♪ ♪ ♪ ♪♪♪♪♪♪♪♪♪ para mantener el valor de la columna di{displaystyle D_{i} cuadrados.

| IQ, Xi{displaystyle X_{i} | Horas de TV por semana, Yi{displaystyle Y... | rango xi{displaystyle x_{i}} | rango Sí.i{displaystyle Y... | di{displaystyle D_{i} | di2{displaystyle ♪ ♪ ♪ ♪♪♪♪♪♪♪♪♪ |

|---|---|---|---|---|---|

| 86 | 2 | 1 | 1 | 0 | 0 |

| 97 | 20 | 2 | 6 | −4 | 16 |

| 99 | 28 | 3 | 8 | ; 5 - | 25 |

| 100 | 27 | 4 | 7 | −3 | 9 |

| 101 | 50 | 5 | 10 | ; 5 - | 25 |

| 103 | 29 | 6 | 9 | −3 | 9 |

| 106 | 7 | 7 | 3 | 4 | 16 |

| 110 | 17 | 8 | 5 | 3 | 9 |

| 112 | 6 | 9 | 2 | 7 | 49 |

| 113 | 12 | 10 | 4 | 6 | 36 |

Con di2{displaystyle ♪ ♪ ♪ ♪♪♪♪♪♪♪♪♪ encontrado, añadirlos para encontrar .. di2=194{displaystyle sum d_{i}{2}=194}. El valor de n 10. Estos valores ahora se pueden sustituir de nuevo en la ecuación

- *** *** =1− − 6.. di2n()n2− − 1){displaystyle rho =1-{6sum d_{i}{2}{n(n^{2}-1)}}}

para dar

- *** *** =1− − 6× × 19410()102− − 1),{displaystyle rho =1-{6times 194}{10(10^{2}-1)}}}

que se evalúa a ρ = −29/165 = −0.175757575... con un p-value = 0.627188 (usando la distribución t).

Que el valor sea cercano a cero muestra que la correlación entre el coeficiente intelectual y las horas dedicadas a ver televisión es muy baja, aunque el valor negativo sugiere que cuanto más tiempo se dedica a ver televisión, menor es el coeficiente intelectual. En caso de empate en los valores originales, no se debe utilizar esta fórmula; en cambio, el coeficiente de correlación de Pearson debe calcularse en los rangos (donde los empates reciben rangos, como se describe anteriormente).

Intervalos de confianza

Intervalos de confianza para Spearman *** se puede obtener fácilmente utilizando el enfoque de probabilidad de Euclidean Jackknife en de Carvalho y Marques (2012). El intervalo de confianza con nivel α α {displaystyle alpha } se basa en un teorema de Wilks dado en el último papel, y es dado por

- {}Silencio Silencio :{}.. i=1n()Zi− − Silencio Silencio )}2.. i=1n()Zi− − Silencio Silencio )2≤ ≤ X1,α α 2},{displaystyle lefttheta:{frac {sum ¿Qué? ¿Por qué? - Sí.

Donde X1,α α 2{displaystyle mathrm {X} _{1,alpha } {2} es α α {displaystyle alpha } cuntil de una distribución chi-cuare con un grado de libertad, y el Zi{displaystyle Z_{i} son pseudo-valores de jackknife. Este enfoque se aplica en el paquete R spearmanCI.

Determinación de la importancia

Un enfoque para probar si un valor observado de ρ es significativamente diferente de cero (r siempre mantendrá −1 ≤ r ≤ 1) es calcular la probabilidad de que sea mayor o igual que la r observada, dada la hipótesis nula, mediante el uso de una prueba de permutación. Una ventaja de este enfoque es que automáticamente tiene en cuenta el número de valores de datos empatados en la muestra y la forma en que se tratan al calcular la correlación de rango.

Otro enfoque es paralelo al uso de la transformación de Fisher en el caso del coeficiente de correlación producto-momento de Pearson. Es decir, los intervalos de confianza y las pruebas de hipótesis relacionadas con el valor poblacional ρ se pueden realizar mediante la transformación de Fisher:

- F()r)=12In 1+r1− − r=Artanh r.{displaystyle F(r)={1}{2}ln {frac} {1+r}{1-r}= 'operatorname {artanh} r.

Si F(r) es la transformación de Fisher de r, el coeficiente de correlación de rango de Spearman de la muestra y n es el tamaño de la muestra, entonces

- z=n− − 31.06F()r){fnMicroc} {n-3}{1.06}}F(r)}

es un puntaje Z para r , que sigue aproximadamente una distribución normal estándar bajo la hipótesis nula de la independencia estadística ( ρ = = = 0 ).

uno también puede probar la importancia utilizando

- t=rn− − 21− − r2,{fnMicroc} {n-2}{1-r^{2}}}}}

que se distribuye aproximadamente como la distribución t de Student con n − 2 grados de libertad bajo la hipótesis nula. Una justificación de este resultado se basa en un argumento de permutación.

Una generalización del coeficiente de Spearman es útil en la situación en la que hay tres o más condiciones, se observan varios sujetos en cada una de ellas y se predice que las observaciones tendrán un orden particular. Por ejemplo, a varios sujetos se les puede dar tres intentos en la misma tarea, y se predice que el rendimiento mejorará de un intento a otro. E. B. Page desarrolló una prueba de la importancia de la tendencia entre las condiciones en esta situación y generalmente se la denomina prueba de tendencia de Page para alternativas ordenadas.

Análisis de correspondencias basado en el ρ de Spearman

El análisis de correspondencia clásico es un método estadístico que otorga una puntuación a cada valor de dos variables nominales. De esta forma se maximiza el coeficiente de correlación de Pearson entre ellos.

Existe un equivalente de este método, llamado análisis de correspondencia de calificaciones, que maximiza el ρ de Spearman o el τ de Kendall.

Aproximación de la ρ de Spearman a partir de un flujo

Hay dos enfoques existentes para aproximar el coeficiente de correlación de rango de Spearman de la transmisión de datos. El primer enfoque implica ensayar la distribución conjunta de ()X,Y){displaystyle (X,Y)}. Para continuo X,Y{displaystyle X,Y} valores: m1,m2{displaystyle m_{1},m_{2} los puntos de corte se seleccionan para X{displaystyle X} y Y{displaystyle Sí. respectivamente, estas variables aleatorias. Los puntos de corte predeterminados se añaden en − − JUEGO JUEGO {displaystyle -infty } y JUEGO JUEGO {displaystyle infty }. Una matriz contable de tamaño ()m1+1)× × ()m2+1){displaystyle (m_{1}+1)times (m_{2}+1)}, denotado M{displaystyle M}, entonces se construye donde M[i,j]{displaystyle M[i,j] almacena el número de observaciones que caída en la célula bidimensional indexada por ()i,j){displaystyle (i,j)}. Para la transmisión de datos, cuando llega una nueva observación, lo apropiado M[i,j]{displaystyle M[i,j] El elemento se aumenta. El rango de Spearman la correlación puede ser calculada, basada en la matriz contable M{displaystyle M}, usando operaciones de álgebra lineal (Algorithm 2). Note que para el azar discreto variables, ningún procedimiento de discretización es necesario. Este método es aplicable a los datos de transmisión estacionaria, así como a grandes conjuntos de datos. Para datos de transmisión no estacionarios, donde el coeficiente de correlación de rango de Spearman puede cambiar con el tiempo, se puede aplicar el mismo procedimiento, pero a una ventana móvil de observaciones. Al utilizar una ventana móvil, los requisitos de memoria crecen linealmente con el tamaño de la ventana elegido.

El segundo enfoque para aproximar el coeficiente de correlación de rango de Spearman a partir de datos de transmisión implica el uso de estimadores basados en series de Hermite. Estos estimadores, basados en polinomios de Hermite, permitir la estimación secuencial de la función de densidad de probabilidad y la función de distribución acumulada en casos univariados y bivariados. Densidad de la serie Hermite bivariada Los estimadores univariados y los estimadores de función de distribución acumulativa basados en series de Hermite univariados se conectan a una versión de muestra grande del Estimador de coeficiente de correlación de rango de Spearman, para dar un estimador de correlación secuencial de Spearman. Este estimador está expresado en términos de operaciones de álgebra lineal para eficiencia computacional (ecuación (8) y algoritmo 1 y 2). Estos algoritmos solo son aplicables a datos de variables aleatorias continuas, pero tienen ciertas ventajas sobre el enfoque de matriz de conteo en este entorno. La primera ventaja es una precisión mejorada cuando se aplica a un gran número de observaciones. La segunda ventaja es que el coeficiente de correlación de rangos de Spearman se puede calculado en flujos no estacionarios sin depender de una ventana en movimiento. En cambio, el estimador basado en la serie Hermite utiliza un esquema de ponderación exponencial para rastrear la correlación de rango de Spearman variable en el tiempo a partir de datos de transmisión, que tiene requisitos de memoria constantes con respecto a "efectivo" tamaño de la ventana móvil. Existe una implementación de software de estos algoritmos basados en la serie Hermite y se analiza en Implementaciones de software.

Implementaciones de software

- Las estadísticas del paquete base implementan el test cor.test(x, y, método = "spearman") en su paquete "stats" (también

cor(x, y, method = "spearman")funcionará. El paquete spearmanCI calcula intervalos de confianza. El editor de paquetes calcula estimaciones rápidas de la correlación de Spearman junto con estimaciones secuenciales (es decir, estimaciones que se actualizan de manera online/incremental a medida que se incorporan nuevas observaciones). - Aplicación de las estadísticas:

spearman varlistcalcula todos los coeficientes de correlación pares para todas las variables en varlist. - Aplicación del MATLAB:

[r,p] = corr(x,y,'Type','Spearman')Donderes el coeficiente de correlación de rango de Spearman,pes el valor p, yxyyson vectores. - Python tiene muchas diferentes implementaciones de la correlación del especiador estadística de correlación: se puede computar con la función de especiador de la escipy. módulo de estadísticas, así como con el método DataFrame.corr(method='spearman') de la biblioteca pandas, y la función corr(x, y, method='spearman') del paquete estadístico pingouin.

Contenido relacionado

Condado de Sedgwick (Kansas)

Problema de cumpleaños

Desigualdad (matemáticas)

![{displaystyle {overline {R}}={overline {S}}=mathbb {E} [U]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e1e263cff70e17f5e2626e24379a102345d4007b)

![{displaystyle sigma _{R}^{2}=sigma _{S}^{2}=mathrm {Var} (U)=mathbb {E} [U^{2}]-mathbb {E} [U]^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/07ce14dc52fef153dfdbd446fad160081b84a27d)

![{displaystyle mathbb {E} [U]=textstyle {frac {1}{n}}textstyle sum _{i=1}^{n}i=textstyle {frac {(n+1)}{2}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/be6843688fdbc5345e7f40b14d110aed94cf0af7)

![{displaystyle mathbb {E} [U^{2}]=textstyle {frac {1}{n}}textstyle sum _{i=1}^{n}i^{2}=textstyle {frac {(n+1)(2n+1)}{6}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b588a93a142d574d8632d2bbe3afefaa041fce7a)

![{displaystyle M[i,j]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/46a618d7ccbbfcf5ac18e353c34883aa739e49da)