Álgebra Linear

Álgebra linear é o ramo da matemática referente a equações lineares como:

- um1x1+⋯ ⋯ +umnxn= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =b),Não. a_{1}x_{1}+cdots +a_{n}x_{n}=b,}

mapas lineares como:

- (x1,...... ,xn)↦ ↦ um1x1+⋯ ⋯ +umnxn,(x_{1},ldotsx_{n})mapsto a_{1}x_{1}+cdots +a_{n}x_{n},}

e suas representações em espaços vetoriais e através de matrizes.

A álgebra linear é fundamental para quase todas as áreas da matemática. Por exemplo, a álgebra linear é fundamental nas apresentações modernas de geometria, inclusive para definir objetos básicos como linhas, planos e rotações. Além disso, a análise funcional, um ramo da análise matemática, pode ser vista como a aplicação da álgebra linear a espaços de funções.

A álgebra linear também é usada na maioria das ciências e campos da engenharia, porque permite modelar muitos fenômenos naturais e computar eficientemente com tais modelos. Para sistemas não lineares, que não podem ser modelados com álgebra linear, é frequentemente usado para lidar com aproximações de primeira ordem, usando o fato de que a diferencial de uma função multivariada em um ponto é o mapa linear que melhor aproxima a função próxima a esse ponto.

História

O procedimento (usando bastões de contagem) para resolver equações lineares simultâneas agora chamado de eliminação Gaussiana aparece no antigo texto matemático chinês Capítulo Oito: Arranjos Retangulares dos Os Nove Capítulos sobre a Arte Matemática. Seu uso é ilustrado em dezoito problemas, com duas a cinco equações.

Os sistemas de equações lineares surgiram na Europa com a introdução em 1637 por René Descartes de coordenadas em geometria. De fato, nessa nova geometria, agora chamada de geometria cartesiana, retas e planos são representados por equações lineares, e computar suas interseções equivale a resolver sistemas de equações lineares.

Os primeiros métodos sistemáticos para resolver sistemas lineares usavam determinantes e foram considerados pela primeira vez por Leibniz em 1693. Em 1750, Gabriel Cramer os usou para fornecer soluções explícitas de sistemas lineares, agora chamada de regra de Cramer. Mais tarde, Gauss descreveu ainda mais o método de eliminação, que foi inicialmente listado como um avanço na geodésia.

Em 1844, Hermann Grassmann publicou sua "Teoria da Extensão" que incluiu novos tópicos fundamentais do que hoje é chamado de álgebra linear. Em 1848, James Joseph Sylvester introduziu o termo matrix, que em latim significa útero.

A álgebra linear cresceu com ideias notadas no plano complexo. Por exemplo, dois números O quê? e zangão. em C{displaystyle mathbb {C} } } tem uma diferença O quê? – zangão., e os segmentos de linha O quê? e 0(O quê? - Sim. zangão.) são do mesmo comprimento e direção. Os segmentos são equipollent. O sistema de quatro dimensões H. H. H.{displaystyle mathbb {H} } } de quaternions foi descoberto por W.R. Hamilton em 1843. O termo vetor foi introduzido como v = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = xEu... + Sim.JJ + zangão.k representando um ponto no espaço. A diferença de quaternidade p – q também produz um equipamento de segmento para PQ. Outros sistemas de números hipercomplexos também usaram a ideia de um espaço linear com base.

Arthur Cayley introduziu a multiplicação de matrizes e a matriz inversa em 1856, tornando possível o grupo linear geral. O mecanismo de representação de grupo tornou-se disponível para descrever números complexos e hipercomplexos. Crucialmente, Cayley usou uma única letra para denotar uma matriz, tratando assim uma matriz como um objeto agregado. Ele também percebeu a conexão entre matrizes e determinantes, e escreveu "Haveria muitas coisas a dizer sobre esta teoria das matrizes que deveriam, a meu ver, preceder a teoria dos determinantes".

Benjamin Peirce publicou sua Linear Associative Algebra (1872), e seu filho Charles Sanders Peirce estendeu o trabalho posteriormente.

O telégrafo exigia um sistema explicativo, e a publicação de 1873 de Um tratado sobre eletricidade e magnetismo instituiu uma teoria de campo de forças e exigia geometria diferencial para expressão. A álgebra linear é geometria diferencial plana e serve em espaços tangentes a variedades. As simetrias eletromagnéticas do espaço-tempo são expressas pelas transformações de Lorentz, e muito da história da álgebra linear é a história das transformações de Lorentz.

A primeira definição moderna e mais precisa de um espaço vetorial foi introduzida por Peano em 1888; em 1900, surgiu uma teoria de transformações lineares de espaços vetoriais de dimensão finita. A álgebra linear tomou sua forma moderna na primeira metade do século XX, quando muitas ideias e métodos dos séculos anteriores foram generalizados como álgebra abstrata. O desenvolvimento dos computadores levou ao aumento da pesquisa em algoritmos eficientes para eliminação gaussiana e decomposições de matrizes, e a álgebra linear tornou-se uma ferramenta essencial para modelagem e simulações.

Espaços vetoriais

Até o século XIX, a álgebra linear foi introduzida através de sistemas de equações lineares e matrizes. Na matemática moderna, a apresentação através de espaços vetoriais é geralmente preferida, pois é mais sintética, mais geral (não limitada ao caso de dimensão finita) e conceitualmente mais simples, embora mais abstrata.

Um espaço vetorial sobre um corpo F (geralmente o campo dos números reais) é um conjunto V equipado com duas operações binárias que satisfazem os seguintes axiomas. Elementos de V são chamados de vetores, e elementos de F são chamados de escalares . A primeira operação, adição de vetores, usa quaisquer dois vetores v e w e gera um terceiro vetor v + w. A segunda operação, multiplicação escalar, usa qualquer escalar a e qualquer vetor v e gera um novo vetor av. Os axiomas que a adição e a multiplicação escalar devem satisfazer são os seguintes. (Na lista abaixo, u, v e w são elementos arbitrários de V e a e b são escalares arbitrários no campo F.)

Axioma Significação Associatividade da adição u +v + O quê?) = (u + v) + O quê? Comutatividade de adição u + v = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = v + u Elemento de identidade de adição Existe um elemento 0 em V, chamado de vetor zero (ou simplesmente) zero), tal que v + 0 = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = v para todos v em V. Elementos inversos de adição Para cada v em V, existe um elemento - Sim.v em V, chamado de aditivo inverso de v, tal que v +v) = 0 Distribuição da multiplicação escalar em relação à adição vetorial um(u + v) = umu + umv Distribuição da multiplicação escalar com relação à adição de campo (um + b))v = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = umv + b)v Compatibilidade de multiplicação escalar com multiplicação de campo um(b)v) = (A)v elemento de identidade da multiplicação escalar 1v = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = v, onde 1 denota a identidade multiplicativa de F.

Os quatro primeiros axiomas significam que V é um grupo abeliano sob adição.

Um elemento de um espaço vetorial específico pode ter várias naturezas; por exemplo, pode ser uma sequência, uma função, um polinômio ou uma matriz. A álgebra linear se preocupa com as propriedades de tais objetos que são comuns a todos os espaços vetoriais.

Mapas lineares

Mapas lineares são mapeamentos entre espaços vetoriais que preservam a estrutura do espaço vetorial. Dados dois espaços vetoriais V e W sobre um campo F, um mapa linear (também chamado, em alguns contextos, de transformação linear ou mapeamento linear) é um mapa

- T:V→ → WNão. T:Vto W}

compatível com adição e multiplicação escalar, ou seja

- T(u+v)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =T(u)+T(v),T(umv)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =umT(v){displaystyle T(mathbf {u} +mathbf {v})=T(mathbf {u})+T(mathbf {v}),quad T(amathbf {v})=aT(mathbf {v})}

para quaisquer vetores u,v em V e escalar a em F.

Isso implica que, para quaisquer vetores u, v em V e escalares a, b no estilo F, tem

- T(umu+b)v)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =T(umu)+T(b)v)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =umT(u)+b)T(v)(amathbf {u} +bmathbf {v})=T(amathbf {u})+T(bmathbf {v})=aT(mathbf {u})+bT(mathbf {v})}

Quando V = W são o mesmo espaço vetorial, um mapa linear T: V → V também é conhecido como um operador linear em V.

Um mapa linear bijetivo entre dois espaços vetoriais (ou seja, cada vetor do segundo espaço está associado a exatamente um no primeiro) é um isomorfismo. Como um isomorfismo preserva a estrutura linear, dois espaços vetoriais isomórficos são "essencialmente os mesmos" do ponto de vista da álgebra linear, no sentido de que não podem ser distinguidos usando propriedades do espaço vetorial. Uma questão essencial em álgebra linear é testar se um mapa linear é um isomorfismo ou não e, se não for um isomorfismo, encontrar seu intervalo (ou imagem) e o conjunto de elementos que são mapeados para o vetor zero, chamado de kernel do mapa. Todas essas questões podem ser resolvidas usando a eliminação gaussiana ou alguma variante desse algoritmo.

Subespaços, extensão e base

O estudo daqueles subconjuntos de espaços vetoriais que são em si mesmos espaços vetoriais sob as operações induzidas é fundamental, assim como para muitas estruturas matemáticas. Esses subconjuntos são chamados de subespaços lineares. Mais precisamente, um subespaço linear de um espaço vetorial V sobre um campo F é um subconjunto W de V tal que u + v e au estão em W, para cada u, v em W, e cada a em F. (Estas condições são suficientes para implicar que W é um espaço vetorial.)

Por exemplo, dado um mapa linear T: V → W, o imagem T(V) de V, e a imagem inversa T−1(0) de 0 (chamado kernel ou espaço nulo), são subespaços lineares de W e V, respectivamente.

Outra forma importante de formar um subespaço é considerar combinações lineares de um conjunto S de vetores: o conjunto de todas as somas

- um1v1+um2v2+⋯ ⋯ +umkvk,(v) _{1}+a_{2}mathbf Não. _{2}+cdots +a_{k}mathbf {v} _{k},}

onde v1, v2,..., vk estão em S e a1, a2,..., ak estão em F formam um subespaço linear chamado span de S. A extensão de S também é a interseção de todos os subespaços lineares contendo S. Em outras palavras, é o menor (para a relação de inclusão) subespaço linear contendo S.

Um conjunto de vetores é linearmente independente se nenhum estiver no espaço dos outros. Equivalentemente, um conjunto S de vetores é linearmente independente se a única maneira de expressar o vetor zero como uma combinação linear de elementos de S é tomar zero para cada coeficiente a i.

Um conjunto de vetores que gera um espaço vetorial é chamado de conjunto gerador ou conjunto gerador. Se um conjunto de expansão S é linearmente dependente (que não é linearmente independente), então algum elemento w de S está no intervalo do outros elementos de S, e o span permaneceria o mesmo se remover w de S. Pode-se continuar a remover elementos de S até obter um conjunto de expansão linearmente independente. Tal conjunto linearmente independente que abrange um espaço vetorial V é chamado de base de V. A importância das bases reside no fato de serem simultaneamente conjuntos geradores mínimos e conjuntos independentes máximos. Mais precisamente, se S for um conjunto linearmente independente e T é um conjunto abrangente tal que S ⊆ T, então existe uma base B tal que S ⊆ B ⊆ T.

Quaisquer duas bases de um espaço vetorial V têm a mesma cardinalidade, que é chamada de dimensão de V; este é o teorema da dimensão para espaços vetoriais. Além disso, dois espaços vetoriais sobre o mesmo campo F são isomórficos se e somente se tiverem a mesma dimensão.

Se qualquer base de V (e, portanto, toda base) tiver um número finito de elementos, V é um espaço vetorial de dimensão finita. Se U for um subespaço de V, então dim U ≤ dim V. No caso em que V é de dimensão finita, a igualdade das dimensões implica em U = V.

Se U1 e U2 são subespaços de V, então

- Não. (U1+U2)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =Não. U1+Não. U2- Sim. - Sim. Não. (U1─ ─ U2),{displaystyle dim(U_{1}+U_{2})=dim U_{1}+dim U_{2}-dim(U_{1}cap U_{2}),}

onde U1 + U2 denota o intervalo de U1 ∪ U2.

Matrizes

As matrizes permitem a manipulação explícita de espaços vetoriais de dimensão finita e mapas lineares. Sua teoria é, portanto, uma parte essencial da álgebra linear.

Seja V um espaço vetorial de dimensão finita sobre um campo F e (v1, v2,..., vm) ser uma base de V (portanto, m é a dimensão de V). Por definição de base, o mapa

- (um1,...... ,umm)↦ ↦ um1v1+⋯ ⋯ ummvmFm→ → V{displaystyle {begin{aligned}(a_{1},ldotsa_{m})&mapsto a_{1}mathbf Não. _{1}+cdots a_{m}mathbf {v} _{m}\F^{m}&to Vend{aligned}}}

é uma bijeção de Fm, o conjunto das sequências de m elementos de F, em V. Este é um isomorfismo de espaços vetoriais, se Fm estiver equipado com sua estrutura padrão de espaço vetorial, onde a adição vetorial e a multiplicação escalar são feitas componente por componente.

Este isomorfismo permite representar um vetor por sua imagem inversa sob este isomorfismo, ou seja, pelo vetor de coordenadas (a1,..., am) ou pela coluna da matriz

- Não.um1FORMAÇÃO FORMAÇÃO umm].{displaystyle {begin{bmatrix}a_{1}\vdots \a_{m}end{bmatrix}}.}

Se W for outro espaço vetorial de dimensão finita (possivelmente o mesmo), com uma base (w1,..., wn), um mapa linear f de W para V é bem definido por seus valores nos elementos de base, ou seja, (f(w1),..., f(wn)). Assim, f é bem representado pela lista das matrizes de colunas correspondentes. Isto é, se

- f(O quê?JJ)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =um1,JJv1+⋯ ⋯ +umm,JJvm,{displaystyle f(w_{j})=a_{1,j}v_{1}+cdots +a_{m,j}v_{m},}

para j = 1,..., n, então estilo f é representado pela matriz

- Não.um1,1⋯ ⋯ um1,nFORMAÇÃO FORMAÇÃO ⋱ ⋱ FORMAÇÃO FORMAÇÃO umm,1⋯ ⋯ umm,n],{displaystyle {begin{bmatrix}a_{1,1}&cdots &a_{1,n}\vdots &ddots &vdots \a_{m,1}&cdots &a_{m,n}end{bmatrix}},}

com m linhas e n colunas.

A multiplicação de matrizes é definida de tal forma que o produto de duas matrizes é a matriz da composição dos mapas lineares correspondentes, e o produto de uma matriz e uma matriz coluna é a matriz coluna que representa o resultado da aplicação do representado mapa linear para o vetor representado. Segue-se que a teoria dos espaços vetoriais de dimensão finita e a teoria das matrizes são duas linguagens diferentes para expressar exatamente os mesmos conceitos.

Duas matrizes que codificam a mesma transformação linear em bases diferentes são chamadas de semelhantes. Pode-se provar que duas matrizes são semelhantes se e somente se uma pode transformar uma na outra por operações elementares de linha e coluna. Para uma matriz que representa um mapa linear de W a V, as operações de linha correspondem à mudança de bases em V e as operações de coluna correspondem à mudança de bases em W. Cada matriz é semelhante a uma matriz identidade possivelmente limitada por zero linhas e zero colunas. Em termos de espaços vetoriais, isso significa que, para qualquer mapa linear de W a V, existem bases tais que parte da base de W é mapeado bijetivamente em uma parte da base de V, e que os demais elementos da base de W, se houver, são mapeados para zero. A eliminação gaussiana é o algoritmo básico para encontrar essas operações elementares e provar esses resultados.

Sistemas lineares

Um conjunto finito de equações lineares em um conjunto finito de variáveis, por exemplo, x1, x2,..., xn ou x, y,..., z é chamado de sistema de equações lineares ou sistema linear .

Sistemas de equações lineares formam uma parte fundamental da álgebra linear. Historicamente, a álgebra linear e a teoria das matrizes foram desenvolvidas para resolver tais sistemas. Na apresentação moderna da álgebra linear através de espaços vetoriais e matrizes, muitos problemas podem ser interpretados em termos de sistemas lineares.

Por exemplo, deixe

- 2x+Sim.- Sim. - Sim. zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =8- Sim. - Sim. 3x- Sim. - Sim. Sim.+2zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =- Sim. - Sim. 11- Sim. - Sim. 2x+Sim.+2zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =- Sim. - Sim. 3{displaystyle {begin{alignedat}{7}2x&&;+;&&y&&;-;&z&&;=; &&8\-3x&;-; &&y&;+;&&2z&&;=; &&-11\-2x&;+;&&y&&;+;&&2z&&;=;&-3end{alignedat}}}

(S)

seja um sistema linear.

A tal sistema, pode-se associar a sua matriz

- M= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =Não.21- Sim. - Sim. 1- Sim. - Sim. 3- Sim. - Sim. 12- Sim. - Sim. 212].{displaystyle M=left[{begin{array}{rrr}2&1&-1-3&-1&2-2&1&2end{array}}right].}

e seu vetor de membro direito

- v= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =Não.8- Sim. - Sim. 11- Sim. - Sim. 3].{displaystyle mathbf {v} ={begin{bmatrix}8\-11-3end{bmatrix}}.}

Seja T a transformação linear associada à matriz M. Uma solução do sistema (S) é um vetor

- X= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =Não.xSim.zangão.]{displaystyle mathbf {X} ={begin{bmatrix}xyzend{bmatrix}}}

tal que

- T(X)= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =v,{displaystyle T(mathbf {X})=mathbf {v}}

que é um elemento da pré-imagem de v por T.

Seja (S′) o sistema homogêneo associado, onde os lados direitos das equações são postos a zero:

- 2x+Sim.- Sim. - Sim. zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =0- Sim. - Sim. 3x- Sim. - Sim. Sim.+2zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =0- Sim. - Sim. 2x+Sim.+2zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =0{displaystyle {begin{alignedat}{7}2x&&;+;&&y&&;-;&z&&;=; &&0\-3x&;-; &&y&&;+;&&&2z&&;=;&0-2x&&;+;&y&&;+;&&2z&&&;=; &&0end{alignedat}}}

(S.)

As soluções de (S′) são exatamente os elementos do kernel de T ou, equivalente a M.

A eliminação gaussiana consiste em realizar operações elementares de linha na matriz aumentada

- Não.Mv]= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =Não.21- Sim. - Sim. 18- Sim. - Sim. 3- Sim. - Sim. 12- Sim. - Sim. 11- Sim. - Sim. 212- Sim. - Sim. 3]{displaystyle left[!{begin{array}{c|c}M&mathbf {v} end{array}}right]=left[{begin{array}{rrr|r}2&1&-1&8-3&-1&2&11-2&1&2&-3end{array}}right]}

por colocá-lo na forma escalonada reduzida. Essas operações de linha não alteram o conjunto de soluções do sistema de equações. No exemplo, a forma escalonada reduzida é

- Não.Mv]= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =Não.10020103001- Sim. - Sim. 1],{displaystyle left[!{begin{array}{c|c}M&mathbf {v} end{array}}right]=left[{begin{array}{rrr|r}1&0&0&0&2&1&0&3&0&1&-1end{array}}right], ?

mostrando que o sistema (S) tem a única solução

- x= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =2Sim.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =3zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =- Sim. - Sim. 1.{displaystyle {begin{aligned}x&=2\y&=3z&=-1.end{aligned}}}

Resulta dessa interpretação matricial de sistemas lineares que os mesmos métodos podem ser aplicados para resolver sistemas lineares e para muitas operações em matrizes e transformações lineares, que incluem o cálculo de postos, núcleos, inversas de matrizes.

Endomorfismos e matrizes quadradas

Um endomorfismo linear é um mapa linear que mapeia um espaço vetorial V para si mesmo. Se V tiver uma base de n, tal endomorfismo é representado por uma matriz quadrada de tamanho n.

Com relação aos mapas lineares gerais, os endomorfismos lineares e as matrizes quadradas têm algumas propriedades específicas que tornam seu estudo uma parte importante da álgebra linear, que é usada em muitas partes da matemática, incluindo transformações geométricas, mudanças de coordenadas, formas quadráticas e muitas outras partes da matemática.

Determinante

O determinante de uma matriz quadrada A é definido como

- Gerenciamento Gerenciamento σ σ ∈ ∈ Sn(- Sim. - Sim. 1)σ σ um1σ σ (1)⋯ ⋯ umnσ σ (n),{displaystyle sum _{sigma in S_{n}}(-1)^{sigma }a_{1sigma (1)}cdots a_{nsigma (n)},}

onde Sn é o grupo de todas as permutações de n elementos, σ é uma permutação e (−1)σ a paridade da permutação. Uma matriz é invertível se e somente se o determinante for invertível (isto é, diferente de zero se os escalares pertencerem a um corpo).

A regra de Cramer é uma expressão de forma fechada, em termos de determinantes, da solução de um sistema de n equações lineares em n incógnitas. A regra de Cramer é útil para raciocinar sobre a solução, mas, exceto para n = 2 ou 3 , raramente é usado para calcular uma solução, pois a eliminação gaussiana é um algoritmo mais rápido.

O determinante de um endomorfismo é o determinante da matriz que representa o endomorfismo em termos de alguma base ordenada. Essa definição faz sentido, pois esse determinante independe da escolha da base.

Autovalores e autovetores

Se f é um endomorfismo linear de um espaço vetorial V sobre um campo F, um eigenvector de f é um vetor diferente de zero v de V tal que f(v) = av para algum a escalar em F. Este a escalar é um autovalor de f.

Se a dimensão de V for finita e uma base tiver sido escolhida, estilo f e v podem ser representados, respectivamente, por uma matriz quadrada M e uma matriz de colunas z; a equação que define autovetores e autovalores torna-se

- Mzangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =umzangão..Não. Mz=az.

Usando a matriz identidade I, cujas entradas são todas zero, exceto as da diagonal principal, que são iguais a um, isso pode ser reescrito

- (M- Sim. - Sim. umEu...)zangão.= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =0.(M-aI)z=0.}

Como z deve ser diferente de zero, isso significa que M – aI é uma matriz singular e, portanto, seu determinante det (M − aI) é igual a zero. Os autovalores são, portanto, as raízes do polinômio

- - Não.(xEu...- Sim. - Sim. M).{displaystyle det(xI-M).}

Se V for de dimensão n, este é um polinômio mônico de grau n, chamado de polinômio característico da matriz (ou do endomorfismo), e existem, no máximo, n autovalores.

Se existe uma base que consiste apenas em autovetores, a matriz de f nesta base tem uma estrutura muito simples: é uma matriz diagonal tal que as entradas na diagonal principal são autovalores e as outras entradas são zero. Neste caso, o endomorfismo e a matriz são ditos diagonalizáveis. Mais geralmente, um endomorfismo e uma matriz também são ditos diagonalizáveis, se eles se tornarem diagonalizáveis após estender o campo de escalares. Nesse sentido estendido, se o polinômio característico é livre de quadrados, então a matriz é diagonalizável.

Uma matriz simétrica é sempre diagonalizável. Existem matrizes não diagonalizáveis, sendo a mais simples

- Não.0100]{displaystyle {begin{bmatrix}0&1&0end{bmatrix}}}

(não pode ser diagonalizável, pois seu quadrado é a matriz zero e o quadrado de uma matriz diagonal diferente de zero nunca é zero).

Quando um endomorfismo não é diagonalizável, existem bases nas quais ele tem uma forma simples, embora não tão simples quanto a forma diagonal. A forma normal de Frobenius não precisa estender o campo dos escalares e torna o polinômio característico imediatamente legível na matriz. A forma normal de Jordan requer estender o campo do escalar para conter todos os autovalores e difere da forma diagonal apenas por algumas entradas que estão logo acima da diagonal principal e são iguais a 1.

Dualidade

Uma forma linear é um mapa linear de um espaço vetorial V sobre um campo estilo F ao campo de escalares F, visto como um espaço vetorial sobre si mesmo. Equipadas por adição pontual e multiplicação por um escalar, as formas lineares formam um espaço vetorial, chamado espaço dual de V , e geralmente denotado V* ou V′.

Se v1,..., vn é uma base de V (isso implica que V é de dimensão finita), então pode-se definir, para i = 1,..., n, um mapa linear vi* tal que vi*(vi) = 1 e vi*(vj ) = 0 se j ≠ i. Esses mapas lineares formam uma base de V*, chamada de base dual de v 1,..., vn. (Se V não for de dimensão finita, o vi* podem ser definidos de forma semelhante; eles são linearmente independentes, mas não formam uma base.)

Para v em V, o mapa

- f→ → f(v){displaystyle fto f(mathbf {v})}

é uma forma linear em V*. Isso define o mapa linear canônico de V para (V*)*, o dual de V*, chamado de bidual de V. Este mapa canônico é um isomorfismo se V é de dimensão finita, e isso permite identificar V com seu bidual. (No caso de dimensão infinita, o mapa canônico é injetivo, mas não sobrejetivo.)

Existe, portanto, uma simetria completa entre um espaço vetorial de dimensão finita e seu dual. Isso motiva o uso frequente, nesse contexto, da notação colchete

- ⟨ ⟨ f,x)) {displaystyle langle f,mathbf {x} rangle }

para denotar f(x).

Mapa duplo

Deixe

- f:V→ → WNão.

ser um mapa linear. Para cada forma linear h em W, a função composta h ∘ f é uma forma linear no estilo V. Isso define um mapa linear

- f∗ ∗ :W∗ ∗ → → V∗ ∗ {displaystyle f^{*}:W^{*}to V^{*}}

entre os espaços duplos, que é chamado de dual ou transposição de f.

Se V e W são de dimensão finita e M é a matriz de f em termos de algumas bases ordenadas, então a matriz de f* sobre as bases duplas é a transposição MT de M, obtido pela troca de linhas e colunas.

Se elementos de espaços vetoriais e seus duais são representados por vetores coluna, essa dualidade pode ser expressa em notação de colchetes por

- ⟨ ⟨ hT,Mv)) = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =⟨ ⟨ hTM,v)) .{displaystyle langle h^{mathsf {T}},Mmathbf {v} rangle =langle h^{mathsf {T}}M,mathbf {v} rangle.}

Para destacar essa simetria, os dois membros dessa igualdade às vezes são escritos

- ⟨ ⟨ hT∣ ∣ M∣ ∣ v)) .{displaystyle langle h^{mathsf {T}}mid Mmid mathbf {v} rangle.}

Espaços de produto interno

Além desses conceitos básicos, a álgebra linear também estuda espaços vetoriais com estrutura adicional, como um produto interno. O produto interno é um exemplo de forma bilinear e dá ao espaço vetorial uma estrutura geométrica ao permitir a definição de comprimento e ângulos. Formalmente, um produto interno é um mapa

- ⟨ ⟨ )) ,)) )) :V× × V→ → F{displaystyle langle cdotcdot rangle: Vtimes Vto F}

que satisfaz os três axiomas a seguir para todos os vetores u, v, w em V e todos os escalares a em F:

- Simetria conjugal:

- ⟨ ⟨ u,v)) = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =⟨ ⟨ v,u)) ? ? .{displaystyle langle mathbf {u}mathbf {v} rangle ={overline {langle mathbf {v}mathbf {u} rangle }}}

- Em R{displaystyle mathbb {R} } }, é simétrico.

- Linearidade no primeiro argumento:

- ⟨ ⟨ umu,v)) = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =um⟨ ⟨ u,v)) .⟨ ⟨ u+v,O quê?)) = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =⟨ ⟨ u,O quê?)) +⟨ ⟨ v,O quê?)) .{displaystyle {begin{aligned}langle amathbf {u}mathbf {v} rangle &=alangle mathbf {u}mathbf {v} rangle.\langle mathbf {u} +mathbf {v}mathbf {w} rangle &=langle mathbf {u}mathbf {w} rangle +langle mathbf {v}mathbf {w} rangle.end{aligned}}}

- Definitividade:

- ⟨ ⟨ v,v)) ≥ ≥ 0{displaystyle langle mathbf {v}mathbf {v} rangle geq 0

- com igualdade apenas para v = 0.

Podemos definir o comprimento de um vetor v em V por

- ‖ ‖ v‖ ‖ 2= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =⟨ ⟨ v,v)) ,{displaystyle |mathbf {v}} |^{2}=langle mathbf {v}mathbf {v} rangle}

e podemos provar a desigualdade de Cauchy–Schwarz:

- |⟨ ⟨ u,v)) |≤ ≤ ‖ ‖ u‖ ‖ )) ‖ ‖ v‖ ‖ .|langle mathbf {u}mathbf {v} rangle |leq |mathbf {u} |cdot |mathbf {v} - Sim.

Em particular, a quantidade

- |⟨ ⟨ u,v)) |‖ ‖ u‖ ‖ )) ‖ ‖ v‖ ‖ ≤ ≤ 1,{displaystyle {frac {|langle mathbf {u}mathbf {v} rangle |}{|mathbf {u} |cdot |mathbf {v} |}}leq 1,}

e assim podemos chamar essa quantidade de cosseno do ângulo entre os dois vetores.

Dois vetores são ortogonais se ⟨u, v⟩ = 0. Uma base ortonormal é uma base onde todos os vetores de base têm comprimento 1 e são ortogonais entre si. Dado qualquer espaço vetorial de dimensão finita, uma base ortonormal pode ser encontrada pelo procedimento de Gram-Schmidt. Bases ortonormais são particularmente fáceis de lidar, pois se v = a1 v1 + ⋯ + an vn, então

- umEu...= = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =⟨ ⟨ v,vEu...)) .Não. a_{i}=langle mathbf {v}mathbf {v} _{i}rangle.}

O produto interno facilita a construção de muitos conceitos úteis. Por exemplo, dada uma transformação T, podemos definir seu conjugado hermitiano T* como a transformação linear satisfazendo

- ⟨ ⟨ Tu,v)) = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = = =⟨ ⟨ u,T∗ ∗ v)) .{displaystyle langle Tmathbf {u}mathbf {v} rangle =langle mathbf {u} T^{*}mathbf {v} rangle.}

Se T satisfizer TT* = T*T, chamamos de T normal. Acontece que as matrizes normais são precisamente as matrizes que possuem um sistema ortonormal de autovetores que abrangem V.

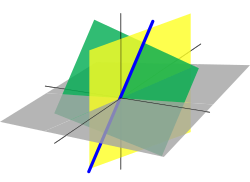

Relação com a geometria

Existe uma forte relação entre a álgebra linear e a geometria, que começou com a introdução por René Descartes, em 1637, das coordenadas cartesianas. Nesta nova (na época) geometria, agora chamada de geometria cartesiana, os pontos são representados por coordenadas cartesianas, que são sequências de três números reais (no caso do espaço tridimensional usual). Os objetos básicos da geometria, que são linhas e planos, são representados por equações lineares. Assim, computar interseções de retas e planos equivale a resolver sistemas de equações lineares. Esta foi uma das principais motivações para o desenvolvimento da álgebra linear.

A maioria das transformações geométricas, como translações, rotações, reflexões, movimentos rígidos, isometrias e projeções transformam linhas em linhas. Segue-se que eles podem ser definidos, especificados e estudados em termos de mapas lineares. É o caso também das homografias e das transformações de Möbius, quando consideradas como transformações de um espaço projetivo.

Até finais do século XIX, os espaços geométricos eram definidos por axiomas relativos a pontos, rectas e planos (geometria sintética). Por volta dessa data, parece que também se pode definir espaços geométricos por construções envolvendo espaços vetoriais (ver, por exemplo, espaço projetivo e espaço afim). Foi demonstrado que as duas abordagens são essencialmente equivalentes. Na geometria clássica, os espaços vetoriais envolvidos são espaços vetoriais sobre os reais, mas as construções podem ser estendidas para espaços vetoriais sobre qualquer corpo, permitindo considerar a geometria sobre campos arbitrários, inclusive finitos.

Atualmente, a maioria dos livros didáticos introduz espaços geométricos a partir da álgebra linear, e a geometria é frequentemente apresentada, no nível elementar, como um subcampo da álgebra linear.

Uso e aplicações

A álgebra linear é utilizada em quase todas as áreas da matemática, tornando-se assim relevante em quase todos os domínios científicos que utilizam a matemática. Essas aplicações podem ser divididas em várias categorias amplas.

Geometria do espaço ambiente

A modelagem do espaço ambiente é baseada na geometria. As ciências preocupadas com este espaço usam amplamente a geometria. É o caso da mecânica e da robótica, para descrever a dinâmica de corpos rígidos; geodésia para descrever a forma da Terra; perspectividade, visão computacional e computação gráfica, para descrever a relação entre uma cena e sua representação plana; e muitos outros domínios científicos.

Em todas essas aplicações, a geometria sintética é freqüentemente usada para descrições gerais e uma abordagem qualitativa, mas para o estudo de situações explícitas, deve-se calcular com coordenadas. Isso requer o uso pesado de álgebra linear.

Análise funcional

A análise funcional estuda os espaços funcionais. Estes são espaços vetoriais com estrutura adicional, como os espaços de Hilbert. A álgebra linear é, portanto, uma parte fundamental da análise funcional e suas aplicações, que incluem, em particular, a mecânica quântica (funções de onda).

Estudo de sistemas complexos

A maioria dos fenômenos físicos são modelados por equações diferenciais parciais. Para resolvê-los, costuma-se decompor o espaço em que as soluções são buscadas em pequenas células que interagem entre si. Para sistemas lineares, essa interação envolve funções lineares. Para sistemas não lineares, essa interação geralmente é aproximada por funções lineares. Isso é chamado de modelo linear ou aproximação de primeira ordem. Os modelos lineares são freqüentemente usados para sistemas complexos não lineares do mundo real porque tornam a parametrização mais gerenciável. Em ambos os casos, matrizes muito grandes geralmente estão envolvidas. A previsão do tempo (ou mais especificamente, a parametrização para modelagem atmosférica) é um exemplo típico de aplicação no mundo real, onde toda a atmosfera da Terra é dividida em células de, digamos, 100km de largura e 100km de altura.

Cálculo científico

Quase todos os cálculos científicos envolvem álgebra linear. Consequentemente, os algoritmos de álgebra linear foram altamente otimizados. BLAS e LAPACK são as implementações mais conhecidas. Para melhorar a eficiência, alguns deles configuram os algoritmos automaticamente, em tempo de execução, para adaptá-los às especificidades do computador (tamanho do cache, número de núcleos disponíveis,...).

Alguns processadores, normalmente unidades de processamento gráfico (GPU), são projetados com uma estrutura matricial, para otimizar as operações de álgebra linear.

Extensões e generalizações

Esta seção apresenta vários tópicos relacionados que geralmente não aparecem em livros didáticos elementares de álgebra linear, mas são comumente considerados, em matemática avançada, como partes da álgebra linear.

Teoria do módulo

A existência de inversos multiplicativos em corpos não está envolvida nos axiomas que definem um espaço vetorial. Pode-se assim substituir o campo de escalares por um anel R, e isso dá uma estrutura chamada module sobre R ou R-módulo.

Os conceitos de independência linear, extensão, base e mapas lineares (também chamados de homomorfismos de módulo) são definidos para módulos exatamente como para espaços vetoriais, com a diferença essencial de que, se R não é um campo, existem módulos que não tem base. Os módulos que possuem uma base são os módulos livres, e os que são gerados por um conjunto finito são os módulos finitamente gerados. Homomorfismos de módulo entre módulos livres finitamente gerados podem ser representados por matrizes. A teoria das matrizes sobre um anel é semelhante à das matrizes sobre um corpo, exceto que os determinantes existem apenas se o anel for comutativo, e que uma matriz quadrada sobre um anel comutativo é invertível apenas se seu determinante tiver um inverso multiplicativo no anel.

Os espaços vetoriais são completamente caracterizados por sua dimensão (até um isomorfismo). Em geral, não existe uma classificação tão completa para módulos, mesmo que se restrinja a módulos finitamente gerados. No entanto, todo módulo é um cokernel de um homomorfismo de módulos livres.

Módulos sobre inteiros podem ser identificados com grupos abelianos, já que a multiplicação por um inteiro pode ser identificada como uma adição repetida. A maior parte da teoria dos grupos abelianos pode ser estendida a módulos sobre um domínio principal ideal. Em particular, sobre um domínio ideal principal, todo submódulo de um módulo livre é livre, e o teorema fundamental de grupos abelianos finitamente gerados pode ser estendido diretamente para módulos finitamente gerados sobre um anel principal.

Existem muitos anéis para os quais existem algoritmos para resolver equações lineares e sistemas de equações lineares. No entanto, esses algoritmos geralmente têm uma complexidade computacional muito maior do que os algoritmos similares sobre um campo. Para obter mais detalhes, consulte Equação linear sobre um anel.

Álgebra multilinear e tensores

Na álgebra multilinear, considera-se transformações lineares multivariáveis, isto é, mapeamentos que são lineares em cada uma de várias variáveis diferentes. Esta linha de investigação leva naturalmente à ideia do espaço dual, o espaço vetorial V* que consiste em mapas lineares f: V → F onde F é o corpo de escalares. Mapas multilineares T: Vn → F pode ser descrito por meio de produtos tensoriais de elementos de V*.

Se, além da adição vetorial e da multiplicação escalar, existe um produto vetorial bilinear V × V → V , o espaço vetorial é chamado de álgebra; por exemplo, álgebras associativas são álgebras com um produto vetorial associado (como a álgebra de matrizes quadradas ou a álgebra de polinômios).

Espaços vetoriais topológicos

Espaços vetoriais que não são de dimensão finita geralmente requerem estrutura adicional para serem tratáveis. Um espaço vetorial normado é um espaço vetorial junto com uma função chamada norma, que mede o "tamanho" de elementos. A norma induz uma métrica, que mede a distância entre os elementos, e induz uma topologia, que permite a definição de mapas contínuos. A métrica também permite uma definição de limites e completude – um espaço métrico completo é conhecido como espaço de Banach. Um espaço métrico completo junto com a estrutura adicional de um produto interno (uma forma sesquilinear simétrica conjugada) é conhecido como um espaço de Hilbert, que é em certo sentido um espaço de Banach particularmente bem-comportado. A análise funcional aplica os métodos da álgebra linear juntamente com os da análise matemática para estudar vários espaços funcionais; os objetos centrais de estudo na análise funcional são os espaços Lp, que são espaços de Banach, e especialmente o espaço L2 de funções quadradas integráveis, que é o único espaço de Hilbert entre elas. A análise funcional é de particular importância para a mecânica quântica, a teoria das equações diferenciais parciais, processamento de sinais digitais e engenharia elétrica. Ele também fornece a base e a estrutura teórica que fundamenta a transformada de Fourier e métodos relacionados.

Álgebra homológica

Notas explicativas

- ^ Este axioma não está afirmando a associatividade de uma operação, uma vez que existem duas operações em questão, multiplicação escalar b)v; e multiplicação de campo: A.

- ^ Isso pode ter a consequência de que algumas soluções fisicamente interessantes são omitidas.

Fontes gerais e citadas

- Anton, Howard (1987), Algebra linear elementar (5th ed.), Nova Iorque: Wiley, ISBN 0-471-84819-0

- Axler, Sheldon (18 de dezembro de 2014), Algebra linear Feito direito, Textos de Graduação em Matemática (3a ed.), Springer Publishing (publicado 2015), ISBN 978-319-11079-0

- Beauregard, Raymond A.; Fraleigh, John B. (1973), Um primeiro curso em Algebra Linear: com Introdução Opcional a Grupos, Anéis e Campos, Boston: Houghton Mifflin Company, ISBN 0-395-14017-X

- Burden, Richard L.; Faires, J. Douglas (1993), Análise numérica (5o ed.), Boston: Prindle, Weber and Schmidt, ISBN 0-534-93219-3

- Golub, Gene H.; Van Loan, Charles F. (1996), Computação de Matriz, Johns Hopkins Studies in Mathematical Sciences (3rd ed.), Baltimore: Johns Hopkins University Press, ISBN 978-0-8018-5414-9

- Halmos, Paul Richard (1974), Finite-Dimensional Vector Spaces, Undergraduate Texts in Mathematics (1958 2nd ed.), Springer Publishing, ISBN 0-387-90093-4, OCLC 1251216

- Harper, Charlie (1976), Introdução à Física Matemática, New Jersey: Prentice-Hall, ISBN 0-13-487538-9

- Katznelson, Yitzhak; Katznelson, Yonatan R. (2008), A (Terse) Introdução à Algebra Linear, American Mathematical Society, ISBN 978-0-8218-4419-9

- Roman, Steven (22 de março de 2005), Algebra linear avançada, Textos de pós-graduação em Matemática (2a ed.), Springer, ISBN 978-0-387-24766-3

![{displaystyle M=left[{begin{array}{rrr}2&1&-1\-3&-1&2\-2&1&2end{array}}right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fc5140ca13be8f555186b8d57b6223a4ef2e1b0b)

![{displaystyle left[!{begin{array}{c|c}M&mathbf {v} end{array}}!right]=left[{begin{array}{rrr|r}2&1&-1&8\-3&-1&2&-11\-2&1&2&-3end{array}}right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6a94bf6a98576cd520287535af3a6587376f9be8)

![{displaystyle left[!{begin{array}{c|c}M&mathbf {v} end{array}}!right]=left[{begin{array}{rrr|r}1&0&0&2\0&1&0&3\0&0&1&-1end{array}}right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a6a99163495ae1cf328208d89cadcdf23397fba0)